Anleitung zum Erstellen hochwertiger KI-Videos mit Wan 2.1

Bereit, tolle Videos mit KI zu machen? Diese unterhaltsame Anleitung zeigt Ihnen, wie Sie es verwenden WAN 2.1 — ein hochmodernes KI-Videomodell von Alibaba — um Ihre Ideen in hochwertige Videoclips umzusetzen. Wir werden die Dinge einfach halten und anfängerfreundlichund erklärt nebenbei alle technischen Begriffe. Am Ende kennst du die besten Einstellungen (wie Videogröße und -länge), wie du Musik oder Stimme hinzufügst, einen schrittweisen Arbeitsablauf und Tipps zur Vermeidung häufiger Fallstricke. Lass uns eintauchen!

Was ist WAN 2.1?

WAN 2.1 ist ein leistungsstarkes Modell zur KI-Videogenerierung — im Grunde ein intelligentes Programm, das aus einer Textbeschreibung oder einem Bild kurze Videos erstellen kann. Stellen Sie sich das wie einen Mini-Filmregisseur vor: Sie geben ihm ein Drehbuch (Aufforderung) oder ein Bild und es produziert einen Videoclip für Sie. Es ist quelloffen, was bedeutet, dass es kostenlos ist und der Code/die Modelle öffentlich zugänglich sind, damit jeder ihn verwenden oder verbessern kann.

Das Team von Alibaba trainierte WAN 2.1 auf einem riesig Datenmenge (über eine Milliarde Videoclips!) , also hat es gelernt, ziemlich realistische Szenen mit Wan 2.1 Bild zu Video (720p) zu generieren. Es kann damit umgehen Text-zu-Video (T2V) und Bild-zu-Video (I2V) -Aufgaben, unter anderem sogar einige Videobearbeitungen und Text-zu-Bild-Aufgaben. Eine Videoversion dieses Tutorials finden Sie hier: Wan 2.1 Lokal auf dem PC mit 8 GB VRAM installieren - Promptus

Cooles Feature: WAN 2.1 ist eine der ersten Video-KIs, die sogar Text generieren kann innen das Video (wie ein Schild oder Untertitel auf Englisch oder Chinesisch), wenn du danach fragst. So könntest du es zum Beispiel bitten, eine Werbetafel mit einer Nachricht anzuzeigen, und es wird versuchen, sie aufzuschreiben. Denken Sie insgesamt an WAN 2.1 = KI, die aus Ihren Eingabeaufforderungen kurze Videos macht — sehr praktisch für kreative Projekte!

Tools für das Run Wan 2.1-Modell

Sie müssen kein Programmiergenie sein, um WAN 2.1 zu verwenden. Hier sind einige benutzerfreundliche Methoden und Tools für den Einstieg:

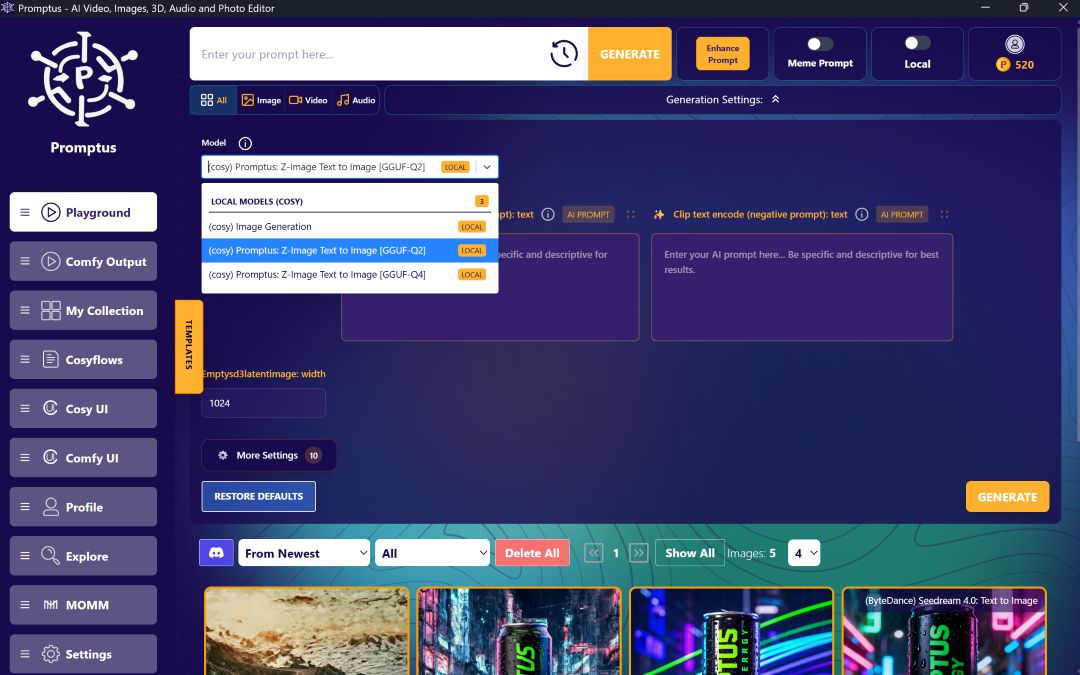

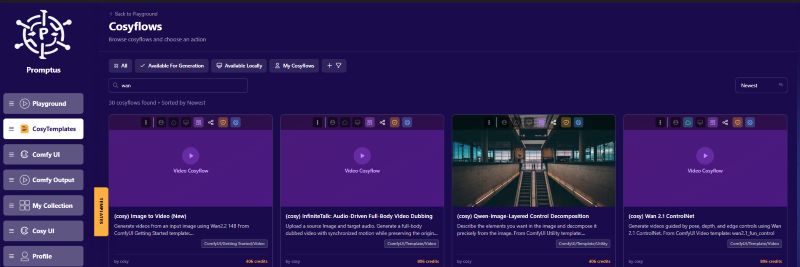

- Online-Generatoren: Einfachste Option — Promptus hat WAN 2.1 integriert, wo du einfach eine Eingabeaufforderung eingibst und ein Video erhältst. Keine Installation erforderlich (achten Sie nur auf Wartezeiten oder Nutzungsbeschränkungen).

- Promptus App herunterladen (für den lokalen Gebrauch): Eine beliebte App mit einem visuellen knotenbasiert Schnittstelle (wie Flussdiagrammblöcke), die WAN 2.1 unterstützt. Damit können Sie die Einstellungen einfach anpassen. Wenn Sie einen ordentlichen PC mit einer guten GPU haben, können Sie WAN 2.1 installieren und in Promptus auf der Registerkarte ComfyUI laden.

- SwarmUI oder andere Benutzeroberflächen: Einige Community-Benutzeroberflächen (wie SwarMUI, ähnlich wie ComfyUI) unterstützen auch WAN 2.1 und bieten nach der Einrichtung eine einfache Weboberfläche.

- Umarmen von Gesicht/Collab: Wenn Ihr Computer nicht stark genug ist, können Sie Cloud-Dienste ausprobieren. Es gibt Google Colab-Notebooks und Hugging Face Spaces, auf denen WAN 2.1 in der Cloud ausgeführt wird (aus Kostengründen oft auf kurze 5-Sekunden-Videos beschränkt).

- Direkt GitHub + Python: Für technisch versierte Benutzer können Sie den Code von GitHub abrufen und ausführen

generate.pymit deinen Einstellungen. Dazu müssen Abhängigkeiten installiert und die Modelldateien heruntergeladen werden (Warnung: Die 14B-Modelldatei ist groß!). Die GitHub-Route ist eher manuell, gibt dir aber die volle Kontrolle.

Hinweis zur Hardware:

WAN 2.1 hat zwei Hauptmodellgrößen — 14B (groß) und 1,3 GB (leicht). Das lite 1,3 GB Das Modell ist für den Betrieb auf Consumer-GPUs (~8 GB VRAM) optimiert. Ein RTX 3060 Ti oder ähnliches kann beispielsweise das 1.3B-Modell verarbeiten. Das großes 14B Das Modell benötigt mehr VRAM (idealerweise 16 GB oder mehr), um mit höheren Auflösungen ausgeführt zu werden.

Wenn Sie eine High-End-Karte wie eine RTX 4090 (24 GB VRAM) haben, können Sie die 14B sogar problemlos mit 720p verwenden — ein Benutzer meldet ~4 Minuten, um ein 5-Sekunden-Video mit 480p auf einer 4090 zu generieren. Im Grunde genommen: Fast jeder Gaming-PC kann WAN 2.1 mit dem kleinen Modell ausprobieren, und leistungsfähigere GPUs können das komplette Modell verwenden, um die beste Qualität zu erzielen.

Nachdem Sie nun eine Vorstellung von den Tools und der Einrichtung haben, lassen Sie uns darüber sprechen, wie Sie die beste Ausgabequalität von WAN 2.1.

Auswahl der besten Videoabmessungen (Auflösung)

Eine der ersten Entscheidungen ist, wie groß (in Pixeln) Ihre Videoframes sein sollten. Höhere Auflösung = schärferes Video, aber auch mehr Arbeit für die KI (langsamer und mehr Speicher). Folgendes empfehlen wir:

- Entscheiden Sie sich für HD (720p), wenn Sie können: Das Modell wurde mit zwei Auflösungen trainiert: 832×480 (oft nur 480p genannt) und 1280×720 (720p). Das 720p Die Option liefert deutlich schärfere Details. Verwenden Sie sie also, wenn Ihre Hardware damit umgehen kann. Für die 720p-Generierung wird in der Regel eine GPU mit ~16 GB VRAM (oder mehr) benötigt. Bei GPUs für Privatanwender mit weniger Arbeitsspeicher geht Ihnen bei 720p möglicherweise der VRAM aus.

- 480p für den Anfang: Wenn 720p zu langsam ist oder nicht funktioniert, ist 480p immer noch eine ordentliche Qualität. Sie erhalten ein 832×480-Video, das auf kleinen Bildschirmen gut aussieht und schneller generiert werden kann. Das 1,3 B Das kleine Modell ist standardmäßig für die Ausgabe von 480p ausgelegt (5-Sekunden-Clips). Lesen Sie mehr von Dev Gemeinschaft. Fühlen Sie sich nicht schlecht, wenn Sie 480p verwenden — das können Sie immer gehoben später.

- Nach der Generierung auf 1080p (Full HD) hochskalieren: Die eigene Generation von WAN 2.1 über 720p hinaus (z. B. das direkte Ausprobieren von 1080p) wird auf den meisten GPUs nicht empfohlen — sie kann stürzen ab oder produzieren Artefakte wenn es zu hoch gedrückt wird. Der bessere Ansatz: Generieren Sie mit 480p/720p und verwenden Sie dann einen AI-Upscaler für die fertigen Bilder oder Videos, um 1080p zu erreichen. Dieser zweistufige Prozess führt zu saubereren Ergebnissen, als das Modell zu zwingen, 1080p in einem Rutsch zu verwenden. Es gibt kostenlose Tools wie Video 2 X oder VFIO, und sogar eingebaute Knoten in ComfyUI, um Frames (z. B. ESRGAN-Modelle) hochzuskalieren. Es ist ein zusätzlicher Schritt, aber es lohnt sich für ein knackiges Abschlussvideo.

Terminologieprüfung: Auflösung bedeutet nur die Breite x Höhe des Videos in Pixeln (z. B. 1280×720). Allgemeine Bezeichnungen: 480p = 852 x 480 (SD, DVD-Qualität), 720p = 1280 x 720 (HD), 1080p = 1920 x 1080 (Voll HD). Höhere Auflösung = mehr Details, aber auch schwerere Dateien und langsamere Verarbeitung.

Kurz gesagt: verwende 720p für beste Qualität wenn Ihr System es zulässt, andernfalls ist 480p ein solides Fallback, und planen Sie bei Bedarf ein Upgrade auf Full-HD ein.

Beachten Sie auch das Seitenverhältnis: Standardmäßig wird ein 16:9 -Breitbildschirm verwendet (Sie können auch vertikal 9:16 verwenden, wenn Sie den TikTok-Stil bevorzugen — z. B. 720×1280).

Wie lang sollte Ihr KI-Video sein? (Länge des Videos)

WAN 2.1 zeichnet sich durch kurze Clips. Denken Sie daran, es ist (noch) nicht dafür gedacht, einen kompletten 2-stündigen Film auf Ihrem Laptop zu drehen. Hier finden Sie eine Anleitung zur Videolänge:

- Empfohlene Länge: ~5 Sekunden pro Clip. Viele Benutzer halten sich an etwa Maximal 5 Sekunden (ca. 80 Bilder bei 16 FPS) beim Generieren eines einzelnen Clips. Diese Länge ist lang genug, um eine kleine Szene oder Aktion zu zeigen, aber kurz genug, um die Qualität hoch und die Verarbeitungszeit angemessen zu halten. Tatsächlich beträgt die Standardeinstellung einiger Benutzeroberflächen 5 Sekunden.

- Warum kurz? Je länger das kontinuierliche Video ist, desto schwieriger wird es für die KI, die Konsistenz aufrechtzuerhalten. Nach einer bestimmten Anzahl von Bildern kann das Modell beginnen „vergiss“ wie die ersten Frames aussahen und vom Thema abweichen (z. B. kann sich das Aussehen einer Figur in sehr langen Sequenzen subtil ändern). Außerdem verbrauchen längere Videos viel mehr VRAM und Zeit, was die Wahrscheinlichkeit von Fehlern oder seltsamen Artefakten erhöht.

- Benötigen Sie ein längeres Video? Du kannst mehrere Clips zusammennähen zusammen. Generieren Sie beispielsweise drei 5-Sekunden-Szenen und bearbeiten Sie sie nacheinander. Um den Übergang fließend zu gestalten, können Sie das letzte Bild von Clip 1 als Startbild für Clip 2 verwenden, sodass die Szene dank seiner ausgefallenen Architektur fortgesetzt wird. In der Praxis ist es jedoch klüger, die Dinge in Teile zu zerlegen und dann zu kombinieren. Auf diese Weise bleibt jeder Teil scharf.

- Bildrate (FPS): Standardmäßig gibt WAN 2.1 etwa aus 16 BILDER PRO SEKUNDE (Bilder pro Sekunde). 16 FPS sind etwas niedriger als Standardvideo (normalerweise 24 oder 30 FPS), was bedeutet, dass das Rohvideo möglicherweise etwas abgehackt aussieht.

Keine Sorge — du kannst Erhöhen Sie die Bildrate danach Generierung mit Frame-Interpolation. Ein beliebter Trick besteht darin, mit 16 FPS zu generieren und dann ein Tool wie WEIT VERBREITET (z. B. über die App Flowframes), um die Bildrate auf 32 FPS zu verdoppeln und dann mit ~30 FPS abzuspielen, um eine extrem flüssige Bewegung zu erzielen). Für die meisten Zwecke können Sie einfach 16 FPS -> 24 FPS konvertieren; die fehlenden Zwischenbilder werden von der Interpolationssoftware intelligent erraten, was zu einem flüssigen Video führt).

Der Arbeitsablauf ist also: Generieren Sie die Frames und erhöhen Sie dann bei Bedarf die FPS, um die Geschmeidigkeit zu gewährleisten.

Also halte es kurz und bündig. Streben Sie ein paar Sekunden pro Generation an. Wenn Sie eine Handlung im Sinn haben, planen Sie sie in kleinen Szenen. Sie erhalten eine bessere Qualität und können die Szenen dann wie ein Storyboard zusammenstellen.

Erstellen Sie ein Video mit WAN 2.1-Workflow

Lassen Sie uns den gesamten Prozess von der Idee bis zum endgültigen Video durchgehen. Keine Sorge — es ist einfacher als es klingt. Folgen Sie diesen Schritten:

- Lass dir eine Idee einfallen — Stell dir eine kurze Szene vor, die du willst. Zum Beispiel ein „Hundeskateboarden auf einem Regenbogen“ oder vielleicht „eine futuristische Stadt mit fliegenden Autos bei Sonnenuntergang“. Sei kreativ! Wenn Sie einen bestimmten Stil (Zeichentrick, realistisch, filmisch) hinzufügen möchten, beachten Sie dies ebenfalls. Diese Idee wird deine Textaufforderung. Wenn du ein Startbild (für Bild-zu-Video) hast — wie ein Foto einer Figur, die du animieren möchtest — halte es bereit.

- Richten Sie das Tool ein — Starten Sie das von Ihnen gewählte Interface. Wenn du verwendest Promptus, stellen Sie sicher, dass das WAN 2.1-Modell geladen ist (Sie könnten eine Community verwenden Arbeitsablauf Datei- oder Node-Setup speziell für WAN 2.1). Navigieren Sie im Promptus Web App Generator einfach zum Modellbereich und wählen Sie Cosy WAN 2.1.

- Wählen Sie den Modus: Wählen Text-zu-Video (T2V) wenn Sie nur eine Textaufforderung verwenden. Wenn Sie ein Bild zum Animieren haben, wählen Sie Bild-zu-Video (I2V) und lade dein Bild hoch (und du kannst immer noch eine Textaufforderung hinzufügen, um den Stil/die Szene zu steuern). WAN 2.1 unterstützt beide Modi.

- Auflösung: Stellen Sie die Bildauflösung wie beschrieben ein (480p oder 720p). Viele Benutzeroberflächen verfügen über ein Drop-down-Menü für gängige Auflösungen. Beginnen Sie mit 480p, wenn Sie sich nicht sicher sind, um das Terrain zu sondieren.

- Frame-Anzahl/Dauer: Entscheide, wie viele Frames oder Sekunden. Bei 16 Bildern pro Sekunde sind es beispielsweise 80 Bilder ≈ 5 Sekunden. Bei einigen Benutzeroberflächen können Sie nur die Sekunden und die FPS eingeben und sie berechnen Frames. Geben Sie eine bescheidene Zahl ein (z. B. „80 Bilder bei 16 FPS“ oder „5 Sekunden“).

- Andere Einstellungen: Es wird einige Slider geben wie „Orientierungsskala“ (wie strikt es Ihrer Aufforderung folgt) und „Schritte“ (wie viele Verfeinerungs-Iterationen). Lassen Sie sich nicht einschüchtern — oft werden gute Standardwerte bereitgestellt. Für WAN 2.1 gibt es eine Richtskala von 5—7 wird empfohlen (Zu hoch kann zu Flackern führen, wir erklären es weiter unten). Sie können es auf ~6 setzen, um zu beginnen. Probenahme Schritte etwa 20—30 pro Bild sind üblich.

- Samen (optional): Wenn du eine siehst Saatgut Wert, das kontrolliert nur die Zufälligkeit. Jede Zahl ist in Ordnung. Wenn Sie einen bestimmten Startwert festlegen, können Sie das gleiche Ergebnis später reproduzieren. Wenn Sie den Wert nach dem Zufallsprinzip wählen, kann die Ausgabe bei jedem Durchlauf variieren. Zufällig ist vorerst in Ordnung — du kannst jederzeit einen Startwert für einen Take festlegen, den du noch weiter anpassen möchtest.

- Wählen Sie den Modus: Wählen Text-zu-Video (T2V) wenn Sie nur eine Textaufforderung verwenden. Wenn Sie ein Bild zum Animieren haben, wählen Sie Bild-zu-Video (I2V) und lade dein Bild hoch (und du kannst immer noch eine Textaufforderung hinzufügen, um den Stil/die Szene zu steuern). WAN 2.1 unterstützt beide Modi.

- Schreiben Sie Ihre Aufforderung — Geben Sie Ihre Textaufforderung in das Eingabeaufforderungsfeld ein. Seien Sie klar und versuchen Sie, ein Bild mit Worten zu malen. Geben Sie alle Details zu Umgebung, Beleuchtung, Stil oder Bewegung an. Zum Beispiel:

Aufforderung: „Ein Ritter in glänzender Rüstung reitet in der Abenddämmerung auf einem fliegenden Drachen über einer mittelalterlichen Stadt, filmische Beleuchtung, sanfter Kameraschwenk.“

Diese Aufforderung teilt der KI mit, was sie zeigen soll (Ritter auf dem Drachen, mittelalterliche Stadt) und weist sogar auf Kamerabewegungen hin („flüssiges Kameraschwenken“).

WAN 2.1 reagiert auf bestimmte Bewegungsschlüsselwörter wie „Kamera bewegt sich“ oder „Gehen“ als es einige grundlegende Bewegungsmuster erlernte. Behalte es eine Szene pro Clip — versuche nicht, in 5 Sekunden zu viele verschiedene Aktionen auszuführen. Speichere separate Aktionen für separate Clips.

Tipp: Sie können auch eine verwenden negative Aufforderung um der KI zu sagen, was nicht zu zeigen. Zum Beispiel „—no blur, no text, no watermark“, um unerwünschte Artefakte zu vermeiden.

- Generieren Sie das Video — Schlag das „Generieren“ oder „Warteschlange“ Knopf! 🚀 Jetzt warte, bis WAN 2.1 seine Magie entfaltet. Es wird eine Weile dauern, da mehrere Frames erstellt werden. Bei einem 5-Sekunden-480p-Clip auf einer ordentlichen GPU kann dies ein paar Minuten Verarbeitungszeit bedeuten. Wenn Sie eine Online-Web-App von Promptus verwenden, kann es ein paar Minuten länger dauern. Haben Sie einfach etwas Geduld und holen Sie sich vielleicht einen Drink.

Während der Generierung erstellt das Modell im Wesentlichen jedes Bild Schritt für Schritt mithilfe eines Diffusionsprozesses — ähnlich wie die Funktionsweise von KI-Bildgeneratoren, nur mit einer zusätzlichen Zeitdimension.

- Vorschau des Ergebnisses — Wenn es fertig ist, bekommst du eine Videodatei (oft in .mp4 oder .gif format) oder eine Reihe von Frames. Spielen Sie das Video ab und sehen Sie, wie es aussieht! Das ist der spannende Teil — entsprach der Output Ihrer Vision? Vielleicht sind der Ritter und der Drache da und fliegen reibungslos, oder vielleicht musst du etwas anpassen. Evaluieren Sie:

- Ist der Antrag glatt? Wenn es bei niedrigen FPS etwas nervös ist, denken Sie daran, dass wir später interpolieren können.

- Sind die Bildmaterial kohärent? Achte auf merkwürdige Morphings oder Flimmern zwischen den Frames.

- Folgt es dem zu etwas bringen eng? Vielleicht sieht die „Beleuchtung in der Abenddämmerung“ eher nach Mittag aus; Sie könnten die Eingabeaufforderung oder die Einstellungen anpassen.

- Irgendwelche unerwünschten Macken? Zum Beispiel flackern KI-Videos manchmal oder das Motiv ändert leicht die Farbe — diese können oft mit den Einstellungen behoben werden.

- Bei Bedarf verfeinern — Es ist üblich, beim ersten Versuch kein perfektes Video zu bekommen. Lass dich nicht entmutigen! Kleinere Verbesserungen können es verbessern:

- Aufforderung anpassen: Wenn etwas Wichtiges fehlt, machen Sie es in der Eingabeaufforderung deutlicher. Wenn etwas Seltsames vorhanden war, kannst du es der negativen Aufforderung hinzufügen (z. B. „kein Text“, wenn du Kauderwelschtext gesehen hast).

- Orientierungsskala: Wenn das Video stark flackert oder sich plötzlich von Bild zu Bild ändert, ist deine Richtlinie möglicherweise zu hoch. Versuche es mit einem etwas niedrigeren Wert (sagen wir 5 statt 7). Eine hohe Leitfähigkeit kann die KI voranbringen über-korrigiere jeden Frame bis zur Aufforderung, was zu Jitter führt. Wenn das Video zu sehr vom Thema abweicht oder verschwommen ist, könntest du erhöhen ein bisschen Anleitung. Es ist ein Gleichgewicht.

- Schritte: Wenn Sie die Anzahl der Diffusionsschritte pro Frame erhöhen, können Details manchmal schärfer werden (bei längerer Generierungszeit). Wenn Sie 20 Schritte verwendet haben, könnten Sie es mit 30 versuchen. Wenn die Generierung sehr langsam war, könnten Sie die Schritte reduzieren, um die Geschwindigkeit zu erhöhen, was zu Qualitätseinbußen führen würde.

- Konsistenzhilfen: Erweiterte Anpassung — wenn du Promptus verwendest, gibt es Möglichkeiten, die Konsistenz zu verbessern (z. B. indem du jedes Bild in das nächste einspeist oder das letzte Bild als Start für die nächste Diffusion verwendest). Wenn Sie jedoch ein Anfänger sind, können Sie dies überspringen oder Community-Workflows verwenden, bei denen diese Knoten eingerichtet sind. Oft leistet WAN 2.1 dank seines internen Designs, das bereits auf zeitliche Konsistenz abzielt, sofort einen ordentlichen Job (es hat etwas, das als räumlich-zeitliche VAE um die Bewegung geschmeidig zu halten.

- Versuchen Sie es mit Bild-zu-Video: Wenn reines Text-zu-Video ein komplexes Motiv nicht auf den Punkt bringt, besteht ein Trick darin, zuerst ein einzelnes Bild zu generieren (mit der Text-zu-Bild-Fähigkeit einer Bild-KI oder WAN 2.1) und dieses Bild dann im Bild-zu-Video-Modus als Startbild zu verwenden. Dadurch kann das Aussehen einer Figur oder Szene festgelegt werden, und dann muss das Modell sie nur noch animieren, anstatt sie von Grund auf neu zu erfinden.

- Aufforderung anpassen: Wenn etwas Wichtiges fehlt, machen Sie es in der Eingabeaufforderung deutlicher. Wenn etwas Seltsames vorhanden war, kannst du es der negativen Aufforderung hinzufügen (z. B. „kein Text“, wenn du Kauderwelschtext gesehen hast).

- FPS hochskalieren und steigern (optional) — Sobald du einen Clip hast, der dir gefällt, kannst du ihn nachbearbeiten, um eine noch bessere Qualität zu erzielen:

- Hochskalierung: Wenn Ihr Endziel eine höhere Auflösung ist, nehmen Sie die Einzelbilder oder das Video auf und skalieren Sie sie hoch. Bei einigen Tools kannst du ein Video hochladen und jedes Bild wird per KI hochgerechnet. Zum Beispiel Topaz Video AI (kostenpflichtig) oder kostenlose wie Video2X oder sogar die Verwendung von img2img von Stable Diffusion mit einem hochauflösenden Modell für jedes Bild (etwas fortgeschritten). Wenn du in 720p generiert hast und zufrieden bist, könntest du das überspringen. Aber wenn du hardwaretechnisch nur 480p bekommen hast, wird es durch Hochskalieren auf 720p oder 1080p viel schärfer aussehen, wenn du es im Vollbildmodus betrachtest. Stellen Sie sicher, dass Sie einen KI-basierten Upscaler verwenden, um optimale Ergebnisse zu erzielen (sie fügen Details hinzu), und nicht nur eine einfache Größenänderung.

- Frame-Interpolation (für FPS): Wie bereits erwähnt, können Sie die Bewegung glätten, indem Sie die Bildrate erhöhen. Tools wie Flowframes (welche verwendet WEIT VERBREITET AI) eignen sich perfekt dafür: Du lädst dein 16-FPS-Video, wählst „Bilder mit 2 multiplizieren“ und es wird ein 32-FPS-Video ausgegeben. Du kannst es dann mit normaler Geschwindigkeit abspielen (effektiv in Zeitlupe oder extra flüssig) oder einige Frames droppen, um 24/30 FPS anzustreben. Das Ergebnis ist ein viel flüssigeres Video, ohne den Inhalt zu ändern. Dieser Schritt ist optional, kann aber bei Actionszenen einen spürbaren Unterschied machen.

- Hochskalierung: Wenn Ihr Endziel eine höhere Auflösung ist, nehmen Sie die Einzelbilder oder das Video auf und skalieren Sie sie hoch. Bei einigen Tools kannst du ein Video hochladen und jedes Bild wird per KI hochgerechnet. Zum Beispiel Topaz Video AI (kostenpflichtig) oder kostenlose wie Video2X oder sogar die Verwendung von img2img von Stable Diffusion mit einem hochauflösenden Modell für jedes Bild (etwas fortgeschritten). Wenn du in 720p generiert hast und zufrieden bist, könntest du das überspringen. Aber wenn du hardwaretechnisch nur 480p bekommen hast, wird es durch Hochskalieren auf 720p oder 1080p viel schärfer aussehen, wenn du es im Vollbildmodus betrachtest. Stellen Sie sicher, dass Sie einen KI-basierten Upscaler verwenden, um optimale Ergebnisse zu erzielen (sie fügen Details hinzu), und nicht nur eine einfache Größenänderung.

Das ist der grundlegende Arbeitsablauf. Als Nächstes behandeln wir einige Best Practices und häufige Fehler damit du Probleme beheben und deine Videos wie ein Profi verfeinern kannst.

Profi-Tipps für großartige KI-Videoergebnisse

Trotz der oben genannten Schritte gibt es einige zusätzliche Hinweise, mit denen Sie Ihr KI-Video von gut zu großartig machen können. Hier sind einige Tipps und Verbote:

✅ Halten Sie die Eingabeaufforderungen für eine Szene konsistent: Wenn du einen einzelnen Clip generierst, vermeide es, die Beschreibung auf halbem Weg zu ändern. Verwenden Sie beispielsweise keine Eingabeaufforderung, die auf einmal über einen Wald spricht und am Ende über den Ozean spricht — das Modell wird von Bild zu Bild durcheinander geraten. Eine Szene = eine Aufforderung.

Sie können jederzeit einen separaten Clip für die nächste Szene erstellen. Die Konsistenz der Eingabeaufforderung führt zu einer Konsistenz im Video. Wenn du Bedarf ein Übergang, mach das in zwei Clips und füge sie per Bearbeitung zusammen. Plötzliches Umschalten der Eingabeaufforderung kann zu störendem Flimmern oder Szenensprüngen führen.

✅ Verwenden Sie moderate Richtwerte (CFG-Skala): Wie bereits erwähnt, ist ein Richtwert von 5—7 für Videos in der Regel am besten geeignet. Dadurch folgt die KI Ihrer Aufforderung, ohne sie zu übertreiben. Mach es nicht zu voll auf 15 oder 20 — ein hoher CFG-Wert kann dazu führen, dass jedes Bild so sehr versucht, dem Prompt zu entsprechen, dass flackernde Lichter oder sich verändernde Details zwischen den einzelnen Frames entstehen. Auf der anderen Seite, zu niedrig (etwa 1 oder 2) und die KI driftet möglicherweise ab und fügt zufällige Dinge hinzu. Also, Goldlöckchen-Regel: etwa 6 ist genau richtig in den meisten Fällen.

✅ Umfangreiche Probenahmeschritte (aber nicht extrem): Wenn deine Videobilder etwas grob oder detailarm aussehen, solltest du erwägen, die Diffusionsstufen etwas zu erhöhen (z. B. von 20 auf 30). Das gibt der KI mehr Wiederholungen, um das Bild zu polieren. Aber ein zu hoher Wert (etwa 50+ pro Frame) verlangsamt die Dinge erheblich, und das bei wohl minimalen Gewinnen. Ebenfalls, was auch immer Sampler Du verwendest, bleib für das ganze Video dabei (ändere nicht pro Bild). Konsistenz hilft, seltsame Kontinuitätsprobleme zu vermeiden.

❌ Versuche nicht, ein extrem langes Video auf einmal zu generieren: Wir können das nicht genug betonen — wenn beispielsweise ein 30-Sekunden-Clip in einem Durchgang generiert wird, wird das wahrscheinlich zu einer Enttäuschung führen (wenn er überhaupt ohne Speichermangel abgeschlossen wird). Es ist nicht nur langsam, auch der letzte Teil des Videos kann an Qualität verlieren oder von der Qualität abweichen. Teilen Sie längere Inhalte in Abschnitte von wenigen Sekunden auf. Das ist einfacher zu handhaben und du kannst sie danach jederzeit zusammenkleben. Wenn Sie eine längere ununterbrochene Aufnahme wünschen, können Sie den Trick anwenden, das letzte Bild einer Generation als erstes des nächsten zu verwenden, um die Kontinuität über das gesamte Segment hinweg aufrechtzuerhalten.

❌ Vermeiden Sie ultrahohe Auflösungen direkt: Wie im Abschnitt zur Auflösung erwähnt, führt ein direkter Sprung auf 1080p oder höher innerhalb von WAN 2.1 zu Problemen auf normaler Hardware. Sie riskieren Abstürze oder seltsame Verzerrungen. Es ist effektiver, mit den trainierten Auflösungen (480p/720p) zu generieren und später aus Gründen der Klarheit eine höhere Auflösung zu erzielen. Die ideale Größe für das Training des Modells sind diese Größen. Halten Sie sich also bei der Generierung an sie. Wenn Sie 4K benötigen... naja, vielleicht in einer zukünftigen Version oder verwenden Sie mehrmals externe Upscaler (aber das ist fortgeschritten und schwer).

❌ Nicht zu viel Action in eine Szene stopfen: Wenn Ihre Eingabeaufforderung versucht, „ein Autorennen, gefolgt von einer Alien-Invasion, dann eine Tanzparty“ Alles in einem 5-Sekunden-Clip, das Ergebnis wird wahrscheinlich eine unordentliche Unschärfe sein. Konzentrieren Sie sich auf eine einzelnes Konzept oder kontinuierliche Aktion pro Clip. Wenn Sie mehrere Dinge möchten, planen Sie mehrere Clips ein. Das gilt auch für Kamerabewegungen — bei einem Clip könnte es sich um das „Schwenken der Kamera um die Figur“ handeln, aber versuche nicht gleichzeitig zu zoomen und zu schwenken und 10 Dinge gleichzeitig zu erledigen. Einfacher ist sicherer, vor allem, wenn du lernst. Du kannst immer schick werden, indem du mehrere KI-Clips zusammen bearbeitest, um komplexe Sequenzen zu erstellen.

✅ Nutzen Sie die Interpolation für Glätte: Wir haben das bereits besprochen, aber es ist ein häufiger Aha-Moment für Neuankömmlinge. Wenn Sie die Bewegung ein bisschen abgehackt finden, besteht die Lösung nicht darin, mit einer höheren FPS zu generieren (was nur mehr Frames und VRAM kostet), sondern die anschließende Interpolation zu verwenden. Eine direkte Erhöhung der FPS des Modells bedeutet, dass mehr Frames konsistent bleiben müssen (schwieriger) und mehr Speicherplatz beansprucht werden. Generieren Sie also mit etwa 16 FPS, was das Modell ist, und verlassen Sie sich dann auf die Interpolationssoftware, um 24/30 FPS zu erreichen. Das bewahrt die Qualität und spart eine Menge Rechenleistung.

✅ Verwenden Sie das richtige Modell für Ihre GPU: Wenn Ihnen ständig der Speicher ausgeht oder die Software abstürzt, versuchen Sie möglicherweise, das 14B-Modell auf einer GPU zu verwenden, die damit nicht umgehen kann. Wechseln Sie für eine geringere Auslastung zum 1.3B-Modell (in der Benutzeroberfläche oft als „WAN2.1-T2V-1.3b“ oder ähnlich bezeichnet). Die Ausgabe ist vielleicht etwas weniger detailliert, aber sie ist immer noch sehr gut — und ein stabiler Renderer ist besser als ein abgestürzter!

Alternativ haben einige Communities veröffentlicht 8-Bit- oder 4-Bit-quantisierte Versionen von WAN 2.1, die weniger VRAM verwenden, bei einem kleinen Qualitätskompromiss. Dadurch kann das 14B-Modell auf 8—12-GB-Karten ausgeführt werden.

❌ Übersehen Sie keine negativen Aufforderungen: Wenn deine Videos häufig unerwünschte Artefakte enthalten (wie Textkleckse, Wasserzeichen oder seltsame Objekte), versuche, sie mit einer negativen Aufforderung ausdrücklich zu verbieten. Fügen Sie z. B. hinzu („Text“ :1.2), (Wasserzeichen), (Logo) im negativen Prompt-Feld (die Syntax kann je nach Schnittstelle variieren). Das ist nicht garantiert, kann der KI aber helfen, sich von diesen Elementen fernzuhalten. Einige Modelle geben beispielsweise manchmal unübersichtlichen Text so an, als ob es sich um eine Signatur handelt — eine negative Aufforderung kann diese Wahrscheinlichkeit verringern.

✅ Speichern Sie Ihre Arbeit und Einstellungen: Wenn Sie endlich ein Ergebnis erhalten, das Ihnen gefällt, notieren Sie sich die Einstellungen (oder speichern Sie das Projekt in der Benutzeroberfläche). Auf diese Weise haben Sie das Rezept, wenn Sie es später erneut rendern oder anpassen möchten. In Promptus können Sie das Workflow-Diagramm speichern. In anderen Benutzeroberflächen können Sie eine Voreinstellung speichern. Notieren Sie sich mindestens den Startwert, die Aufforderung, die Schritte, die Anleitung usw., vielleicht in einer Textdatei. Das ist sehr hilfreich, wenn Sie mehr experimentieren.

Schnellkorrekturen zur Problembehebung:

- Problem: Das Video flackert oder hat schnelle Farbänderungen — Versuchen Sie, den CFG-Richtwert zu senken, stellen Sie sicher, dass Ihre Eingabeaufforderung nicht widersprüchlich ist, und achten Sie auf eine gleichmäßige Beleuchtung in der Beschreibung. Vergewissere dich außerdem, dass du nicht versehentlich den Startwert bei jedem Frame änderst (die meisten Benutzeroberflächen übernehmen das für dich).

- Problem: Das Subjekt ändert auf halbem Weg das Aussehen — Das Konzept ist möglicherweise zu komplex oder das Modell hat Schwierigkeiten, es aufrechtzuerhalten. Wenn Sie ein Ausgangsbild (I2V-Modus) verwenden, kann das Motiv gesperrt werden. Oder teilen Sie das Video in zwei Abschnitte auf und verstärken Sie die Aufforderung möglicherweise im zweiten Abschnitt erneut. Generieren Sie beispielsweise für eine 10-Sekunden-Sequenz eines Charakters die ersten 5 Sekunden und verwenden Sie dann das letzte Bild und die Aufforderung, um die nächsten 5 Sekunden zu generieren. Dies erinnert das Modell daran, wie die Figur aussah.

- Problem: Fehler aufgrund unzureichenden Speichers — Reduzieren Sie die Auflösung (720p -> 480p) oder reduzieren Sie die Bildanzahl oder verwenden Sie die kleinere Modellvariante. Schließen Sie auch andere Programme, die Ihre GPU verwenden. Wenn Sie eine Benutzeroberfläche wie Automatic1111 oder ComfyUI verwenden, stellen Sie sicher, dass Sie nicht versehentlich einen riesigen Verlauf von Frames im Speicher speichern. Manchmal generierend in Diffusionschargen (ein Bild nach dem anderen) ist erforderlich, anstatt alle Bilder in einem Stapel. Viele Benutzeroberflächen verwenden standardmäßig eine nach der anderen, um Speicherplatz zu sparen.

- Problem: Das Video ist verschwommen oder detailarm — Erhöhen Sie die Schritte etwas oder verwenden Sie nach Möglichkeit ein Modell mit höherer Auflösung. Sie können auch eine versuchen hochwertige + raffinierte Technik: mit 480p generieren, dann jedes Bild aufnehmen und durch ein leistungsstarkes Bildmodell (wie Stable Diffusion XL) mit geringer Rauschunterdrückung laufen lassen, um Details zu verbessern, ohne den Inhalt zu verändern. Das ist fortgeschritten, führt aber zu schärferen Bildern. Es gibt Skripte, um diese Frame-für-Frame-Erweiterung zu automatisieren. Ansonsten verlassen Sie sich einfach auf einen guten Upscaler.

- Problem: Seltsame Verzerrungen an den Rändern oder am unteren Rand von Bildern — Das kann passieren, wenn die VAE (der Teil, der Bilder dekodiert) der KI Probleme hat. Ein Trick dabei ist, das „Tiling“ für die VAE zu aktivieren, falls die Option existiert, oder einfach beim Nachbearbeiten ein kleines Stück von den Rändern abzuschneiden. Vergewissern Sie sich, dass Sie das richtige VAE für das Modell verwenden, falls es sich um eine manuelle Einstellung handelt.

Wenn Sie diese Tipps befolgen und auf die häufigsten Schluckauf achten, werden Sie Ihre Ergebnisse erheblich verbessern. Der Schlüssel ist iterativ verfeinern — selbst Profis in der KI-Kunst versuchen mehrmals, den perfekten Clip zu bekommen. Bei jedem Versuch lernen Sie etwas Neues darüber, was WAN 2.1 mag oder nicht mag.

Einpacken

WAN 2.1 eröffnet eine Welt voller kreativer Möglichkeiten — es ist, als hätten Sie ein virtuelles Filmstudio, das auf Ihren Schreibtisch passt. Mit dieser Anleitung wissen Sie jetzt, wie Sie sie nutzen können: Wählen Sie die richtige Bildgröße, halten Sie Ihre Videos kurz und bündig, fügen Sie Audio hinzu, um das gewisse Etwas zu verleihen, und nutzen Sie den schrittweisen Arbeitsablauf, um von einer Idee zu einem ausgefeilten, KI-generierten Video zu gelangen. Wir haben den Jargon (Frames, Auflösung, FPS usw.) entmystifiziert und dir Insidertipps gegeben, wie du Flimmern und andere Fallstricke vermeiden kannst.

Jetzt sind Sie an der Reihe, Ihrer Fantasie freien Lauf zu lassen. Egal, ob Sie ein surreales Musikvideo für einen Song, eine animierte Konzeptgrafik für eine Geschichte oder einfach nur Spaß beim Erstellen von Meme-würdigen Clips haben möchten, WAN 2.1 ist ein unglaubliches Tool, das Ihnen zur Verfügung steht. Ein 19-Jähriger mit einer verrückten Idee und dieser KI kann etwas erschaffen, für das in der Vergangenheit ein ganzes Animationsteam gebraucht hätte — wie cool ist das?

Letzter Gedanke: Experimentieren Sie, genießen Sie den Prozess und haben Sie keine Angst davor, zu scheitern. Einige deiner Experimente werden komisch daneben liegen — das ist Teil des Lernens! Aber viele werden auch umwerfend sein. Wenn sich die KI-Technologie verbessert, wirst du bei dieser neuen Form der Inhaltserstellung an vorderster Front stehen. Verfeinern Sie also diese Eingabeaufforderungen und Einstellungen weiter, und Sie werden im Handumdrehen hochwertige KI-Videos wie ein Profi erstellen. Viel Spaß beim Erstellen! 🚀

%20(2).avif)

%20transparent.avif)