DreamActor M2.0 bringt erhebliche Verbesserungen in Bezug auf Qualität, Konsistenz und Kosteneffizienz.

DreamActor M2.0 ist offiziell in Promptus verfügbar.

Während viele KI-Motion-Tools noch in der Phase der „coolen Demo“ stecken, zielt DreamActor M2.0 eindeutig auf höhere Ziele — auf stabile, steuerbare, produktionsreife Bewegungsübertragung.

Das DreamActor M2.0-Modell steht Entwicklern direkt über Promptus zur Verfügung. Die Partnerplattform von BytePlus. Lassen Sie uns das alles zusammenfassen.

Was ist DreamActor M2.0?

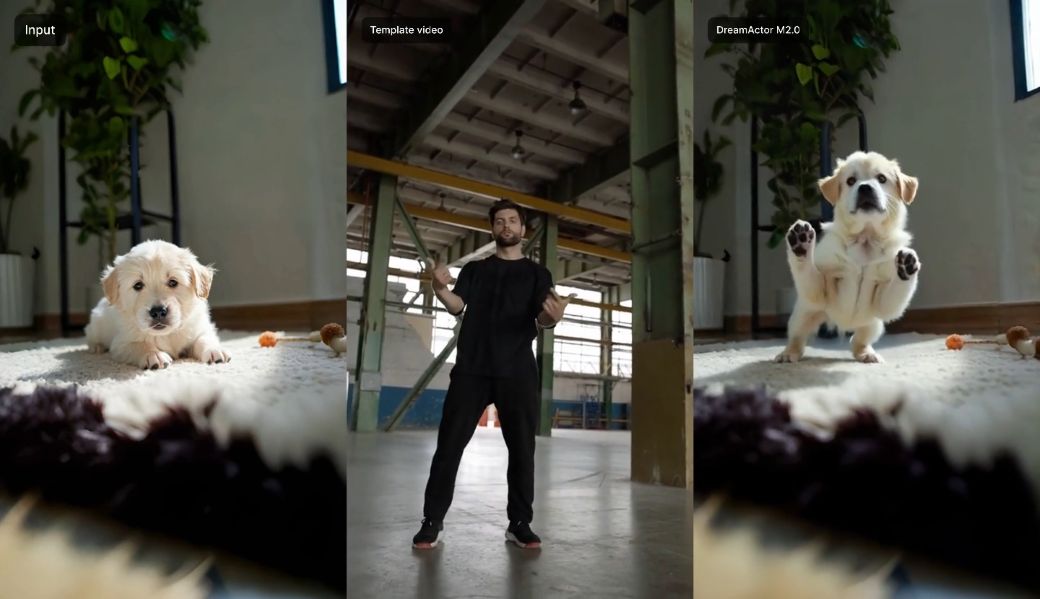

DreamActor M 2.0 ist eine nächste Generation KI-Bewegungssteuerungsmodell das ermöglicht es dir, einen Charakter zu animieren, indem du nur:

- Ein statisches Bild

- Ein Vorlagenvideo (Referenz)

Das Modell überträgt:

- Bewegung des Körpers

- Gesichtsausdrücke

- Lippenbewegungen

... vom Vorlagenvideo auf das Bild, während Wahrung der Identität, Struktur und Hintergrundkonsistenz des Subjekts während des gesamten Clips.

Das Ergebnis ist eine Bewegung, die sich bewusst, vollständig und weitaus stabiler anfühlt, als es die meisten Entwickler von KI-Motion-Tools gewohnt sind.

So funktioniert DreamActor M2.0

Im Kern ist DreamActor M2.0 ein großes modellgetriebenes Bewegungsübertragungssystem.

Hier ist der High-Level-Flow:

- Geben Sie ein Bild mit einem einzelnen Zeichen ein

Menschlicher, tierischer oder stilisierter/Anime-Charakter. - Geben Sie ein Vorlagenvideo ein

Dies definiert Bewegung, Gesichtsausdrücke und Lippensynchronität. - Bewegungsverständnis großer Modelle

Das System interpretiert Leistung ganzheitlich — nicht nur Bild für Bild, Pose Matching. - Konsistente animierte Ausgabe

Das generierte Video enthält:- Strukturelle Stabilität

- Konsistenz der Identität

- Kohärenz des Hintergrunds

Das macht DreamActor M2.0 besonders stark für komplexe Aktionen, Szenen mit mehreren Charakteren und nichtmenschliche Themen.

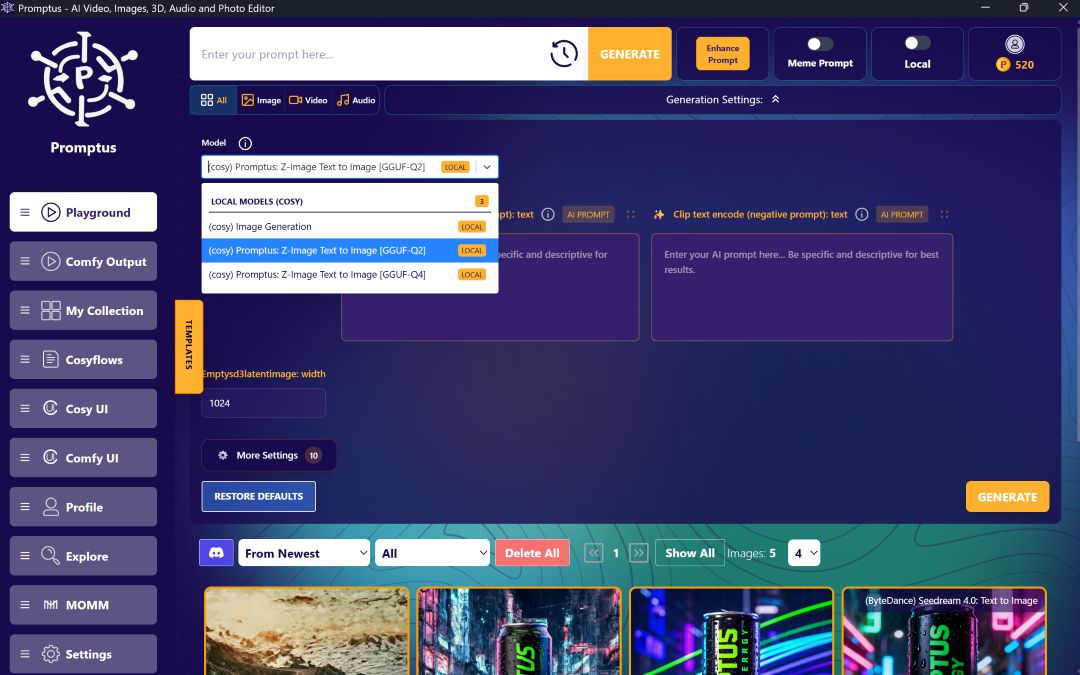

So verwenden Sie DreamActor M2.0 auf Promptus

Entwickler greifen direkt auf DreamActor M2.0 zu Promptus, eine Plattform zur KI-Erstellung und offizieller Partner von BytePlus.

Promptus fungiert als benutzerorientierte Umgebung wo Entwickler DreamActor M2.0 effizient und in großem Maßstab ausführen können.

Schritt 1: Lade dein Charakterbild hoch

Wählen Sie ein sauberes, klar definiertes Bild:

- Klare Gesichtszüge

- Stabile Körperproportionen

- Minimale Bewegungsunschärfe

DreamActor M2.0 funktioniert besonders gut mit:

- Tiere

- Anime und stilisierte Charaktere

- Nicht-menschliche IPs

Schritt 2: Laden Sie ein Vorlagenvideo hoch

Ihr Vorlagenvideo definiert die Leistung:

- Bewegung des Körpers

- Gesichtsausdrücke

- Lippenbewegung (falls ein Dialog involviert ist)

Die besten Ergebnisse erzielen Videos mit:

- Klare, lesbare Bewegung

- Stabile Rahmung

- Starke Ausdruckshinweise

Schritt 3: In Promptus konfigurieren und generieren

In Promptus können Benutzer:

- Wählen DreamActor M 2.0 als Bewegungssteuerungsmodell

- Kombinieren Sie Bild- und Vorlagenvideoeingänge

- Verwalte mehrere Läufe oder Varianten effizient

Promptus bietet eine optimierte Oberfläche für DreamActor M2.0 ausführen, ohne dass benutzerdefinierte Pipelines oder technischer Aufwand erforderlich sindund eignet sich daher sowohl für einzelne Entwickler als auch für Teams.

Schritt 4: Überprüfen und wiederholen

Nach der Generierung überprüfen Ersteller in der Regel:

- Vollständigkeit des Antrags

- Gesichts- und Körperstabilität

- Genauigkeit der Lippensynchronisation

- Identität und Konsistenz des Hintergrunds

Die Ausgänge von DreamActor M2.0 erfordern in der Regel weniger korrigierende Iteration im Vergleich zu früheren Bewegungssteuerungssystemen.

DreamActor M2.0 gegen Kling 2.6 Bewegungssteuerung

In umfassenden Evaluationen zeigt DreamActor M2.0 klare Leistungsvorteile über Kling 2.6 Motion Control.

Quantitative Ergebnisse

- GSB-Gesamtleistung: Verbesserung um +9,66% im Vergleich zu Kling 2.6

Das deutet auf mehr hin stabile, kontrollierbare und zuverlässige Ausgabequalität.

Qualitative Vorteile

DreamActor M2.0 übertrifft Kling 2.6 deutlich in:

- Fahren mit mehreren Agenten

Konsistentere Koordination zwischen mehreren Charakteren.

- Vollständigkeit der Aktion

Bewegungen fühlen sich erledigt an, nicht teilweise realisiert.

- Studienfach Strukturstabilität

Gesichter, Gliedmaßen und Körper behalten ihre Form über den Rahmen hinweg bei.

- Tier- und Anime-Konsistenz

Eines der stärksten Unterscheidungsmerkmale — weit weniger Verzerrungen bei nichtmenschlichen Inhalten.

Diese Stärken machen DreamActor M2.0 weitaus besser geeignet für echte Produktionsabläufe.

Vergleich der Preise

Kosteneffizienz ist ein weiterer großer Vorteil.

- Kling 2.6 Bewegungssteuerung ist 1,4× bis 2,24× teurer

- DreamActor M 2.0 bietet eine höhere Leistung zu einem niedrigeren Preis

Für Studios oder YouTuber, die in großem Maßstab produzieren, ist dieser Unterschied erheblich.

Weitere Preis- und API-Details für DreamActor im Promptus.

Für wen ist DreamActor M2.0 am besten geeignet?

DreamActor M2.0 ist besonders gut geeignet für:

- KI-Filmemacher und Videokünstler

- Studios, die Szenen mit mehreren Charakteren produzieren

- Projekte mit Tieren oder Anime-IP

- Teams, die konsistente, wiederholbare Ergebnisse benötigen

- Produktion umfangreicher Inhalte über Promptus

Wenn es dir wichtig ist Stabilität, Kontrolle und Skalierbarkeit, dieses Modell wurde ganz klar für Sie entworfen.

%20(2).avif)

%20transparent.avif)