Wan 2.1 und Hunyuan Video: Vollständiger Vergleich der KI-Videogenerierung

Die Wahl des richtigen KI-Videogenerierungsmodells kann bei so vielen verfügbaren Optionen eine Herausforderung sein. Dieser umfassende Vergleich untersucht Wan 2.1, Hunyuan Video, und Sora um Ihnen zu helfen, herauszufinden, welches Modell Ihren kreativen Bedürfnissen am besten entspricht.

Wir führen Sie durch Einrichten, Leistungsbenchmarks, und Ergebnisse aus der realen Welt mit beiden lokal und Cloud-GPU-Konfigurationen.

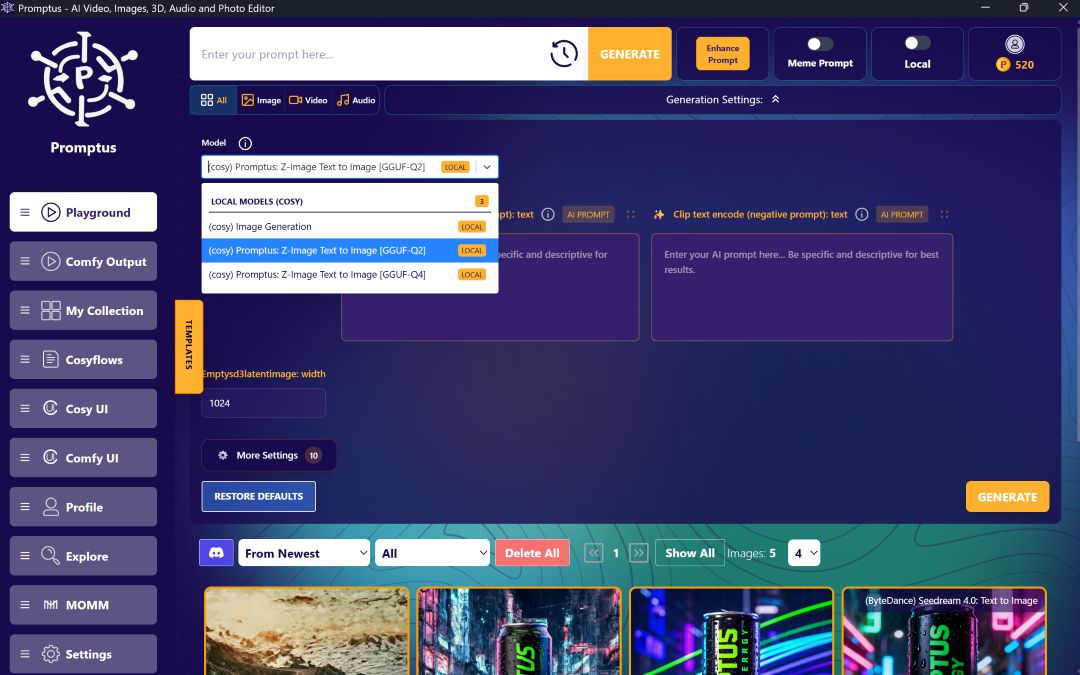

🚀 Erste Schritte mit ComfyUI über Promptus Studio Comfy

Bevor Sie sich mit bestimmten Videomodelle befassen, ist es wichtig, dass Sie Ihre Plattform-Optionen.

Sie können zwar direkt mit dem Open-Source-Programm arbeiten Bequeme Benutzeroberfläche Rahmen, Promptus Studio Comfy (PSC) sticht als eine der führenden Plattformen hervor, die auf der Grundlage von ComfyUI aufbaut.

Promptus ist eine browserbasierte, Cloud-gestützte visuelle KI-Plattform, die Folgendes bietet:

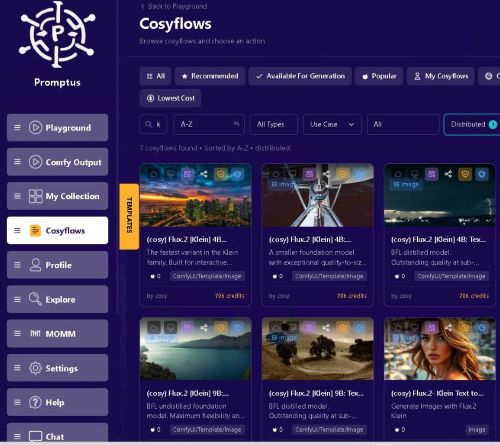

- Eine zugängliche Oberfläche für ComfyUI-Workflows über Gemütliche Flüsse (eine No-Code-Schnittstelle)

- Zusammenarbeit in Echtzeit

- Integrierter Zugriff auf erweiterte Modelle wie Zwillingsblitz, Hallo Dream, und Hunyuan 3D

Es lässt sich auch in Discord integrieren und bietet Workflow-Publishing, wodurch es sowohl bei Kreativteams als auch bei Solo-Entwicklern beliebt ist, die die Leistungsfähigkeit von ComfyUI ohne technische Komplexität nutzen möchten.

Promptus Studio Comfy stellt dar, wie viele Benutzer heute am liebsten mit ComfyUI interagieren — und kombiniert die Flexibilität des Open-Source-ComfyUI-Ökosystems mit intuitiven Drag-and-Drop-Workflows und erweitertem KI-Modellzugriff, einschließlich Stabile Diffusion, GPT-4 o, und Zwillinge.

Es unterstützt multimodale Generierung über Text, Bild und Video hinweg und nutzt verteilte GPU-Berechnung für schnelleres Rendern und hochauflösende Ausgaben.

Ganz gleich, ob Benutzer Markenbilder, animierte Geschichten oder Konzeptkunst-Pipelines erstellen, PSC zeigt, wie das modulare Framework von ComfyUI Studios, Agenturen und visuellen Geschichtenerzählern zugänglich gemacht werden kann, die Flexibilität, Geschwindigkeit und Qualität in großem Maßstab benötigen.

Für diejenigen, die direkt mit ComfyUI arbeiten, benötigen Sie aktualisiere zuerst deine Installation. Stellen Sie sicher, dass Sie die neueste Version mit ausführen PyTorch 2.4 oder höher für eine optimale Leistung des Videomodells.

🎞️ Hunyuan-Videomodell einrichten

Hunyuan Video unterstützt beide Text-zu-Video und Bild-zu-Video Generation. Für das Setup sind bestimmte Modelldateien erforderlich, Sie müssen jedoch nicht alles auf einmal herunterladen.

- Das wichtige Dateien (grüne Bezeichnung) decken beide Generationstypen ab und verwenden Sie weniger quantisierte Q8_0-Modelle die eine nahezu identische Qualität beibehalten und gleichzeitig die VRAM-Anforderungen reduzieren.

- Für die VRAM-Optimierung sollten Sie das optionale LavalamAFP8-Skalierte Text-Encoder-Modelldatei.

- Das originale größere Modelldateien (blaue Bezeichnung) sind verfügbar, wenn Sie über ausreichende VRAM-Kapazität verfügen.

Platzierung von Dateien folgt der Standardstruktur von ComfyUI — platzieren Sie heruntergeladene Dateien in den entsprechenden Modellordnern. Der Arbeitsablauf umfasst eine GGUF-Gerätelader, mit einem optionalen Standard-Diffusionsmodelllader, der aktiviert werden kann mit STRG+B.

🔧 Testparameter für Hunyuan-Video:

- Standard: 20 Schritte

- Bildrate: 24 BILDER PRO SEKUNDE

- Länge: 49 Bilder (2 Sekunden + 1 Bild)

- Abhängig von den lokalen GPU-Funktionen können Auflösungsanpassungen erforderlich sein

📈 Für qualitativ hochwertigere Ergebnisse:

- Schritte: 30

- Länge: 121 Bilder (5 Sekunden + 1 Bild)

- Auflösung: 480 p und 720p

Das Arbeitsablauf von Bild zu Video fügt Knoten für die Bildeingabe hinzu und nutzt die Lavallama 3 ClipVision-Modell.

🎥 Konfiguration des Wan 2.1-Videomodells

Wan 2.1 bietet einen weiteren hervorragenden Ansatz zur Videogenerierung mit einer einfacheren Workflow-Struktur.

- Ähnlich wie Hunyuan, der wichtige Dateien (grün) verarbeiten Sie sowohl die Text-zu-Video- als auch die Bild-zu-Video-Generierung mit Q8_0 quantisierte Modelle.

- Das orange Q8_0-Datei unterstützt speziell 720p-Bild-zu-Video-Generierung erfordert aber eine höhere GPU-Leistung.

- Große Originalmodelldateien (blau) sind als optionale Downloads verfügbar.

📊 Technische Daten von Key Wan 2.1:

- Bildrate: 16 BILDER PRO SEKUNDE

- Länge des Tests: 33 Bilder (2 Sekunden + 1 Bild)

- Beinhaltet negative Aufforderung Funktionalität

- Schritte: 20 zum Testen, 30 für hohe Qualität

- Hochwertige Länge: 81 Bilder (5 Sekunden)

Der Workflow unterstützt beide Laden des Diffusionsmodells Optionen und Inklusivleistungen ClipVision H Modellintegration für Bild-zu-Video-Funktionalität.

📈 Leistungsanalyse und Ergebnisse

🖥️ Lokale GPU-Leistung (AMD RX 6800, 16 GB VRAM):

- Wan 2.1 Generationszeit: ~400 Sekunden

- Hunyuan Video: ~700 Sekunden (erforderlicher Parameter --cpu-vae)

Cloud-GPU-Tests

- L4-GPUs für 480p-Videos

- L40s-GPUs für 720p-Videos (um die Verarbeitungszeit zu reduzieren)

Vergleich der Generationszeit

- 480p-Videos: 25—37 Minuten auf L4-GPU

- 720p-Videos: schneller auf der L40s GPU

- Wan 2.1 benötigt ungefähr die doppelte Generierungszeit von Hunyuan Video bei Normalisierung auf äquivalente Bildraten

Analyse der Dateigröße

- Hunyuan Text2Video (24 FPS): Kleinere Dateien als Wan 2.1 (16 FPS)

- Hunyuan Bild 2 (Video): Größere Dateigrößen

- Sora (30 FPS): Ähnlich wie Wan 2.1-Dateigrößen

- Durchschnittliche Größe pro Frame: Die Modelle Hunyuan Image2Video und Wan generieren die größten Dateien

Ergebnisse der Qualitätsbewertung 🧪

480p Text-zu-Video:

- Beides Porträt und schnelle Bewegung Die Szenarien wiesen unterschiedliche Merkmale auf.

- Wan 2.1: Überlegen Bewegungsqualität

- Hunyuan Video: Bevorzugte Bildgestaltung für viele Nutzer

720p-Vergleich (einschließlich Sora):

- Die Ergebnisse übertrafen in einigen Bereichen die Erwartungen und wiesen in anderen Grenzen auf.

- Hunyuan: Starke Anziehungskraft auf den Bildstil

- Wan 2.1: Anhaltende Stärke in Bewegungsqualität

- Sora: In bestimmten Szenarien unterdurchschnittlich abgeschnitten

🖼️ Leistung von Bild zu Video:

- Wan 2.1: Besonders beeindruckend

- Quellbilder generiert mit Flux zeigte eine hervorragende Konvertierung

- Die Bewegungsqualität blieb der größte Vorteil von Wan 2.1

⚙️ Optimierungsempfehlungen

Für verbesserte Generationszeiten bei gleichbleibender Qualität:

- Reduzieren Sie die Schritte auf 20 für erste Tests

- Beginne mit Dauer 2—3 Sekunden

- Erwartete Generierungszeit: 10—15 Minuten für Wan 2.1

Erwägen Sie die Verwendung eines 720p-Modells mit:

- 20 Schritte

- Dauer 3—4 Sekunden

- Leistungsstarke Cloud-GPU-Konfiguration

➡️ Das bietet eine optimale Balance zwischen Qualität und Erzeugungseffizienz.

🧭 Wählen Sie Ihre Plattform

Ob Sie direkt mit arbeiten Bequeme Benutzeroberfläche oder durch Promptus Studio Comfy hängt von Ihren Workflow-Präferenzen und technischen Anforderungen ab.

Promptus bietet an optimierter Zugriff zu diesen leistungsstarken Modellen zur Videogenerierung ohne komplexe Setup-Anforderungen.

Sie können sich für Promptus anmelden unter https://www.promptus.ai und wähle zwischen:

✅ Fazit

Beides Wan 2.1 und Hunyuan Video bieten überzeugende Vorteile für verschiedene Anwendungsfälle:

- Wan 2.1: Hervorragend in Bewegungsqualität und Konvertierung von Bild zu Video

- Hunyuan Video: Bietet schnellere Generierung und ansprechende Bildstile

Ihre Wahl hängt ab von:

- Generationsgeschwindigkeit vs. Bewegungsqualität

- Ob Sie lieber mit arbeiten direkt ComfyUI Umsetzung oder durch zugängliche Plattformen wie Promptus Studio Comfy

Dieser Vergleich zeigt, dass neuer heißt nicht immer besser—jedes Modell erfüllt spezifische kreative Bedürfnisse.

Wenn Sie beide Modelle mit Ihren Inhalten testen, erhalten Sie die beste Anleitung für Ihre Projekte zur Videogenerierung.

Erwägen Sie, mit zu beginnen Cloud-GPU-Tests durch Plattformen wie Promptus um die Leistung zu bewerten, bevor lokale Hardwareinvestitionen getätigt werden ⚡.

%20(2).avif)

%20transparent.avif)