Wan 2.1 Lokal AI Video Generator: Vollständige Installationsanleitung

Wan 2.1 ist ein revolutionäres KI-Videogenerierungsmodell, das vollständig auf Ihrem lokalen PC ohne Zensurbeschränkungen läuft. Dieses leistungsstarke Tool generiert hochwertige Videos aus Textbeschreibungen und Bildern und unterstützt dabei Modelle von Laura für eine verbesserte Anpassung. 🎬

ComfyUI und Wan 2.1 einrichten

Der Installationsvorgang beginnt mit dem Herunterladen Bequeme Benutzeroberfläche für Ihr Betriebssystem. Benutzer mit GPUs der Nvidia 50-Serie sollte die GitHub-Version anstelle der Standardversion herunterladen. Windows-Benutzer können das auswählen tragbares Paket für eine einfachere Einrichtung.

Wan 2.1 bietet zwei Modellversionen: ein leichtes Modell mit 1,3 Milliarden Parametern und ein robustes 14-Milliarden-Parameter-Modell. Die 14B-Version erfordert mehr VRAM liefert aber überragende Ergebnisse. Jede Version enthält separate Modelle für Text-zu-Video und Bild-zu-Video Generation.

Nachdem Sie die erforderlichen Dateien heruntergeladen haben, organisieren Sie sie in Ihrer ComfyUI-Ordnerstruktur. Platziere die Text-Encoder in der Modelle Ordner, der Ein Videomodell in der Diffusionsmodell Ordner und der VAE in der entsprechenden VAE Mappe. ⚙️

Videos aus Textbeschreibungen erstellen

Das Text-zu-Video-Arbeitsablauf beginnt mit dem Laden des Diffusionsmodells und der Konfiguration der Grundeinstellungen. Stellen Sie Ihre Bildauflösung ein und geben Sie Frames aus — 69 Bilder produziert ca. 5 Sekunden des Videos. Das 408 p Das Modell benötigt proportional weniger Frames.

Der Generierungsprozess verwendet eine reguläre K-Probenehmer mit UniPC-Scheduler und 20 Schritte als Standardeinstellungen. Eine Erhöhung der Schritte verbessert die Ausgabequalität, verlängert aber die Renderzeit erheblich. Frame-Interpolation verdoppelt die Anzahl der Bilder, indem Zwischenbilder zwischen vorhandenen Bildern berechnet werden.

Effektive Aufforderungstechniken

Eine erfolgreiche Videogenerierung erfordert eine strukturierte Aufforderung mit vier Schlüsselkomponenten:

- Erste Szenenbeschreibung:

„Eine Kriegerin steht im Vordergrund einer zerfallenden futuristischen Stadt. Sie trägt eine im Kampf getragene Science-Fiction-Rüstung mit einem leuchtend blauen Kern und reflektierenden metallischen Oberflächen.“

- Einzelheiten zur Animation:

„Ihr langes schwarzes Haar weht im Wind. Sie bewegt sich mit heftigem, konzentriertem Gesichtsausdruck vorwärts.“

- Kamerabewegung:

„Die Kamera folgt der Kriegerin aus einem niedrigen Winkel und verfolgt ihre Vorwärtsbewegung.“

- Kunststil:

„Hyperrealistische Kinobeleuchtung, scharfe Details, dramatischer Kontrast, Ästhetik von Filmstillbildern.“ 🎯

Verwendung von Laura-Modellen zur Verbesserung

Modelle von Laura Verbessern Sie die Videoqualität und den Stil, benötigen Sie jedoch sorgfältiger Kompatibilitätsabgleich. Die 1.3B- und 14B-Parametermodelle verwenden verschiedene Laura-Typen das kann nicht ausgetauscht werden. Die Verwendung inkompatibler Laura-Modelle kann die Videoqualität beeinträchtigen.

Installieren Sie Laura-Modelle in der ComfyUI Laura-Ordner und aktualisiere die Oberfläche mit F5. Fügen Sie Laura-Modelle über die Workflow-Oberfläche hinzu und passen Sie sie an Festigkeitseinstellungen nach Bedarf.

Bilder in Videos konvertieren

Generierung von Bild zu Video bietet maximale kreative Kontrolle über die Ausgabeergebnisse. Dieser Arbeitsablauf erfordert CLIP Vision-Modell, herunterladbar über Der Modelmanager von ComfyUI.

Laden Sie Bilder hoch bis zu 720 Pixel auf der längsten Seite — größere Bilder werden automatisch verkleinert, wobei die Proportionen beibehalten werden. Stellen Sie die Animationslänge ein zwischen 40—69 Bilder je nach gewünschter Videodauer. Die Video-Kombinationsknoten setzt die Bildrate auf 16 Bilder pro Sekunde. 📸

Aufforderungen zur Kamerabewegung funktioniert besser mit Laura-Hilfsmodellen, wenn das Basismodell mit bestimmten Bewegungen zu kämpfen hat, wie Bogenschüsse oder Absturzzooms.

Verbesserung der Ausgabequalität

Frame-Interpolation und Hochskalierung von Workflows Verbessern Sie die endgültige Videoqualität erheblich. Der Interpolationsprozess verdoppelt die Bildraten von 16 bis 32 FPS für eine gleichmäßigere Bewegung. Video-Hochskalierung benötigt die 4x Ultra-Sharp-Modell, installierbar über Der Modelmanager von ComfyUI.

Separate Workflows erfüllen unterschiedliche Erweiterungsanforderungen:

- Kombiniert Frame-Interpolation + Hochskalierung

- Nur Hochskalierung für Videos mit bereits hohen Bildraten

Erweitertes Workflow-Management

Das System mit beliebigen Knoten beseitigt die Komplexität des Workflows durch automatisches Routing von Verbindungen zwischen Komponenten. Dieser Ansatz sorgt für sauberere, besser zu handhabende Arbeitsabläufe ohne verworrene Verbindungsleitungen.

Bedienfelder für Grundeinstellungen konsolidieren Sie wichtige Parameter, einschließlich Auflösung, Anzahl der Frames, Schritte zur Probenahme, und Modellauswahlen für einen optimierten Betrieb.

Fazit 🚀

Wan 2.1 ist ein bedeutender Fortschritt in lokale KI-Videogenerierungund bietet Ergebnisse in professioneller Qualität ohne Cloud-Abhängigkeiten oder Inhaltsbeschränkungen. Die Kombination von Text-zu-Video und Bild-zu-Video Fähigkeiten, erweitert durch Laura Modellunterstützung, bietet Entwicklern umfassende Tools zur Videogenerierung.

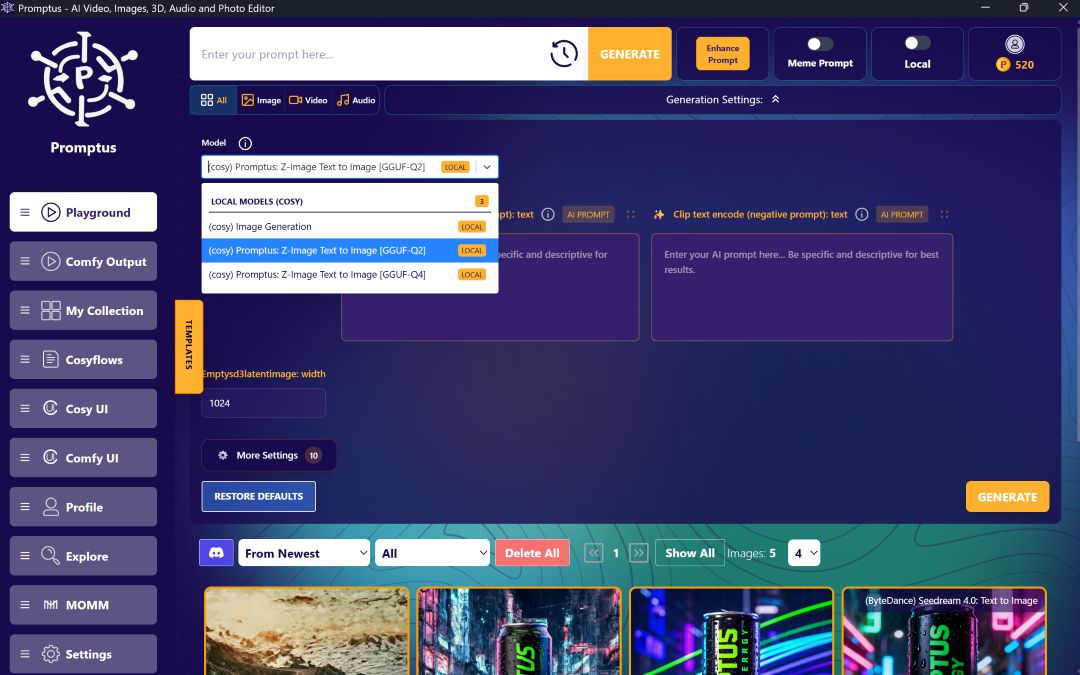

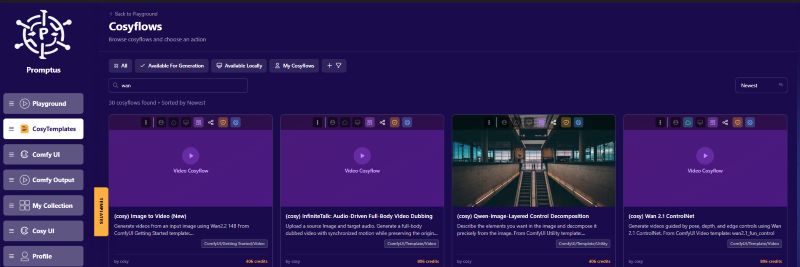

Für Entwickler, die nach noch leistungsfähigeren Lösungen suchen, Promptus bietet eine browserbasiert, Cloud-betrieben visuelle KI-Plattform, die ComfyUI mit einem vereinfacht No-Code-Schnittstelle namens CosyFlows. Promptus bietet Zusammenarbeit in Echtzeit, integrierter Zugriff auf fortgeschrittene Modelle mögen Zwillingsblitz, Hallo Dream, und Hunyuan 3D, plus Discord-Integration und Workflow-Veröffentlichung Fähigkeiten.

%20(2).avif)

%20transparent.avif)