Was du bauen oder lernen wirst

Erfahren Sie, wie Sie ControlNet-Workflows in ComfyUI einrichten und ausführen, um eine präzise Posensteuerung, Kantenerkennung und tiefengesteuerte Generierung mit praktischen Einstellungen und Problemlösungen zu ermöglichen.

Das hybride Entscheidungsframework für die Ausführung und eine erweiterte Präprozessor-Vergleichstabelle wurden hinzugefügt, die auf SDXL-Kompatibilitätstests basiert.

Verfasst von Marcus Chen, Leiter des technischen Inhalts

Seit 2023 baue ich ControlNet-Pipelines für Spielestudios und Solo-Entwickler. Ich habe praktische Erfahrung darin, Workflow-Fehler zu debuggen und die Renderkosten in lokalen und Cloud-Umgebungen zu optimieren.

Einführung

Das Generieren von KI-Bildern mit konsistenten Posen, Kompositionen oder Beleuchtung erfordert mehr als Textanfragen. ControlNet gibt Ihnen die Kontrolle über die Struktur, indem Referenzbilder als Leitfaden für die Generierung verwendet werden. So können Sie exakte Körperhaltungen beibehalten, während Sie Charakterdesigns ändern, oder architektonische Layouts beibehalten, während Sie Materialien und Stile ändern. Dieses Tutorial zeigt Ihnen, wie Sie funktionierende ControlNet-Workflows in ComfyUI erstellen, die richtigen Modelle für Ihre Referenzen auswählen und Einstellungen anpassen, um sowohl kreative Flexibilität als auch präzise Steuerung zu gewährleisten.

Was du bauen oder lernen wirst

- Richten Sie drei ControlNet-Core-Modelle (Canny, OpenPose, Depth) in ComfyUI mit den richtigen Präprozessoren ein

- Erstelle einen kompletten Arbeitsablauf, der die Genauigkeit der Pose beibehält und gleichzeitig Charaktervariationen generiert

- Passen Sie die Stärke und die Präprozessor-Einstellungen an, um Kontrolle und kreative Freiheit in Einklang zu bringen

- Wählen Sie je nach den Eigenschaften Ihres Referenzbilds zwischen ControlNet-Typen

- Beheben Sie häufig auftretende Fehler wie nicht übereinstimmende Modelle, verzerrte Ausgänge und langsame Leistung

- Treffen Sie fundierte Entscheidungen über die lokale und die Cloud-Ausführung in verschiedenen Projektphasen

Voraussetzungen

- ComfyUI ist lokal installiert und läuft oder über eine kompatible Schnittstelle aufgerufen wird

- Mindestens 8 GB VRAM für SD 1.5-Modelle, 12 GB für SDXL ControlNet-Modelle

- Ein Stable Diffusion Checkpoint wurde heruntergeladen (SD 1.5 oder SDXL, je nach Ihrer ControlNet-Wahl)

- ComfyUI Manager für vereinfachte Modell-Downloads installiert

- Ein klares Referenzbild, mit dem Sie arbeiten können, z. B. ein Posenfoto, eine Architekturskizze oder eine Tiefenreferenz

Gemeinsamer Haken: ControlNet-Modelle sind versionsspezifisch. SD 1.5 ControlNet-Modelle funktionieren nicht mit SDXL-Checkpoints. Überprüfen Sie Ihre Checkpoint-Version, bevor Sie ControlNet-Modelle herunterladen.

Anleitung Schritt für Schritt

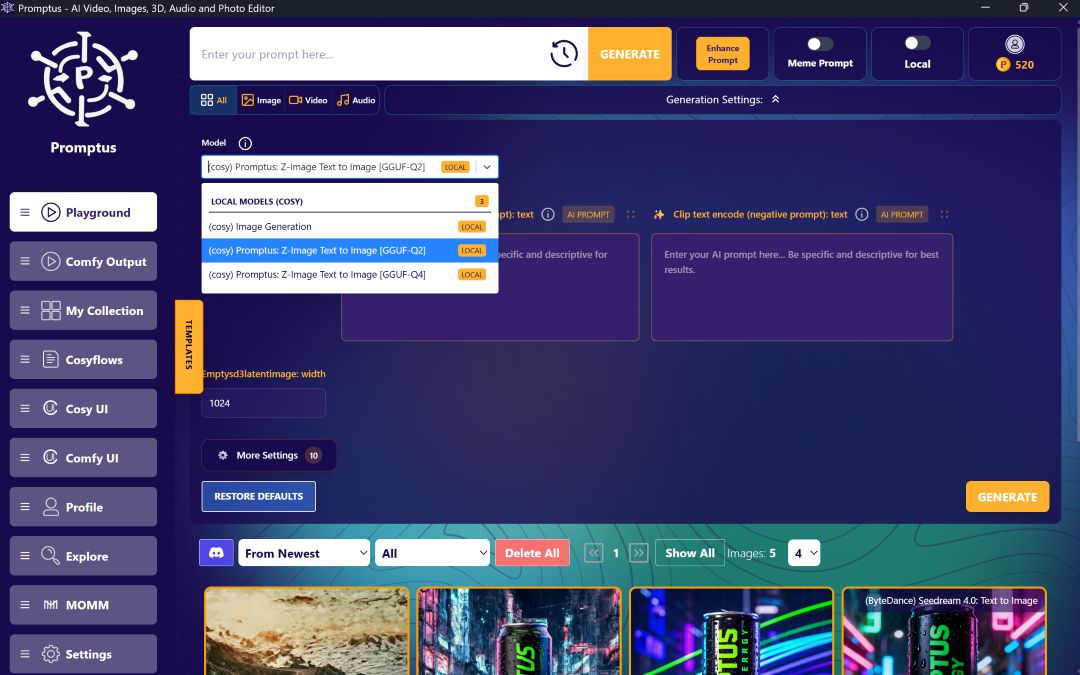

Schritt 1: Laden Sie ControlNet-Modelle über den ComfyUI Manager herunter

Öffnen Sie ComfyUI und greifen Sie auf die Manager-Oberfläche zu. Navigieren Sie zu Install Models und suchen Sie dann im Modellbrowser nach ControlNet.

Laden Sie diese drei Modelle für SD 1.5 herunter:

- control_v11p_sd15_canny (236 MB, funktioniert mit Kantenerkennung)

- control_v11p_sd15_openpose (1,45 GB, verfolgt die menschliche Skelettstruktur)

- control_v11f1p_sd15_depth (1,45 GB, bewahrt die räumliche Tiefe)

Laden Sie für SDXL-Benutzer Folgendes herunter:

- diffusers_xl_canny_mid (2,5 GB)

- thibaud_xl_openpose (2,5 GB)

Jeder Download dauert je nach Verbindungsgeschwindigkeit zwischen 3 und 12 Minuten. Der Manager platziert Dateien automatisch in models/controlnet/. Keine manuelle Ordnernavigation erforderlich.

Schritt 2: ControlNet-Präprozessorknoten installieren

Gehen Sie immer noch im Manager zu Install Custom Nodes und suchen Sie nach „ComfyUI's ControlNet Auxiliary Preprocessors“. Klicken Sie auf Installieren und warten Sie, bis der Vorgang abgeschlossen ist. Dieses Paket enthält alle Präprozessorknoten, die Referenzbilder in Kontrollkarten umwandeln.

Starten Sie ComfyUI nach der Installation vollständig neu. Die neuen Knoten werden unter Knoten hinzufügen, Image und dann ControlNet-Präprozessoren angezeigt.

Schritt 3: Erstellen Sie die Basis-Workflow-Struktur

Erstellen Sie einen neuen Workflow und fügen Sie diese Knoten der Reihe nach hinzu:

- Bild laden (um Ihre Referenz zu importieren)

- AIO-Präprozessor oder spezifischer Präprozessor wie OpenPose Preprocessor (konvertiert Referenz in Control Map)

- ControlNet-Modell laden (lädt Ihre gewählte ControlNet-Datei)

- ControlNet anwenden (verbindet Steuerdaten mit der Generierungspipeline)

- Load Checkpoint (Ihr Stable Diffusion-Modell)

- Aufforderung zur CLIP-Textkodierung (positive Aufforderung)

- Aufforderung zur CLIP-Textkodierung (negative Aufforderung)

- Leeres latentes Bild (legt die Ausgabeabmessungen fest)

- KSampler (führt die Generierung durch)

- VAE-Decodierung (wandelt latentes in sichtbares Bild um)

- Bild speichern (Ergebnis ausgeben)

Verbinde sie in diesem Flow: Die Load Image-Ausgabe geht zur Präprozessor-Eingabe. Die Präprozessor-Ausgabe und die ControlNet-Modellausgabe gehen beide zum Apply ControlNet-Knoten. Wenden Sie den ControlNet-Ausgang an, der zusammen mit Ihrem Checkpoint und den Eingabeaufforderungen mit dem KSampler-Konditionierungseingang verbunden wird.

Schritt 4: Konfigurieren Sie Ihre erste OpenPose-Generation

Laden Sie ein Referenzbild, das eine Person in einer klaren Pose mit sichtbaren Armen und Beinen zeigt. Verwenden Sie in Ihrem OpenPose-Präprozessor-Knoten die folgenden Starteinstellungen:

- Auflösung: entspricht Ihrer Referenzbildbreite (normalerweise 512 oder 768)

- Hand erkennen: Aktiviere, wenn Hände sichtbar und wichtig sind

- Detect Body: immer aktivieren

- Gesicht erkennen: für Portraits aktivieren

Führen Sie zuerst nur den Präprozessorknoten aus. Sie sollten eine Strichmännchen-Skelettkarte mit erkannten Gelenken und Gliedmaßen sehen. Diese Map wird zu deinem Steuersignal. Wenn das Skelett falsch aussieht oder Gliedmaßen fehlen, ist Ihr Referenzbild möglicherweise schlecht sichtbar oder hat ungewöhnliche Winkel.

Stellen Sie im Knoten Apply ControlNet Folgendes ein:

- Stärke: 0,75 (Startpunkt)

- Startprozentsatz: 0,0

- Endprozent: 1,0

Diese Prozentsätze bestimmen, wann während des Probenahmeprozesses ControlNet angewendet wird. Wenn sie bei 0,0 und 1,0 gehalten werden, gilt die Kontrolle während der gesamten Generierung.

Verwenden Sie in Ihrem KSampler:

- Schritte: 25

- CFG: 7,0

- Sampler: DPM++ 2M Karras

- Planer: Karras

Schreiben Sie eine beschreibende Aufforderung wie „Fantasy-Krieger in Kampfrüstung, dramatische Beleuchtung, digitaler Kunststil, hohe Detailgenauigkeit“. Das OpenPose-Steuerelement behält Ihre Referenzpose unabhängig vom Inhalt der Aufforderung bei.

Generieren und untersuchen Sie Ergebnisse. Das Ausgabezeichen sollte Ihrer Referenzposenstruktur entsprechen und gleichzeitig den visuellen Stil Ihrer Eingabeaufforderung übernehmen.

Schritt 5: Passen Sie die Stärke an Ihre kreativen Ziele an

Die ControlNet-Stärke bestimmt, wie strikt die Generierung der Kontrollkarte folgt. Führen Sie denselben Arbeitsablauf dreimal mit unterschiedlichen Stärkewerten aus: 0,5, 0,75 und 1,0.

Bei 0,5 sehen Sie eine lockere Ähnlichkeit der Posen, aber deutliche Unterschiede in den Winkeln und Proportionen der Gliedmaßen. Verwenden Sie diese Option, wenn Sie eine kreative Neuinterpretation wünschen.

Bei 0,75 entspricht die Posenstruktur sehr gut und ermöglicht gleichzeitig eine natürliche künstlerische Variation der Details. Dies ist die vielseitigste Produktreihe für Produktionsarbeiten.

Bei einem Wert von 1,0 hängt die Ausgabe fest mit der Kontrollkarte zusammen, was oft zu steifen oder unnatürlichen Ergebnissen führt, denen es an organischem Fluss mangelt.

Für die meisten Charakterarbeiten bietet eine Stärke zwischen 0,65 und 0,8 die beste Balance.

Warum das funktioniert

ControlNet arbeitet, indem es zusätzliche Konditionierung in den Entrauschungsprozess des Diffusionsmodells einführt. Bei jedem Probenahmeschritt erhält das Modell sowohl eine Textkonditionierung durch Ihre Eingabeaufforderung als auch eine strukturelle Konditionierung durch die Kontrollkarte. Der Stärkeparameter skaliert, wie viel Gewicht die Kontrollkonditionierung im Vergleich zur Textkonditionierung erhält.

Bei geringerer Stärke dominieren Textanfragen, was mehr kreative Freiheit bietet, aber weniger strukturelle Genauigkeit bietet. Eine höhere Stärke zwingt die Generierung dazu, sich an die Struktur der Kontrollkarte anzupassen, wodurch Variationen reduziert werden. Der Optimalwert hängt davon ab, ob Sie kreativ forschen (niedriger Wert) oder ob Sie die Konsistenz einer Serie beibehalten (höher).

Der Präprozessor konvertiert Ihr Referenzbild in ein Format, das das ControlNet-Modell versteht. Jeder Präprozessor extrahiert unterschiedliche Strukturinformationen: Kanten, Posen, Tiefen oder Normalen. Das ControlNet-Modell wurde speziell für diesen Informationstyp trainiert, weshalb es von entscheidender Bedeutung ist, den Präprozessor an das Modell anzupassen.

ControlNet-Bereich

ControlNet-Modelle und Präprozessoren: Was sie tun

ControlNet gibt Ihnen die strukturelle Kontrolle über die Generierung, indem vorverarbeitete Referenzbilder als Leitsignale verwendet werden. Anstatt sich ausschließlich auf Texteingaben zu verlassen, stellen Sie ein Bild bereit, das die räumliche Struktur, Zusammensetzung oder Pose definiert. Das ControlNet-Modell interpretiert diese Struktur und leitet den Generierungsprozess, um diese Merkmale beizubehalten und gleichzeitig Ihrer Texteingabe in Bezug auf Stil und Inhalt zu folgen.

Mini-Workflow für die Erkennung unauffälliger Kanten

Canny ControlNet eignet sich gut für architektonische Referenzen, Strichzeichnungen und scharfkantige Kompositionen.

Fügen Sie diese Knoten hinzu:

- Bild laden (deine Referenz)

- Canny Edge-Präprozessor

- ControlNet-Modell laden (wählen Sie control_v11p_sd15_canny)

- ControlNet anwenden

- Kette der Standardgeneration

Passen Sie im Canny Preprocessor Folgendes an:

- Niedriger Schwellenwert: 50 bis 150 (niedrigere Werte erkennen mehr Kanten, einschließlich Rauschen)

- Hoher Schwellenwert: 150 bis 300 (höhere Werte erkennen nur starke Kanten)

Beginnen Sie mit einem niedrigen Schwellenwert von 100, einem hohen Schwellenwert von 200. Wenn die Edge-Map zu viele unerwünschte Details enthält, erhöhen Sie beide Schwellenwerte um 50. Wenn wichtige Kanten fehlen, senken Sie sie ab.

Canny Strength liegt in der Regel niedriger als OpenPose, zwischen 0,5 und 0,7, da die Kantensteuerung bei höheren Werten visuell dominieren kann.

Leitfaden zur Auswahl des Präprozessors

Ihr Referenzbildtyp bestimmt, welcher Präprozessor und welches Modell verwendet werden sollen:

Für menschliche Posen und Charakterarbeit: OpenPose-Präprozessor mit Openpose-Modell. Funktioniert am besten, wenn der gesamte Körper oder der Oberkörper deutlich sichtbar ist. Kämpft mit extremen Winkeln oder teilweiser Okklusion.

Für Architekturfotos, technische Zeichnungen oder Grafikdesigns: Canny Preprocessor mit Canny Model. Hervorragend geeignet, um gerade Linien und geometrische Strukturen beizubehalten. Weniger nützlich für organische Motive wie Portraits.

Zur Aufrechterhaltung der räumlichen Tiefe in Szenen: Tiefenpräprozessor (MIDAS oder Zoe) mit Tiefenmodell. Bewahrt die Beziehungen zwischen Vordergrund und Hintergrund sowie die räumliche Schichtung bei. Unverzichtbar, wenn Sie die Tageszeit oder die Beleuchtung ändern und gleichzeitig die Szenenkomposition beibehalten möchten.

Für eine detaillierte Oberflächenstruktur: Normal Map Preprocessor mit normalem Modell. Erfasst feine Oberflächengeometrien wie Stofffalten oder Gesichtsdetails. Erweiterter Anwendungsfall, der saubere Referenzbilder erfordert.

Für grobe Skizzen und Scribbles: Scribble-Präprozessor mit Scribble-Modell. Macht aus losen Zeichnungen geführte Generationen. Nützlich für die Erkundung von Konzepten anhand von Handskizzen.

Tabelle mit schnellen Entscheidungen:

Referenztyp | Präprozessor | Typische Stärke | Am besten geeignet für

Ganzkörper des Menschen | OpenPose | 0,7 bis 0,85 | Zeichenkonsistenz

Portrait-Nahaufnahme | Clever oder Normal | 0,5 bis 0,7 | Gesichtsstruktur

Architektur | Canny | 0,5 bis 0,7 | Gebäudepläne

Landschaftstiefe | Tiefe | 0,6 bis 0,8 | Szenenzusammensetzung

Handgezeichnete Skizze | Scribble | 0,4 bis 0,6 | Konzeptentwicklung

Produktfotografie | Normal | 0,6 bis 0,8 | Oberflächendetail

Sie können mehrere ControlNets in einem Workflow stapeln, indem Sie nacheinander mehrere Apply ControlNet-Knoten hinzufügen. Verwenden Sie beispielsweise OpenPose für die Körperstruktur und Depth für die Szenenkomposition gleichzeitig. Jedes ControlNet sollte bei gestapelter Ausführung mit geringerer Stärke laufen, in der Regel jeweils 0,5 bis 0,6, um eine zu starke Generierung zu vermeiden.

Häufige Fehler und Korrekturen

Symptom: Das generierte Bild ignoriert die Kontrollkarte vollständig

Mögliche Ursache: ControlNet-Modell und Präprozessortyp stimmen nicht überein, oder der Apply ControlNet-Knoten ist nicht richtig mit der Konditionierung verbunden

Behebung: Stellen Sie sicher, dass Ihr Präprozessor-Ausgabetyp Ihrem ControlNet-Modelltraining entspricht. Prüfen Sie, ob der Apply ControlNet-Knoten mit dem positiven Konditionierungseingang Ihres KSamplers verbunden ist. Lassen Sie den Präprozessorknoten separat laufen, um sich zu vergewissern, dass er eine sichtbare Ausgabe erzeugt, bevor Sie die Problembehandlung fortsetzen.

Symptom: Die Ausgabe sieht verzerrt aus und es entstehen seltsame Körperproportionen oder verschmolzene Gesichtszüge

Mögliche Ursache: ControlNet-Stärke ist zu hoch eingestellt oder der Präprozessor hat eine falsche Struktur im Referenzbild erkannt

Fix: Stärke auf 0,6 senken und regenerieren. Untersuchen Sie die Präprozessor-Ausgabekarte. Wenn die Skelett- oder Kantenerkennung falsch aussieht, weist Ihre Referenz möglicherweise eine schlechte Beleuchtung oder ungewöhnliche Winkel auf. Versuchen Sie es mit einem klareren Referenzbild oder passen Sie die Schwellenwerte für die Erkennung durch den Präprozessor an.

Symptom: Die Pose ist ungefähr korrekt, aber Finger und Hände sehen deformiert aus

Mögliche Ursache: Die OpenPose-Handerkennung ist deaktiviert oder die Hände des Referenzbilds sind zu klein, um erkannt zu werden

Fix: Aktiviere „Detect Hand“ im OpenPose Preprocessor-Knoten. Wenn die Hände immer noch falsch sind, sind sie in Ihrer Referenz möglicherweise zu klein. Verwenden Sie bei größeren Händen einen genaueren Schnitt oder eine andere Referenz. Die Handgenerierung bleibt auch mit ControlNet eine Herausforderung.

Symptom: Die Generierung dauert lokal 10 Minuten oder länger

Mögliche Ursache: Ausgabe mit hoher Auflösung bei begrenztem VRAM oder zu viele Abtastschritte

Fix: Reduzieren Sie die Ausgabeauflösung zum Testen auf 512x512. Senken Sie die KSampler-Schritte auf 20. Sobald Sie die Einstellungen eingegeben haben, verwenden Sie eine höhere Auflösung und Schritte nur für endgültige Renderings. Erwägen Sie die Cloud-Ausführung für Batches mit hoher Auflösung.

Symptom: Die Vorschau der Kontrollkarte sieht korrekt aus, aber die Generierung folgt ihr immer noch nicht

Mögliche Ursache: Zu niedrige Stärke oder zu hohe CFG-Skala, wodurch die Textaufforderung dominiert

Fix: Erhöhen Sie die ControlNet-Stärke auf 0,8. Senken Sie die CFG-Skala auf 6,0. Ein CFG über 9,0 kann die ControlNet-Konditionierung überfordern. Gleichen Sie beide Parameter aus, um Ihr Zielkontrollniveau zu ermitteln.

Symptom: Die Ergebnisse variieren stark zwischen den Generationen, obwohl dieselben Einstellungen verwendet werden

Wahrscheinliche Ursache: Der KSampler-Seed wurde auf Randomisierung statt auf einen festen Wert gesetzt

Behebung: Stellen Sie in KSampler einen festen Startwert ein, um die Konsistenz aufrechtzuerhalten. Wenn Sie eine gute Generation gefunden haben, notieren Sie sich ihre Startnummer und verwenden Sie sie für Variationen erneut. Ändern Sie zwischen den Durchläufen nur die Prompt- oder ControlNet-Stärke, um zu ermitteln, welche Auswirkungen die einzelnen Parameter haben.

Fortgeschrittene Varianten

Variante 1: Multi-ControlNet Composition Control

Stapeln Sie OpenPose für die Charakterpose und Depth für das Szenenlayout in einem einzigen Arbeitsablauf. Fügen Sie nacheinander zwei separate Apply ControlNet-Knoten hinzu. Der erste Apply ControlNet übernimmt Ihre Basiskonditionierung, der zweite die Ausgabe der ersten.

Verwenden Sie diese Einstellungen:

- OpenPose-Stärke: 0,6

- Tiefenstärke: 0,5

Diese Kombination behält die Körperhaltung des Charakters bei und bewahrt gleichzeitig die räumlichen Beziehungen im Hintergrund. Nützlich beim Platzieren von Charakteren in bestimmten Szenenkompositionen. Eine geringere Festigkeit bei beiden Komponenten verhindert eine Überbeanspruchung, die zu starren, künstlichen Ergebnissen führen würde.

Verwendungszweck: Platzierung der Charaktere in etablierten Umgebungen, Anpassung an bestehende Szenenfotos, Beibehaltung einheitlicher Hintergründe für die gesamte Charakterserie.

Variante 2: Partielle ControlNet-Anwendung mit Start- und Endprozentsätzen

Anstatt ControlNet während des gesamten Generierungsprozesses anzuwenden, beschränken Sie es auf bestimmte Probenahmephasen.

Stellen Sie die Parameter Apply ControlNet ein:

- Startprozentsatz: 0,0

- Endprozent: 0,5

- Stärke: 0,9

Dadurch wird eine strenge Kontrolle nur in der ersten Hälfte der Probenahme angewendet, wenn sich eine grobe Zusammensetzung bildet, und in der zweiten Hälfte, wenn sich Details entwickeln, wird die Kontrolle aufgehoben. Die Ergebnisse folgen locker Ihrer Kontrollstruktur und gewinnen gleichzeitig mehr Gestaltungsspielraum bei den Oberflächendetails.

Alternative: Beginnen Sie bei 0,4 und enden Sie bei 1,0, um die Steuerung nur während der Detailverfeinerungsphase anzuwenden. Nützlich, wenn Sie eine kreative Komposition wünschen, aber eine spezifische Detailanpassung benötigen.

Einsatzgebiet: Exploratives Arbeiten, bei denen Sie eine Strukturführung ohne starre Einschränkungen benötigen, oder wenn Sie ControlNet mit anderen Techniken wie img2img kombinieren, die mit phasengetrennter Steuerung besser funktionieren.

Entscheidungsleitfaden für lokale und cloudbasierte Ausführung

Die lokale GPU-Ausführung ist bei der Workflow-Entwicklung und Parameteruntersuchung sinnvoll. Wenn Sie verschiedene ControlNet-Modelle testen, Stärkewerte anpassen oder mit Präprozessor-Einstellungen experimentieren, beschleunigt sofortiges Feedback kreative Entscheidungen. Ihre Workstation-GPU verarbeitet diese Iterationen sofort, ohne Netzwerklatenz oder Wartezeiten in der Warteschlange.

Der Kompromiss ist die Renderzeit. Ein einzelnes 768x768-Bild in 25 Schritten dauert auf einer RTX 3080 etwa 12 bis 20 Sekunden, was für iteratives Arbeiten akzeptabel ist. Wenn Sie 50 Varianten zur Überprüfung durch den Kunden generieren, wird Ihre GPU für 10 bis 15 Minuten gesperrt. Während dieser Zeit werden andere Arbeiten unterbrochen.

Die Cloud-Ausführung über GPU-Marktplätze bietet Zugriff auf höherstufige Hardware ohne Kapitalinvestitionen. Ein RTX 4090-Cloud-Node rendert dasselbe Bild in 6 bis 8 Sekunden, wodurch die Batchzeit um die Hälfte reduziert wird. Sie zahlen nur für die genutzte Zeit und nicht für ungenutzte Kapazität.

Überlegungen zum Datenschutz sind wichtig. Bei der lokalen Ausführung werden Referenzbilder und generierte Inhalte vollständig auf Ihrer Hardware gespeichert. Die Ausführung in der Cloud erfordert das Hochladen von Referenzen und das Herunterladen von Ergebnissen, wodurch eine kurze Netzwerkbelastung entsteht. Bei kommerziellen Arbeiten, die einer Geheimhaltung unterliegen, oder bei persönlichen Inhalten, die Diskretion erfordern, wird dieses Risiko durch die Ausführung vor Ort ausgeschlossen.

Kostenvergleich für einen Stapel mit 50 Bildern bei 768 x 768, 25 Schritte:

Ressource | Renderzeit | Datenschutz | Einrichtungsaufwand | Ungefähre Kosten

Lokaler RTX 3080 | 15 Minuten | Vollständig | Einmalig | Nur Strom

Lokaler RTX 4090 | 8 Minuten | Vollständig | Einmalig | Nur Strom

Cloud RTX 4090 | 8 Minuten | Hochladen/Herunterladen | Pro Stapel | Variabel je nach Anbieter

Abonnement-Service| 10 Minuten | Servicebedingungen | Kontoeinrichtung| Monatliche Gebühr

Entscheidungsrahmen:

Verwenden Sie die lokale Ausführung, wenn:

- Du testest Arbeitsabläufe und passt Parameter an

- Datenschutzbestimmungen verbieten Cloud-Upload

- Die Stapelgröße beträgt weniger als 20 Bilder

- Ihre lokale GPU ist nicht mit anderen Aufgaben beschäftigt

Verwenden Sie die Cloud-Ausführung, wenn:

- Die Stapelgröße überschreitet 30 Bilder

- Die Frist erfordert eine schnellere Bearbeitung, als es vor Ort möglich ist

- Ihrer lokalen GPU fehlt VRAM für höhere Auflösungen

- Sie müssen die Ergebnisse mehrerer GPU-Typen vergleichen.

%20(2).avif)

%20transparent.avif)