SDXL 1.0 Tutorial: Generieren Sie kostenlos tolle KI-Bilder

SDXL 1.0 eröffnet unglaubliche Möglichkeiten für die Generierung von KI-Bildern für verschiedene Stile, Motive und Hintergründe. 🎉 Egal, ob Sie realistische Porträts, Grafiken im Anime-Stil oder experimentelle Grafiken erstellen, dieses leistungsstarke Modell liefert beeindruckende Ergebnisse völlig kostenlos.

Im Folgenden finden Sie eine umfassende Anleitung, die drei verschiedene Methoden zur Nutzung der Funktionen von SDXL 1.0 zeigt, einschließlich der Arbeit mit Promptus Studio Comfy (PSC), einer führenden Plattform, die auf dem Open-Source-Framework ComfyUI basiert.

🎨 Erste Schritte mit SDXL 1.0

Bevor Sie in die Methoden eintauchen:

- Laden Sie das SDXL 1.0-Basismodell herunter aus dem Hugging Face-Repository von Stability AI.

- Wahlweise Laden Sie das Refiner-Modell herunter für verbesserte Details und Qualität.

- Diese Modelle funktionieren auf allen Plattformen, die wir untersuchen werden.

1 ️ Methode 1: Automatic1111 für die lokale Generierung verwenden

Automatic1111 ist das beliebteste Stable Diffusion-Interface und bietet unkomplizierte SDXL-Unterstützung.

- Herunterladen und einrichten

- Besuchen Sie das offizielle GitHub-Repository.

- Laden Sie unter „Windows 10/11 mit NVIDIA-GPUs“ den

v1.0.0vorgefertigte Datei. - Extrahieren

sd.webui.zipund kopieren Sie das SDXL-Basismodell inWebUI/Modelle/STABLE-DIFFUSION. - Lauf

update.batum die neueste SDXL-kompatible Version zu erhalten, doppelklicken Sie dannrun.bat. Dadurch werden Abhängigkeiten (einschließlich PyTorch) heruntergeladen und der Server gestartetlokaler Host: 7860. 🚀

- Optimale Einstellungen

- Auflösung: Auf 1024×1024 gesetzt (SDXL wurde hauptsächlich darauf trainiert). Sie können mit Querformaten wie 1366×768 für verschiedene Seitenverhältnisse experimentieren.

- Detail und Qualität: Beachten Sie im Vergleich zu früheren Versionen verbesserte Details, insbesondere bei Gesichtszügen und komplexen Texturen.

- Tipps

- Probieren Sie verschiedene Sampler (z. B. EuleRA) aus, um unterschiedliche Ergebnisse zu erzielen.

- Verwenden Sie detaillierte positive und negative Eingabeaufforderungen, um unerwünschte Elemente zu vermeiden.

- Wenn Sie das Refiner-Modell lokal haben, integrieren Sie es in Ihren Arbeitsablauf, um Ergebnisse von noch höherer Qualität zu erzielen. 🔍

2 ️ Methode 2: ComfyUI und Promptus Studio Comfy für erweiterte Workflows

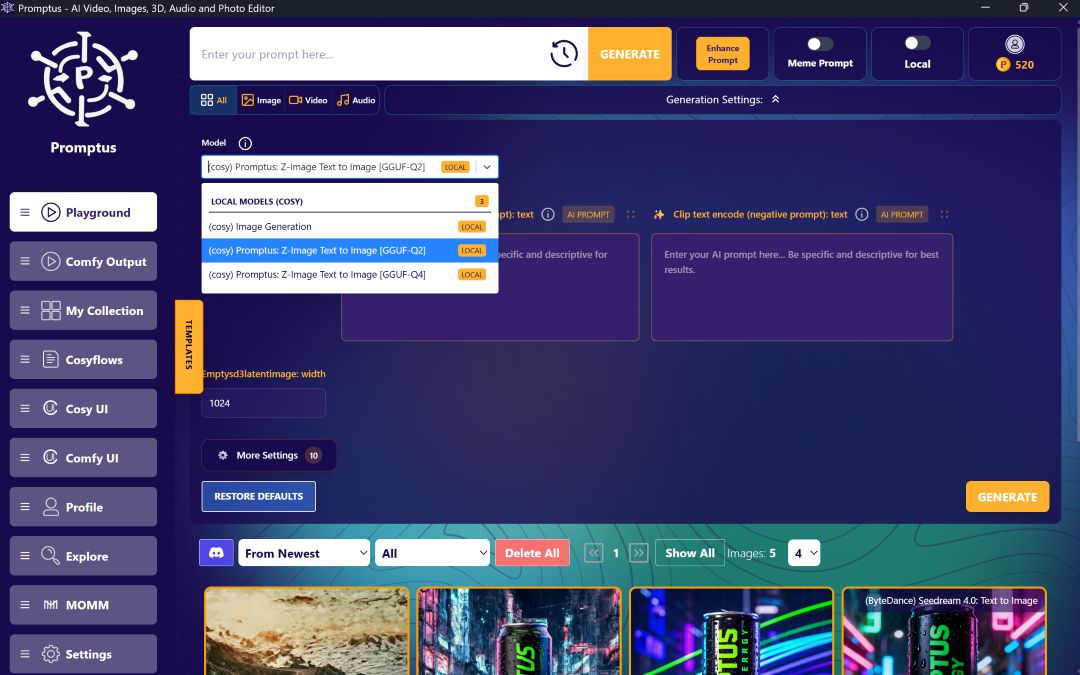

ComfyUI bietet modulare, knotenbasierte Workflows; Promptus Studio Comfy (PSC) bietet eine zugängliche, Cloud-basierte Oberfläche, die auf ComfyUI basiert.

🔧 Traditionelles ComfyUI-Setup

- Herunterladen aus dem offiziellen GitHub-Repository und Extraktdateien.

- Platzieren Sie SDXL-Modelle

comfyui/Modelle/Checkpoints. - Führen Sie den entsprechenden Batch/das entsprechende Skript für Ihre Hardware aus. ComfyUI startet am

lokaler Gastgeber: 8188mit automatischer Modellerkennung. - Arbeitsablauf der Raffinerie: Den Refiner-Workflow laden: ComfyUI generiert zuerst ein Basisbild und verarbeitet es dann im Refiner für verbesserte Details, Texturen und Beleuchtung. Dieser zweistufige Prozess führt zu deutlich hochwertigeren Ergebnissen.

⚡ Vorteile von Promptus Studio Comfy (PSC)

Promptus Studio Comfy kombiniert die Flexibilität von ComfyUI mit:

- Browserbasierte, Cloud-gestützte Oberfläche über Promptus Web oder Promptus App.

- Arbeitsabläufe ohne Code (CosyFlows) mit Leichtigkeit per Drag-and-Drop.

- Verteilte GPU-Berechnung für schnelleres Rendern und hochauflösende Ausgaben.

- Zusammenarbeit in Echtzeit, Workflow-Publishing und Integrationen (z. B. Discord).

- Zugang zu fortgeschrittenen Modellen (Stabile Diffusion SDXL, GPT-4o, Gemini Flash, HiDream, Hunyuan3D).

- Multimodale Generierung in Text, Bild und Video.

Ganz gleich, ob Sie Markenbilder, animierte Geschichten oder Konzeptkunst-Pipelines erstellen, PSC macht ComfyUI für Studios, Agenturen und Einzelschaffende zugänglich, die Flexibilität, Geschwindigkeit und Qualität in großem Maßstab benötigen.

Um mit PSC zu beginnen:

- Melde dich an unter https://www.promptus.ai ✨

- Wählen Sie Promptus Web (Browser) oder Promptus App (Desktop).

- Wählen Sie aus den SDXL-Modellen oder laden Sie Ihre eigenen Modelle hoch.

- Erkunden Sie vorgefertigte Workflows oder erstellen Sie Ihre eigenen über Drag-and-Drop-Knoten.

3 ️ Methode 3: Online-Generierung mit ClipDrop

Wenn eine lokale Installation aufgrund von Hardwarebeschränkungen nicht möglich ist:

- ClipDrop.co (von Stability AI) bietet browserbasierten SDXL-Zugriff. 💻

- Kostenloses Kontingent: 400 kostenlose Generationen, um die Funktionen von SDXL ohne Einrichtung zu erkunden.

- Einfacher Start: Melden Sie sich einfach an, wählen Sie die SDXL-Generation und beginnen Sie mit der Erstellung von Eingabeaufforderungen — keine lokale GPU erforderlich.

🔍 Optimieren Sie Ihre SDXL-Ergebnisse

Unabhängig von der von Ihnen gewählten Methode verbessern verschiedene Techniken die Ausgabequalität:

- Auflösung und Seitenverhältnis: Verwenden Sie 1024×1024 oder SDXL-native Seitenverhältnisse. Experimentieren Sie mit breiteren oder hochformatigen Formaten, sofern diese unterstützt werden.

- Probenehmer: Probiere verschiedene Sampler wie Eulera aus, um Textur und Kohärenz zu variieren.

- Aufforderungen: Erstelle detaillierte positive Aufforderungen; verwende negative Aufforderungen, um unerwünschte Elemente herauszufiltern (z. B. „schlechte Qualität“, „verschwommen“, „Artefakt“).

- Refiner-Modell: Integrieren Sie den Refiner in eine zweistufige Pipeline, um Ergebnisse in professioneller Qualität zu erzielen, bei denen feine Details erforderlich sind.

- Iterationen und CFG-Skala: Passen Sie die „CFG-Skala“ an (Eingabeaufforderung) und führen Sie mehrere Durchgänge durch, um das Bild zu verfeinern.

- Gesichtsrestauration//Nachbearbeitung: Aktiviere in lokalen Setups wie Automatic1111 Module zur Gesichtswiederherstellung oder die Nachbearbeitung in Tools wie Photoshop für kleinere Anpassungen.

- Generierung und Auswahl von Chargen: Generieren Sie mehrere Proben in einer Charge und wählen Sie dann die beste aus. Auf diese Weise können Sie unerwartete, inspirierende Ergebnisse entdecken.

Der Qualitätssprung im Vergleich zu früheren Versionen von Stable Diffusion ist erheblich — insbesondere bei der Gesichtsgenerierung, den Landschaftsdetails und der allgemeinen Kohärenz zwischen den künstlerischen Stilen.

✨ Fazit

SDXL 1.0 stellt einen großen Sprung in der Qualität und Vielseitigkeit der KI-Bildgenerierung dar. Sie haben jetzt mehrere Pfade:

- Automatisch 1111 für Einfachheit und lokale Steuerung.

- ComfyUI + PSC für fortschrittliche, modulare Workflows mit Cloud-Beschleunigung und Zusammenarbeit.

- ClipDrop für schnellen browserbasierten Zugriff ohne lokale Hardwareanforderungen.

Jede Methode kann atemberaubende visuelle Inhalte erzeugen — wählen Sie diejenige aus, die am besten zu Ihrer Hardware, Ihren Workflow-Einstellungen und Ihren Anforderungen an die Zusammenarbeit passt.

🚀 Nächste Schritte und zukünftige Wikis

Bleib dran für weitere Wiki-Inhalte:

- LoRa-Schulung: Passen Sie Modelle mit leichten Adaptern an bestimmte Stile oder Themen an.

- DreamBooth-Integration: Optimieren Sie SDXL anhand personalisierter Daten für maßgeschneiderte Ergebnisse.

- ControlNet-Nutzung: Generierung von Anleitungen mit Skizzen, Posen oder Segmentierungskarten.

- Optimierung für Low-VRAM-Geräte: Techniken wie Offloading, Pruning oder die Verwendung leichterer Varianten, wenn der GPU-Speicher begrenzt ist.

Diese tiefen Tauchgänge werden Ihnen helfen, die Grenzen von SDXL zu erweitern und noch mehr kreatives Potenzial auszuschöpfen. 🎉

Viel Spaß beim Generieren von KI-Bildern! Lassen Sie Ihrer Fantasie mit SDXL 1.0 freien Lauf. ✨🖼️

%20(2).avif)

%20transparent.avif)