Konfigurieren Sie die GPU-Einstellungen in Promptus mit ComfyUI für schnelleres KI-Rendern. Optimieren Sie die NVIDIA-Leistung, das VRAM-Management und die PyTorch-Workflows mit praktischen Schritten.

Letzte Aktualisierung: März 2026 — Mit FLUX-spezifischen VRAM-Anforderungen und Marketplace-Hybrid-Workflow-Mustern aktualisiert.

Wenn Sie die maximale Geschwindigkeit Ihrer GPU nutzen, verändert sich, wie schnell Sie mit KI-generierten Inhalten iterieren. Ganz gleich, ob Sie komplexe Bild-Workflows ausführen oder Videostapel verarbeiten, die richtige GPU-Konfiguration wirkt sich direkt auf Ihre kreative Leistung aus.

Dieses Handbuch konzentriert sich auf praktische NVIDIA-Optimierung, VRAM-Management und PyTorch-Einstellungen, die die Wartezeit verkürzen und den Durchsatz erhöhen. Das erste Mal, dass ich es erwähne: Promptus mit ComfyUI macht fortgeschrittene knotenbasierte Workflows für Studios und Solo-Entwickler über eine einheitliche Oberfläche zugänglich.

Was du lernen wirst

- So stellen Sie VRAM-Modi auf der Grundlage Ihrer GPU-Speicherkapazität ein

- Welche Startflags verbessern die Rendergeschwindigkeit, ohne Abstürze zu verursachen

- So optimieren Sie Chargengröße und Auflösung für Ihre Hardware

- Wann sollte eine lokale GPU im Vergleich zum Cloud-Marketplace-Rendering verwendet werden?

- So beheben Sie häufig auftretende Leistungsengpässe mit spezifischen Fixes

- So überprüfen Sie, ob PyTorch und XFormers korrekt konfiguriert sind

Voraussetzungen

Bevor Sie beginnen, vergewissern Sie sich, dass Sie:

- NVIDIA-GPU mit mindestens 8 GB VRAM für Standard-Workflows, 12 GB oder mehr für Video

- Aktuelle NVIDIA-Treiber installiert, Game Ready oder Studio, je nach Kartentyp

- Promptus installiert, entweder Webinterface oder Desktop-App

- ComfyUI Manager ist über Promptus für die Paketverwaltung verfügbar

- Grundlegende Vertrautheit mit Auflösungs- und Chargengrößenkonzepten

- Ein geladenes Testmodell wie Stable Diffusion 1.5 oder Flux

Verstanden: Wenn Sie Windows kürzlich aktualisiert haben, überprüfen Sie, ob das Betriebssystem nicht automatisch generische Bildschirmtreiber über Ihre NVIDIA-Treiber installiert hat. Dies passiert häufig nach größeren Updates und führt zu unbemerkten Leistungseinbrüchen.

Schrittweise Anleitung zur GPU-Konfiguration

Schritt 1: GPU-Einstellungen in Promptus aufrufen

Öffnen Sie Promptus und navigieren Sie zum Einstellungsfeld. Klicken Sie in der Weboberfläche oben rechts auf das Zahnradsymbol. Gehen Sie in der Desktop-App zu Einstellungen und dann zu GPU-Konfiguration. Es werden Optionen für den VRAM-Modus, die Startflags und die Geräteauswahl angezeigt.

Schritt 2: Wählen Sie Ihren VRAM-Modus basierend auf der Hardware

Wenn Ihre GPU über 12 GB oder mehr VRAM verfügt, wählen Sie den Highvram-Modus. Dadurch werden größere Teile der Modelldaten vorab in den Videospeicher geladen, wodurch Swap-Operationen während der Generierung reduziert werden. Sie werden eine schnellere Iteration feststellen, insbesondere bei Flux und mehrstufigen Video-Workflows.

Wenn Ihre GPU 8 GB oder weniger hat, behalten Sie den Standard-VRAM-Modus bei. Wenn Highvram auf begrenztem Speicher erzwungen wird, verwendet das System gemeinsam genutzten RAM, der deutlich langsamer ist als der GPU-Speicher. Ich habe das auf einer RTX 3060 Ti mit 8 GB auf die harte Tour gelernt, als ein Kundenprojekt zum Erliegen kam, weil ich davon ausging, dass aggressivere Einstellungen eine bessere Leistung bedeuten.

Testen Sie bei 10-GB-Karten wie der RTX 3080 beide Modi. Führen Sie Batches der identischen Generation mit Standard- und Highvram aus und führen Sie jeweils ein Timing durch. Einige Modelle passen problemlos in Highvram auf 10 GB, andere überlaufen den Speicher um ein paar hundert Megabyte und schneiden schlechter ab.

Schritt 3: Aktivieren Sie den Nur-GPU-Modus für dedizierte Systeme

Wenn ComfyUI die primäre Anwendung auf Ihrem System ist, aktivieren Sie das Start-Flag nur für Grafikprozessoren. Dadurch werden der GPU maximale Ressourcen zugewiesen und der CPU-Overhead während der Generierung minimiert. Markieren Sie dieses Kästchen im Abschnitt Startflags.

Überspringen Sie diese Einstellung, wenn Sie andere intensive Anwendungen gleichzeitig ausführen, z. B. Videobearbeitungssoftware oder Game-Engines. Die Markierung „Nur für Grafikprozessoren“ kann anderen Anwendungen Ressourcen entziehen und zu Systeminstabilität führen.

Schritt 4: Überprüfen Sie die CUDA- und PyTorch-Installation

Promptus bündelt eine getestete PyTorch-Version, überprüfen Sie jedoch, ob sie aktiv ist. Führen Sie eine schnelle Testgenerierung durch und überprüfen Sie die Konsolenausgabe. Sie sollten Verweise auf CUDA-Initialisierung und Geräteerkennung sehen. Wenn Sie nur CPU-Warnungen sehen, verwendet PyTorch Ihre GPU nicht.

Um den Nur-CPU-Modus zu korrigieren, navigieren Sie in Promptus zum ComfyUI Manager und installieren Sie das PyTorch-Paket neu, das Ihrer CUDA-Version entspricht. Bei den neuesten NVIDIA-Treibern funktionieren die CUDA 11.8- oder 12.1-Pakete zuverlässig.

Schritt 5: Installieren und verifizieren Sie XFormers

XFormers optimiert die Speichernutzung bei Aufmerksamkeitsmechanismen und reduziert so direkt die Generierungszeit für Modelle wie Stable Diffusion XL und Flux. Öffnen Sie in Promptus den ComfyUI Manager und suchen Sie nach XFormers. Installieren Sie den Build, der Ihrer CUDA-Version entspricht.

Führen Sie eine weitere Testgeneration aus und überprüfen Sie die Konsolenausgabe auf speichereffiziente Warnmeldungen. Wenn XFormers aktiv ist, wird Ihnen diese Bestätigung angezeigt. Wenn nicht, ist die Installation fehlgeschlagen oder die Version steht in Konflikt mit Ihrem PyTorch-Build.

Ich habe einmal vier Stunden damit verbracht, langsame Flux-Generationen zu debuggen, bevor festgestellt wurde, dass XFormers nicht aktiv war, weil ich die falsche CUDA-Version installiert hatte. Überprüfen Sie immer die Konsolenausgabe, anstatt davon auszugehen, dass die Installation erfolgreich war.

Schritt 6: Basisauflösung und Chargengröße festlegen

Beginnen Sie mit einer Auflösung von 1024x1024 und einer Stapelgröße von 4 Bildern. Diese Kombination nutzt moderne GPUs voll aus, ohne den VRAM auf 12-GB-Karten zu überschreiten. Suchen Sie in Ihrem Workflow den leeren Knoten für latente Bilder und legen Sie diese Werte fest.

Schritt 7: Konfigurieren Sie die Sampler-Einstellungen für die Geschwindigkeit

Verwenden Sie 20 Probenahmeschritte als Ausgangswert. Die meisten Modelle liefern bei dieser Anzahl qualitativ hochwertige Ergebnisse. Stellen Sie die CFG-Skala zwischen 7 und 9 ein, um eine ausgewogene Prompt-Adhärenz zu gewährleisten. Diese Einstellungen werden im KSampler-Knoten in den ComfyUI-Workflows angezeigt.

Schritt 8: Testbatch ausführen und Auslastung überwachen

Generieren Sie Ihren Testbatch und öffnen Sie den Task-Manager unter Windows oder führen Sie nvidia-smi in einem Terminal unter Linux aus. Beobachten Sie die GPU-Auslastung während der Generierung. Sie sollten eine Auslastung von über 90 Prozent sehen. Wenn die Auslastung unter 70 Prozent bleibt, erhöhen Sie die Batchgröße um 1 und testen Sie erneut.

Wenn Fehler aufgrund unzureichenden Speichers auftreten, reduzieren Sie die Batchgröße um die Hälfte oder verringern Sie die Auflösung auf 896 x 896. VRAM-Grenzwerte sind strenge Einschränkungen, keine Vorschläge.

Warum diese Konfiguration funktioniert

Dieses Setup gleicht die VRAM-Kapazität gegen die Rechengeschwindigkeit aus. Indem Sie Modelldaten im Highvram-Modus vorab laden, vermeiden Sie die Leistungseinbußen, die durch den Austausch von Daten zwischen System-RAM und GPU-Speicher entstehen. Das GPU-Only-Flag reduziert den CPU-Planungsaufwand, sodass die GPU Aufmerksamkeitsoperationen verarbeiten kann, ohne auf die CPU-Koordination warten zu müssen.

XFormers beschleunigt spezifisch den Aufmerksamkeitsmechanismus, der in Diffusionsmodellen am meisten Speicher und Zeit verbraucht. Die standardmäßige PyTorch-Aufmerksamkeit skaliert schlecht mit der Sequenzlänge. XFormers verwendet gekachelte Berechnungen, bei denen die Aufmerksamkeit in kleineren Blöcken verarbeitet wird, wodurch die maximale Speicherauslastung reduziert wird, während die mathematische Äquivalenz beibehalten wird.

Die Batchgröße steuert direkt die GPU-Auslastung. Bei einer Batchgröße von 1 sind die meisten GPU-Kerne inaktiv, da einzelne Images nicht genügend parallele Arbeit bieten. Bei einer Erhöhung der Batchgröße auf 4 oder 8 wird die Berechnung auf alle verfügbaren CUDA-Kerne verteilt, sodass die Auslastung auf 100 Prozent steigt. Der Nachteil ist eine längere Gesamtgenerierungszeit, aber die Zeit pro Bild sinkt erheblich.

Häufige Fehler und Korrekturen

Symptom: Die GPU-Auslastung bleibt während der Generierung bei 40 Prozent

Wahrscheinlicher Grund: Die Batchgröße ist zu klein, um die GPU-Kerne zu sättigen

Fix: Erhöhen Sie die Batchgröße von 1 auf 4 und dann auf 8, wenn VRAM dies zulässt. Testen und überwachen Sie die Auslastung nach jeder Änderung erneut.

Symptom: Fehler aufgrund unzureichenden Speichers vor Generierungsstart

Mögliche Ursache: Die Modellgröße überschreitet den verfügbaren VRAM im Highvram-Modus

Fix: Wechseln Sie in den Standard-VRAM-Modus. Wenn der Fehler weiterhin besteht, verwenden Sie eine quantisierte GGUF-Version des Modells, wodurch der Speicherbedarf bei minimalem Qualitätsverlust reduziert wird.

Symptom: Das System stürzt in der mittleren Generation ab

Mögliche Ursache: Ungenügende Stromversorgungskapazität oder thermische Drosselung

Fix: Überprüfen Sie den GPU-Stromverbrauch mit nvidia-smi. Wenn sich die Stromspitzen dem Netzteillimit nähern, rüsten Sie das Netzteil auf oder reduzieren Sie die Übertaktung. Überwachen Sie die Temperatur. Wenn die Temperatur über 85 Grad Celsius liegt, verbessern Sie die Luftzirkulation im Gehäuse.

Symptom: Schwarze oder beschädigte Bilder in der Ausgabe

Wahrscheinliche Ursache: Instabile GPU-Übertaktung oder fehlerhafter XFormers-Build

Fix: Setzen Sie die GPU-Takte in MSI Afterburner oder gleichwertig auf die Standardeinstellungen zurück. Generieren Sie den Teststapel erneut. Wenn die Beschädigung weiterhin besteht, deinstallieren Sie XFormers über ComfyUI Manager und installieren Sie es erneut.

Symptom: Die Generierungsgeschwindigkeit nimmt mit der Zeit ab

Mögliche Ursache: Verschlechterung der Wärmeleitpaste oder Treiberkonflikt

Fix: Überprüfen Sie die GPU-Temperaturtrends über mehrere Läufe hinweg. Wenn die Temperatur über 80 Grad steigt und dort bleibt, tauschen Sie die Wärmeleitpaste aus. Aktualisieren Sie die NVIDIA-Treiber oder setzen Sie sie auf die neueste stabile Version zurück.

Symptom: Auf der Konsole werden nur CPU-Warnungen angezeigt, obwohl die NVIDIA-GPU installiert ist

Wahrscheinlicher Grund: PyTorch verwendet CPU-Backend anstelle von CUDA

Fix: Öffnen Sie ComfyUI Manager und installieren Sie PyTorch mit CUDA-Unterstützung neu. Stellen Sie sicher, dass Ihre CUDA-Version mit dem PyTorch-Build übereinstimmt. Starten Sie Promptus nach der Neuinstallation neu.

Symptom: Inkonsistente Generierungszeiten, bei denen einige Batches schnell und andere langsam sind

Mögliche Ursache: Hintergrundprozesse, die um GPU-Ressourcen konkurrieren, oder thermische Drosselung

Fix: Schließen Sie nicht benötigte Anwendungen, die GPU verwenden, z. B. Browser mit aktivierter Hardwarebeschleunigung. Überwachen Sie die Temperatur bei längeren Läufen. Fügen Sie Gehäuselüfter hinzu, falls Temperaturspitzen zu einer Drosselung führen.

Fortgeschrittene Variationen und Techniken

Variante 1: Aggressive Chargengrößenskalierung für den Produktionsdurchsatz

Erhöhen Sie für High-End-GPUs wie RTX 4090 mit 24 GB VRAM die Batchgröße auf 16 oder sogar 32 für Standardgenerationen mit 1024 x 1024. Dies verbessert den Durchsatz bei großen Projekten erheblich. Die gesamte Generierungszeit erhöht sich, aber die Zeit pro Bild sinkt um 60 Prozent oder mehr im Vergleich zur Stapelgröße von 4 Bildern.

Verwenden Sie diesen Ansatz, wenn Sie Ihre Eingabeaufforderung und Einstellungen abgeschlossen haben und Hunderte von Varianten generieren müssen. Nicht geeignet für iteratives kreatives Arbeiten, bei dem Sie häufig verschiedene Eingabeaufforderungen testen.

Variante 2: Unterspannung für anhaltende Leistung

Verwenden Sie MSI Afterburner oder ähnliche Tools, um Ihre GPU-Spannungskurve um 50 bis 100 Millivolt zu senken. Testen Sie die Stabilität nach jeder Anpassung mit einem Generierungsstapel. Eine Unterspannung reduziert den Stromverbrauch und die Wärmeentwicklung und ermöglicht eine gleichbleibend höhere Taktrate ohne thermische Drosselung.

Ich lasse meinen RTX 4080 mit 900 mV statt mit 1000 mV laufen. Die Leistungsaufnahme sank von 320 W auf 280 W, die Temperatur blieb 8 Grad kühler und die Taktraten blieben bei stundenlangen Batch-Läufen konstant, anstatt zwischen Boost- und Basistakt hin- und herzuschalten.

Variante 3: Hybride lokale und Cloud-Workflow-Optimierung

Prototypisieren Sie Workflows lokal auf Ihrer GPU, indem Sie kleine Batchgrößen und geringere Schrittzahlen verwenden. Sobald Sie die Einstellungen abgeschlossen haben, verpacken Sie den Workflow und senden Sie ihn an eine Marketplace-GPU mit höherem VRAM für die endgültigen Produktionschargen mit maximalen Qualitätseinstellungen.

Dieser Ansatz maximiert die Iterationsgeschwindigkeit lokal und hält gleichzeitig die Cloud-Rechenkosten niedrig. Sie zahlen nur für die endgültige Renderzeit, nicht für Dutzende von Testgenerationen während der kreativen Erkundung.

Entscheidungsleitfaden für lokale und cloudbasierte Ausführung

Datenschutz: Local speichert alle Daten auf Ihrer Hardware. Die Cloud erfordert das Hochladen von Eingabeaufforderungen und Bildern auf Remote-Server.

Kosten: Bei Local fallen nach der Investition in die Hardware keine Grenzkosten an. Cloud-Gebühren pro Rechenstunde.

Geschwindigkeit: Local reagiert sofort. Die Cloud erfordert Uploadzeiten und Wartezeiten in der Warteschlange während der Spitzenzeiten.

Zuverlässigkeit: Lokal hängt von Ihrer Hardware und Stromversorgung ab. Die Cloud hängt von der Netzwerkstabilität und der Verfügbarkeit des Anbieters ab.

Einrichtungsaufwand: Local erfordert Treiberinstallation und -konfiguration. Für die Cloud sind Kontoeinrichtung und Workflow-Paketierung erforderlich.

Verwenden Sie die lokale GPU, wenn Sie während der kreativen Iteration sofortiges Feedback benötigen und wenn Sie Hardware mit ausreichend VRAM für Ihre Zielmodelle besitzen. Verwenden Sie den Cloud-Marktplatz, wenn Sie VRAM benötigen, das Ihre lokale Kapazität übersteigt, wenn Sie große Batches über Nacht verarbeiten oder wenn Ihre lokale GPU mit anderen Aufgaben beschäftigt ist.

Schneller Vergleich:

8 GB lokale GPU: Geeignet für SD 1.5 und SDXL bei Standardauflösungen, Batchgröße 2 bis 4

12 GB lokale GPU: verarbeitet Flux- und Video-Workflows, Batchgröße 4 bis 8

Lokale 24-GB-GPU: Produktionsgerecht für alle Workflows, Batchgröße 16 oder mehr

Cloud-GPU mit 24 GB: Kostengünstig für gelegentliche hohe Workloads, keine Hardwareinvestitionen

Cloud-GPU mit 48 GB: Erforderlich für große Videoprojekte und experimentelle Modelle mit extremen VRAM-Anforderungen

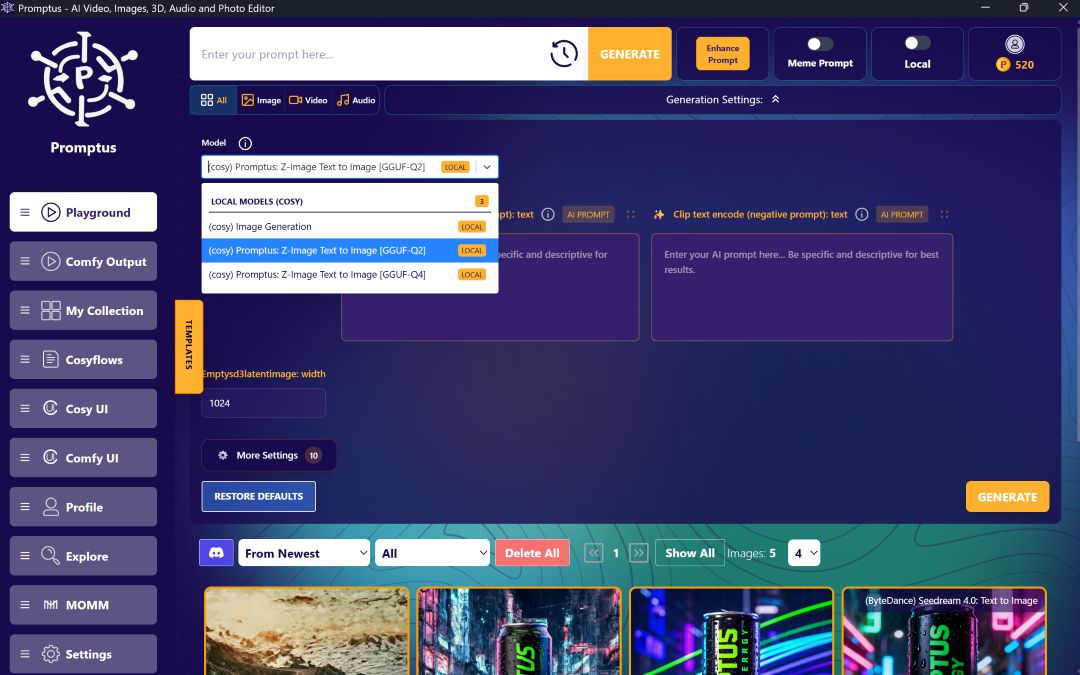

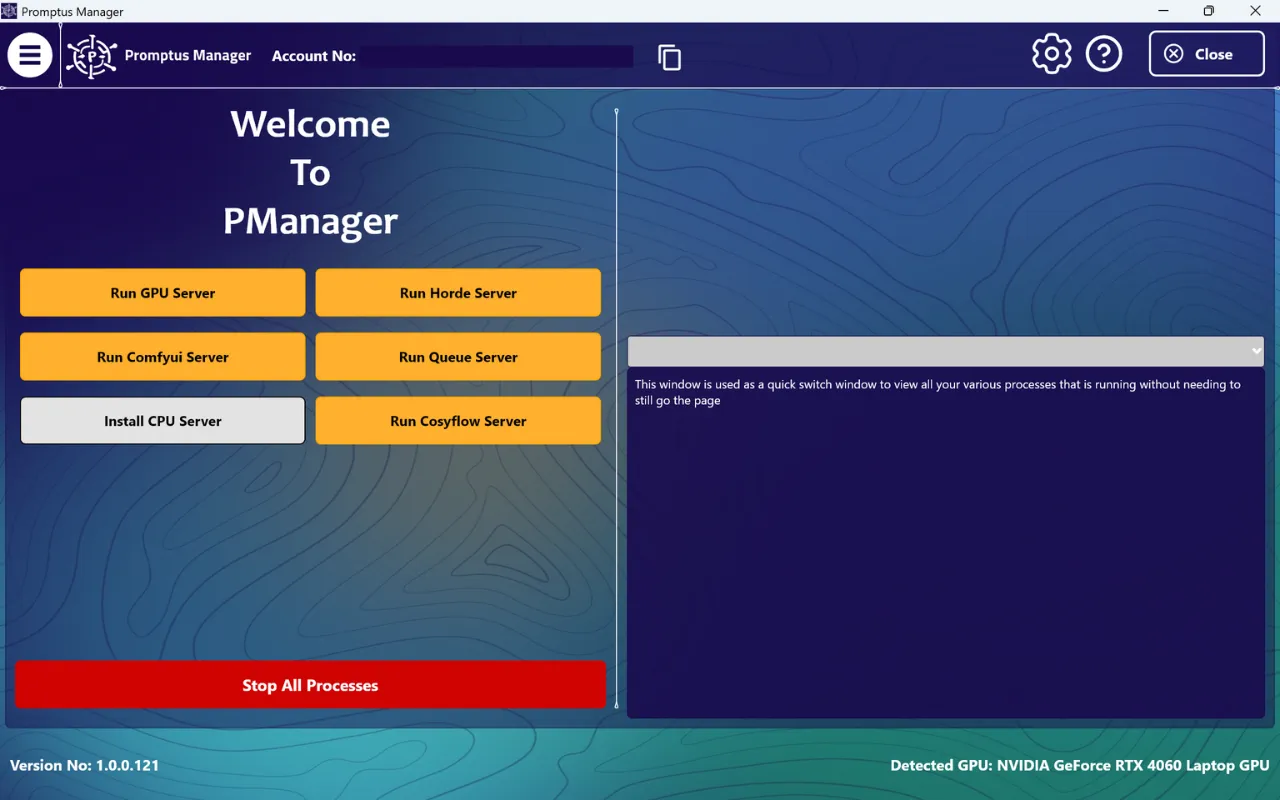

So konfigurieren Sie die GPU-Einstellungen speziell in Promptus

Wenn Sie Promptus verwenden, vereinfacht die Plattform die GPU-Konfiguration durch eine einheitliche Einstellungsschnittstelle. Greifen Sie über das Bedienfeld „Einstellungen“ in der Desktop-App oder über das Menü „Einstellungen“ in der Webversion auf die GPU-Einstellungen zu. Die Benutzeroberfläche zeigt den VRAM-Modus, die Startkennzeichen und die Geräteauswahl auf einem Bildschirm an, sodass keine Befehlszeilenkonfiguration erforderlich ist.

Wählen Sie Ihren VRAM-Modus aus dem Drop-down-Menü aus. Aktivieren Sie den Nur-GPU-Modus mit einem Kontrollkästchen, falls zutreffend. Klicken Sie auf Einstellungen anwenden und Promptus startet ComfyUI automatisch mit der neuen Konfiguration neu. Sie müssen die Startskripts oder Konfigurationsdateien nicht manuell bearbeiten.

Für Marketplace-Rendering konfigurieren Sie zuerst Ihren Workflow lokal und klicken Sie dann im Workflow-Bereich auf die Schaltfläche Auf Marketplace bereitstellen. Wählen Sie Ihre Ziel-GPU-Stufe auf der Grundlage der VRAM-Anforderungen aus, legen Sie die Batchgröße fest und senden Sie sie ab. Promptus kümmert sich um das Hochladen und die Ausführung von Dateien per Fernzugriff und gibt fertige Bilder oder Videos an Ihre lokale Bibliothek zurück.

Diese Integration reduziert die Komplexität der Konfiguration im Vergleich zur Verwaltung separater lokaler und cloudbasierter Setups. Sie verwenden identische Workflows für die lokale und die Cloud-Ausführung, sodass keine parallelen Konfigurationen erforderlich sind.

Fazit

Die Maximierung der GPU-Leistung erfordert Aufmerksamkeit bei der Auswahl des VRAM-Modus, der Installation von XFormers und der Optimierung der Batchgröße, aber das Ergebnis ist eine wesentlich schnellere Iteration und ein höherer Durchsatz. Konfigurieren Sie Ihre lokale GPU für die tägliche kreative Arbeit mit dem Highvram-Modus auf Karten mit 12 GB oder mehr und der Option „Nur GPU“ auf dedizierten Systemen. Verwenden Sie Cloud Marketplace Rendering für Workloads, die Ihre lokale VRAM-Kapazität überschreiten, oder wenn Sie große Batches verarbeiten müssen, ohne Ihre lokale Hardware zu belasten.

Implementieren Sie zunächst die schrittweise Anleitung mit Ihrer aktuellen Hardware, überwachen Sie die Auslastung und passen Sie die Batchgröße an, bis Sie während der Generierung eine GPU-Auslastung von 90 Prozent oder mehr erreichen.

%20(2).avif)

%20transparent.avif)