Hunyuan Video 1.5 ist eines der besten Open-Source-Modelle zur Videogenerierung

Hunyuan Video 1.5 ist Tencents bahnbrechendes Videogenerierungsmodell mit 8,3 B-Parametern, das entwickelt wurde, um qualitativ hochwertige Text-to-Video- und Bild-to-Video-Ergebnisse zu liefern — und das auf GPUs für Endverbraucher.

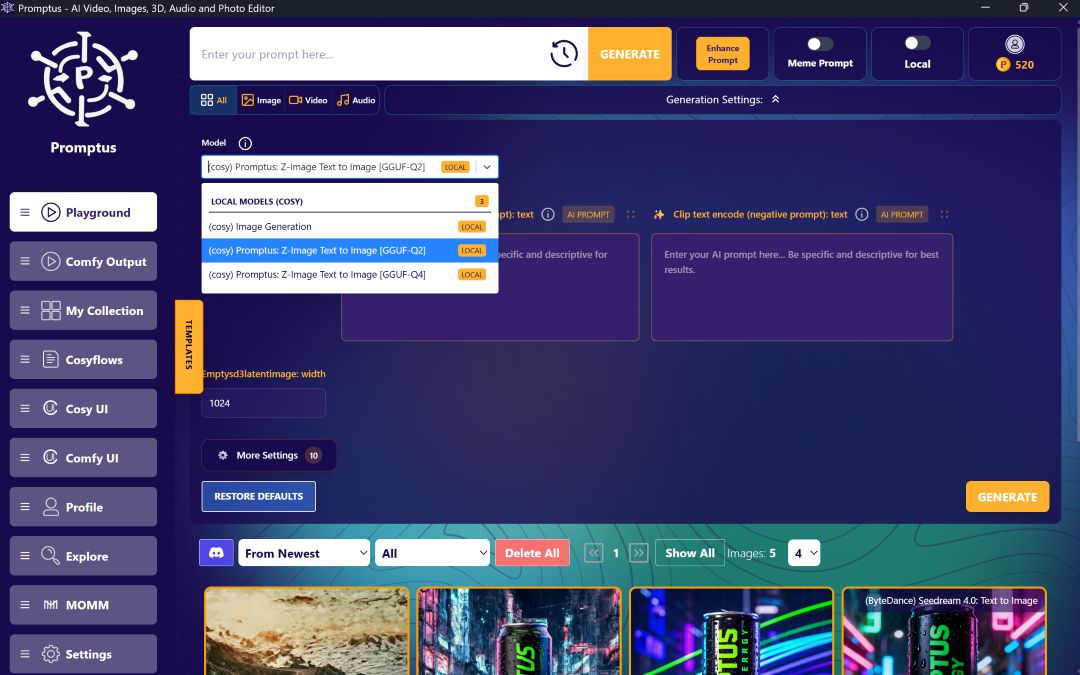

Seine Open-Source-Verfügbarkeit hat auch eine Reihe von Community-Varianten ermöglicht, wie die (gemütlich) Hunyuan 1.5 Familie, einschließlich GGUF-Builds, die so wenig laufen wie 8 GB VRAMund 5G-optimierte Konfigurationen für extrem schnelle Inferenz.

Hunyuan Video 1.5 Cosyflow-Varianten erklärt

Das von der Gemeinde geführte gemütlich veröffentlicht das Repackage Hunyuan Video 1.5 für eine Vielzahl von Hardware- und Anwendungsfällen. Bei diesen Versionen handelt es sich nicht um offizielle Tencent-Builds, sondern um Gemeinschaftsprodukte.

(gemütlich) Hunyuan 1.5 Text zum Video

- Standard-Community-Build.

- Beste Qualität, volle Präzision für das 8.3B-Modell.

- Empfohlen für 16—24 GB VRAM GPUs.

- Gleiches Verhalten und gleiche Ausgabequalität wie bei der vollständigen Referenzimplementierung.

(gemütlich) Hunyuan 1.5 Text zum Video (GGUF)

- GGUF-quantisierte Version (ähnlich den LLM-Quantisierungsformaten).

- Viel kleinerer RAM-/VRAM-Fußabdruck.

- Ideal für Benutzer mit 8—12 GB VRAM GPUs.

- Leichte Qualitätsminderung, aber deutlich schneller und leichter.

(gemütlich) Hunyuan 1.5 Text zu Video (8 GB VRAM GGUF-Version)

- Speziell optimiert für 8 GB NVIDIA-GPUs (z. B. RTX 3070, 4060).

- Verwendet aggressive Quantisierung.

- Kompromisse:

- Geringere Bewegungstreue

- Einige Artefakte bei der Bewegung der Hochgeschwindigkeitskamera

- Etwas weichere Optik

Immer noch bemerkenswert gut für seine Hardwareanforderungen.

(gemütlich) Hunyuan 1.5 Text zu Video (5G)

- „5G“ steht für 5-Gigabyte-VRAM-Ziel.

- Ultraleicht, aggressiv optimiert.

- Nützlich für:

- Notebook-GPUs

- Kostenlose Cloud-Instanzen

- Mini-PCs mit kleinem Formfaktor

- Der Qualitätsverlust ist spürbar, funktioniert aber immer noch für Konzeptvorschauen oder schnelle Iterationen.

Warum die Leute diese Hunyuan-Videos „unzensiert“ nennen

Die offizielle Veröffentlichung von Tencent unterliegt den üblichen Inhaltsbeschränkungen (ähnlich wie Stable Diffusion 1.5 und 3.0). Die Workflow-Builds entfernen restriktive Filter und ermöglichen so eine Nutzung ohne Inhaltsblockierung:

- Keine Kontrollpunkte für Sicherheitsklassifizierer

- Keine automatische NSFW-Maskierung

- Keine sofortige Desinfektion

⚠️ Die Gewichte des zugrunde liegenden Modells werden dadurch nicht geändert. Das Modell wurde nicht an expliziten Inhalten trainiert, akzeptiert aber jetzt irgendein fordert auf, ohne zu blockieren.

Hunyuan Video 1.5 verwendet eine optimierte mehrstufige Diffusionspipeline:

Links zum Modell

Text_Encoder

Diffusionsmodelle

- hunyuanvideo1.5_1080p_sr_distilled_fp16.sichere Sensoren

- hunyuanvideo1.5_720p_t2v_fp16.sichere Sensoren

Vae

:open_file_folder: ComfyUI/

├── :open_file_folder: models/

│ ├── :open_file_folder: text_encoders/

│ │ ├── qwen_2.5_vl_7b_fp8_scaled.safetensors

│ │ └── byt5_small_glyphxl_fp16.safetensors

│ ├── :open_file_folder: diffusion_models/

│ │ ├── hunyuanvideo1.5_1080p_sr_distilled_fp16.safetensors

│ │ └── hunyuanvideo1.5_720p_t2v_fp16.safetensors

│ └── :open_file_folder: vae/

│ └── hunyuanvideo15_vae_fp16.safetensorsWorkflow-Vorlagen

- Text zum Video:

video_hunyuan_video_1.5_720p_t2v.json - Bild zu Video:

video_hunyuan_video_1.5_720p_i2v.json

Wenn ComfyUI die Knoten nicht finden kann:

- Aktualisieren auf Nächtlich

- Stellen Sie sicher, dass beim Start kein Erweiterungsimport fehlgeschlagen ist

- Stellen Sie sicher, dass die Vorlage in Ihrer Version vorhanden ist

HunyuanVideo 1.5 ist derzeit einer der am zugänglichsten, hochwertig, und quelloffen Videomodelle sind verfügbar, während die „gemütlichen“ Community-Varianten eine unzensierte Nutzung und Bereitstellungen mit geringem VRAM ermöglichen.

Zu erwartende Einschränkungen

Obwohl HunyuanVideo 1.5 leistungsstark ist, hat es einige Einschränkungen:

- Videos, die länger als 10 Sekunden sind, verlieren an Qualität

- Zeitraffer kann zu temporalem Jitter führen

- Feine Details können bildübergreifend „verschmelzen“

- GGUF-Versionen reduzieren die Wiedergabetreue geringfügig

- Komplexe Objektinteraktionen sind nicht perfekt

%20(2).avif)

%20transparent.avif)