Ja — Promptus führt ComfyUI lokal, mit GPU-Server und Workflows in einer Installation aus. Wechseln Sie in den Offline-Modus und alles läuft auf Ihrem Computer — keine Cloud, keine Abonnements.

ComfyUI ist zu einer führenden Wahl für Entwickler geworden, die KI-Kunst, Video und 3D entwickeln. Eine häufig gestellte Frage lautet jedoch: Läuft es lokal? Ja — und es kann sehr gut laufen — vor allem, wenn es über Promptus mit ComfyUI.

In diesem Artikel behandeln wir genau, wie Sie ComfyUI lokal ausführen können und welche GPU-Hardware Sie für verschiedene beliebte Workflows wie SDXL, Flux, AnimateDiff/WAN2.x, Upscalers und Inpainting/Outpainting wirklich benötigen.

Was es bedeutet, „lokal“ zu laufen

Lokal ausgeführt bedeutet, dass die gesamte Verarbeitung — Generierung, Modellinferenz, Rendern — am dein eigener Computer, ohne sich auf Cloud-Server zu verlassen. Mit Promptus + ComfyUI:

- Sie laden alles herunter und installieren es (den GPU-Server, Modelle, Workflows).

- Sie schalten den „Offline-Modus“ ein, damit die Generierung keine Daten sendet oder externe Server verwendet.

- Sie kontrollieren, welche Modelle Sie verwenden (SDXL, Hunyuan, Flux usw.) und welche Workflows (Video, Bild, 3D).

Die besten ComfyUI Workflows 🔧

Hier sind einige der beliebtesten ComfyUI-Workflows, was sie tun und welche GPUs die Leute für sie verwenden (oder empfehlen).

👉 Wenn du tiefer tauchen möchtest, findest du hier eine Liste der beste ComfyUI Workflows du kannst es versuchen.

ComfyUI Lokales Setup 🖥️

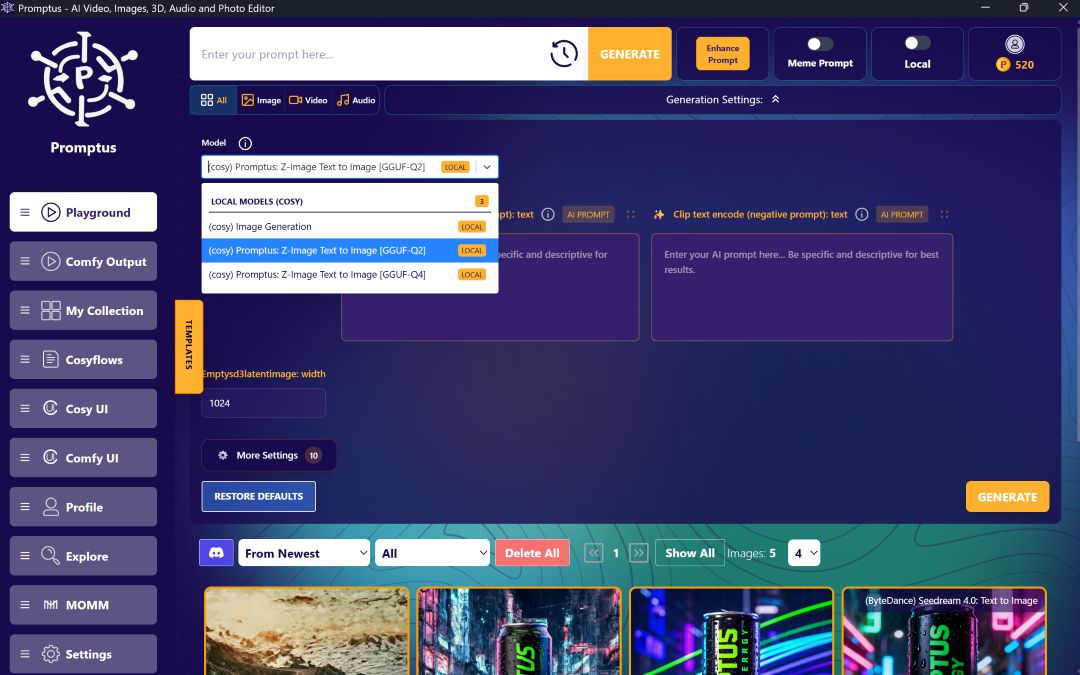

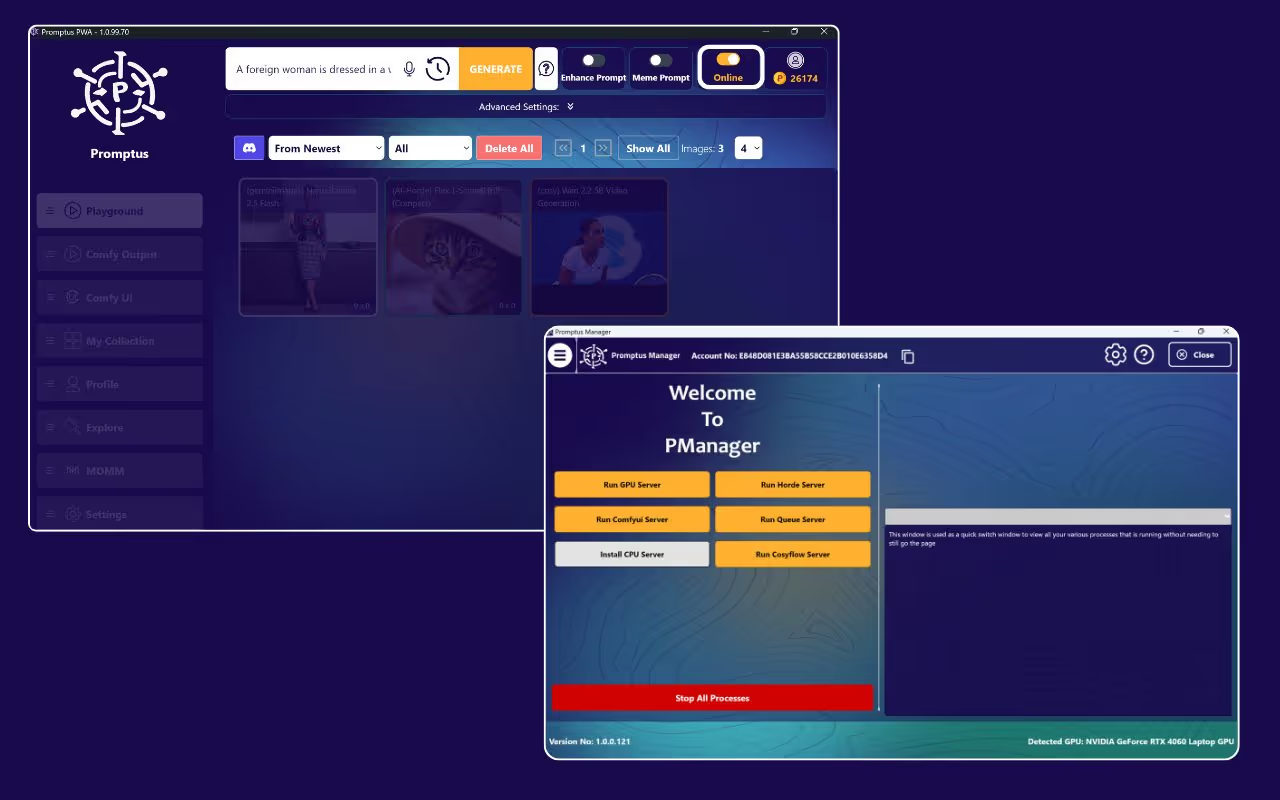

So führen Entwickler ComfyUI in der Regel lokal mit Promptus aus und verwenden dabei die oben genannten Top-Workflows:

- Promptus herunterladen und installiere die Desktop-App.

- Gehen Sie in der App zu Profil → ComfyUI Manager öffnen.

- Klicken Sie GPU-Server ausführen → Installieren. Promptus behandelt Abhängigkeiten, einschließlich der Einrichtung von Python, der GPU-Schnittstelle usw.

- Wenn das fertig ist, schalten Sie die App um Offline-Modus also läuft alles auf deiner Hardware (Bilder, Video, 3D).

- Laden Sie die erforderlichen Modelle (SDXL, Hunyuan, Flux usw.) herunter, damit sie lokal gespeichert werden.

- Wählen Sie einen Workflow aus (z. B. SDXL-Bildgenerierung oder WAN2.x-Video) und generieren Sie ihn. Mit Promptus können Sie Workflows auswählen, ohne Knoten manuell zu verkabeln.

GPU-Beispiele und Kompromisse aus der Praxis 🔍

- Ein Benutzer versucht WAN 2.2 FP8-Workflow für den ersten letzten Frame berichtete, dass für einen reibungslosen Ablauf, insbesondere für Videos, ein RTX 4090 mit 24 GB VRAM wird dringend empfohlen; GPUs der unteren Preisklasse sind mit quantisierten Modellen oder Modellen mit niedrigerer Genauigkeit möglich, aber Qualität oder Geschwindigkeit sinken.

- Für SDXL mit mäßiger Auflösung (1024×1024) funktionieren 12-16 GB VRAM recht komfortabel (zum Beispiel RTX 3060 oder 4070). Aber sobald du auf 2048×2048 gehst oder eine saubere Verfeinerung wünschst (vor allem Gesichter usw.), fängst du an, 20-24+ GB zu wollen.

- Niedrige VRAM-Optionen: Die GGUF-Variante der Wan2.2-Image-to-Video-Modelle kann auf Systemen mit ausgeführt werden weniger als 12 GB VRAM — Sie müssen jedoch Einschränkungen akzeptieren (niedrigere Auflösung, möglicherweise langsameres Rendern, geringere Stapelgrößen).

Also — läuft ComfyUI wirklich lokal? ✅

Ja, absolut. Und mit Tools wie Promptus verwenden es mehr Menschen als je zuvor lokal als primäre Einrichtung. Wenn Sie eine GPU mit 12-16 GB VRAM haben, großartig.

Wenn Sie weniger haben, können Sie immer noch viele Workflows ausführen (insbesondere Upscaling, Inpainting, einfachere Bildgenerierung), aber erwarten Sie langsamere Geschwindigkeiten oder Ausgaben mit niedrigerer Auflösung.

Für umfangreiche Video- und 3D-Inhalte werden mehr als 24 GB allmählich sehr nützlich oder sogar notwendig.

Tipps für die beste lokale Leistung

- Benutzen FP16//quantisierte Modelle wenn möglich (hilft, die VRAM-Nutzung zu reduzieren).

- Beginnen Sie mit moderaten Auflösungen (1024 × 1024), anstatt direkt auf 4K umzusteigen.

- Verfügen Sie über schnellen SSD-Speicher für Modelle. Langsames Laufwerk = lange Ladezeiten.

- System-RAM beibehalten — 16-32 GB sind hilfreich, um Daten zu speichern und große Modelle zu handhaben.

- Halten Sie Treiber & ComfyUI/Promptus auf dem neuesten Stand; manchmal kommen Optimierungen hinzu, die den VRAM-Bedarf reduzieren.

Zusammenfassung 🔎

- Bequeme Benutzeroberfläche tut lokal ausführen, insbesondere wenn es über Promptus verwendet wird.

- Sie können SDXL-, Hunyuan-, Flux-, AnimateDiff/WAN2.x-, Upscaling- und Inpainting-Workflows lokal ausführen. Der Schlüssel liegt darin, über ausreichend GPU-Speicher zu verfügen und bei Bedarf optimierte Workflows zu verwenden.

- Promptus vereinfacht die Einrichtung: Herunterladen, GPU-Server installieren, in den Offline-Modus wechseln, Workflow auswählen, generieren.

%20(2).avif)

%20transparent.avif)