Anwenden von Detailer auf AnimateDiff-Videos mit ComfyUI: Eine vollständige Anleitung

Die Anwendung von Detailer auf AnimateDiff-Videos in ComfyUI gewährleistet eine gleichbleibende Qualität und verbesserte Elemente (wie Gesichter und Kleidung) in allen animierten Sequenzen.

In diesem Handbuch wird der gesamte Prozess behandelt — von der Generierung des Basisvideos bis hin zu erweiterten maskenbasierten Bearbeitungen — und wie Promptus diese Arbeitsabläufe vereinfachen kann. 🎬

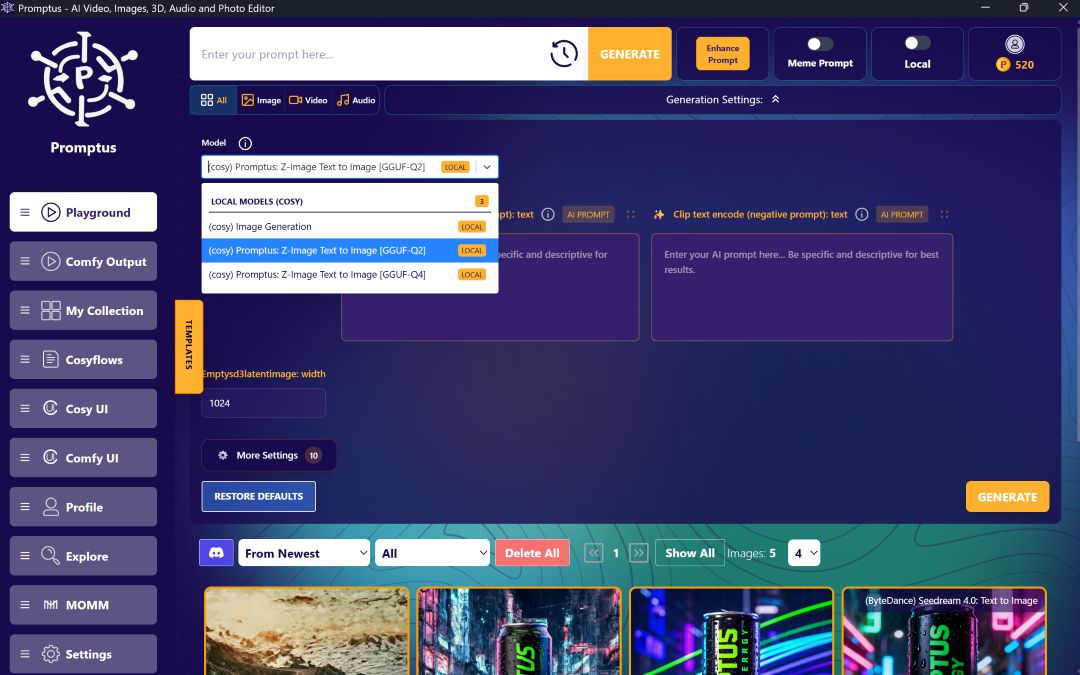

ComfyUI & Promptus im Überblick ✨

Promptus ist eine lokale KI-App, die mit dem Open-Source-Framework ComfyUI kompatibel ist und Folgendes bietet:

- Browserbasierte, Cloud-gestützte Oberfläche über CosyFlows (ohne Code)

- Zusammenarbeit in Echtzeit und Workflow-Publishing (Discord-Integration)

- Zugriff auf erweiterte Modelle: Gemini Flash, HiDream, Hunyuan3D, Stabile Diffusion, GPT-4o, Gemini

- Multimodale Unterstützung: Text, Bild und Video auf einer Plattform

- Verteiltes GPU-Computing für schnelleres Rendern und hochauflösende Ausgaben

Diese Funktionen machen komplexe ComfyUI-Techniken ohne tiefgreifende technische Einrichtung zugänglich.

Den „Detailer For AnimateDiff“ -Prozess verstehen 🔍

Herkömmliche Einzelbilddetails können zu Inkonsistenzen führen. Der Knoten „Detailer For AnimateDiff“ verwendet die Sampling-Methode von AnimateDiff, um einheitliche Verbesserungen auf alle Frames anzuwenden und so Flimmern oder nicht übereinstimmende Details zu verhindern.

Schritt 1: Generieren Sie Ihr AnimateDiff-Basisvideo 🚀

- Originalsequenz erstellen: Verwenden Sie Standard-AnimateDiff-Workflows, um Ihre Basisanimation zu erstellen (z. B. ein Besatzungsmitglied eines Raumschiffs).

- Identifizieren Sie Probleme: Beachten Sie Bereiche, die verbessert werden müssen — in der Regel Gesichter mit niedriger Auflösung oder Kleidungsartefakte.

Schritt 2: Erkennen Sie Gesichtsregionen mit Simple Detector 🕵️ ♂️

- Knoten „Simple Detector for AnimateDiff“ hinzufügen: Verbinde es mit deinen generierten Frames.

- SEGS generieren: Der Knoten erstellt Segmentierungsmasken für Gesichtsbereiche in allen Frames und konsolidiert die erkannten Masken.

Schritt 3: Wenden Sie Unified Detailing mit Detailer For AnimateDiff ✨ an

- Geben Sie SEGS in den Knoten „Detailer For AnimateDiff“ ein: Dadurch wird sichergestellt, dass für jeden Frame dieselbe Maske gilt.

- Detailverbesserung: Der Knoten verfeinert Gesichter (oder andere Zielbereiche) im AnimateDiff-Stil, wodurch die Einheitlichkeit zwischen den Frames gewahrt bleibt und Inkonsistenzen von Bild zu Bild vermieden werden.

Schritt 4: Verstärkte Elemente mit SegsPaste 🎯 zusammensetzen

- Verwenden Sie den Knoten „SegsPaste“: Mischen Sie die verbesserten SEGS auf das Originalmaterial.

- Ergebnis: Natürliche, konsistente Gesichtsverbesserungen während der gesamten Videosequenz.

Fortgeschrittene Technik: Kleidungselemente wechseln 🎨

Demonstrieren Sie Vielseitigkeit, indem Sie Kleidung modifizieren (z. B. einen Rock in eine Hose verwandeln), indem Sie maskenbasiertes Targeting verwenden:

Bereite deinen Workspace vor 🛠️

- Extrahieren Sie einen statischen Frame: Anstatt das gesamte Video sofort zu verarbeiten, exportieren Sie einen repräsentativen Frame.

- Lastrahmen: Benutze „Bild laden“ in ComfyUI.

- Precise Mask auftragen: Definieren Sie den Kleidungsbereich, der geändert werden muss.

Erstellen benutzerdefinierter SEGS aus Masken 🎭

- Verwenden Sie den Knoten „MASK to SEGS“: Wandeln Sie Ihre Maske in einen Segmentierungsbereich um.

- Prompt anpassen: Ändern Sie in der basic_pipe, die mit dem Detailer verbunden ist, die positive Aufforderung, um neue Kleidung anzugeben (z. B. „Spaceman Uniform Pants“).

Mehrschichtiger Verbesserungsprozess 🔄

- Detaillieren Sie zuerst das Gesicht: Verwenden Sie das Gesichtsdetailbild als Eingabe.

- Kleidungswechsel anwenden: Geben Sie den maskierten Rahmen und die aktualisierte Eingabeaufforderung in Detailer + SegsPaste ein.

- Zusammengesetzte Ergebnisse: Kombinieren Sie beide Verbesserungen, sodass das Endergebnis konsistente Gesichtsdetails und transformierte Kleidung aufweist.

Ergebnisse und Qualitätsbewertung ✅

- Konsistentes Gesichtsdetail: Einheitliche Verbesserungen aller Frames dank vereinheitlichtem SEGS.

- Transformation der Kleidung: Maskenbasierte Änderungen führen zu natürlich aussehenden Änderungen, während frühere Verbesserungen beibehalten werden.

- Allgemeine Qualität: Die Pipeline verhindert Flimmern und Artefakte und liefert animierte Sequenzen in professioneller Qualität.

Erste Schritte mit Promptus Studio Comfy 🌐

Um die Implementierung zu vereinfachen:

- Melde dich an: Besuch https://www.promptus.ai

- Wählen Sie Zugriff:

- Promptus Web für browserbasierte Workflows

- Promptus App für die Desktop-Integration

- Workflows importieren oder erstellen: Verwenden Sie CosyFlows, um AnimateDiff + Detailer-Pipelines neu zu erstellen.

- Nutzen Sie Cloud-GPUs: Laden Sie umfangreiche Videoverarbeitungsvorgänge ohne lokale Hardwarebeschränkungen aus.

- Zusammenarbeiten und Veröffentlichen: Teile Workflows, integriere dich mit Discord und arbeite in Echtzeit mit Teams zusammen. 💡

Tipps zur Fehlerbehebung 🛠️

- Installation des Knotens: Stellen Sie sicher, dass die Knoten „Detailer For AnimateDiff“ und „Simple Detector“ über den ComfyUI Manager installiert sind.

- Genauigkeit der Maske: Verfeinern Sie die Masken bei der Bearbeitung von Kleidungsstücken sorgfältig, um zu vermeiden, dass sie in andere Bereiche übergehen.

- Aufführung: Die Videodetaillierung kann ressourcenintensiv sein. Verwenden Sie Cloud-/GPU-Ressourcen in PSC, wenn die lokale Hardware begrenzt ist.

- Konsistenzprüfungen: Zeigen Sie eine Vorschau einiger Bilder an, bevor Sie die gesamte Sequenz verarbeiten, um sicherzustellen, dass die Masken und Detaileinstellungen korrekt sind.

Fazit 🌟

Die Verwendung des Knotens „Detailer For AnimateDiff“ in ComfyUI ermöglicht konsistente, qualitativ hochwertige Verbesserungen animierter Videos. Von der Detaillierung von Gesichtern bis hin zur Transformation von Kleidung — dieser Ansatz verhindert häufige Inkonsistenzen pro Bild.

Eine manuelle Einrichtung ist zwar möglich, Promptus Studio Comfy bietet jedoch eine intuitive, Cloud-beschleunigte Umgebung, in der Sie diese Workflows mühelos erstellen und ausführen können. Nutzen Sie diese Techniken, um Ihre KI-generierten Animationen auf professionelle Standards zu heben! 🚀

%20(2).avif)

%20transparent.avif)