Vollständige Anleitung zur Wanvase-Videogenerierung in ComfyUI

Erste Schritte mit ComfyUI Updates

Stellen Sie vor der Installation des Wan Vase-Modells sicher, dass Ihr ComfyUI ordnungsgemäß aktualisiert ist:

Gehen Sie zunächst zum Manager und klicken Sie auf „Alle aktualisieren“. Wenn das nicht vollständig funktioniert, navigieren Sie zu Ihrem ComfyUI-Installationsordner, suchen Sie den Aktualisierungsordner und führen Sie die Datei „ComfyUI BAT aktualisieren“ aus. Führen Sie nach dem Neustart erneut „Update all“ aus, um sicherzustellen, dass alle Knoten aktuell sind.

Unverzichtbare Node-Installation

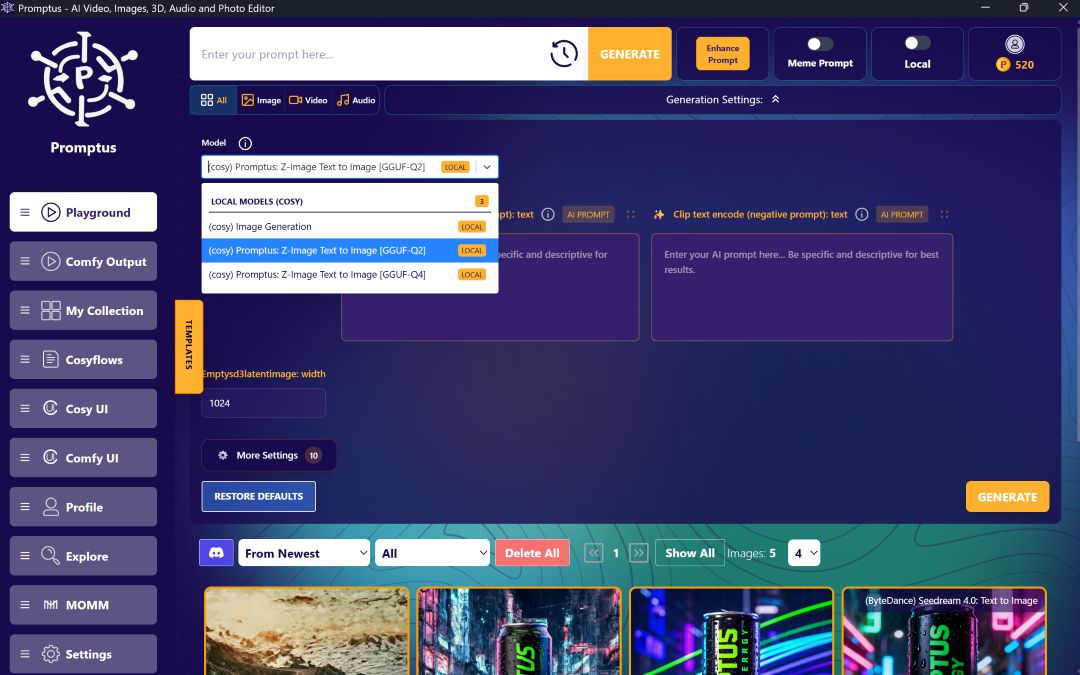

Sie benötigen den Guff-Knoten für alle Workflows. Wenn Sie ihn nicht installiert haben:

- Öffne den Manager

- Gehe zum Manager für benutzerdefinierte Knoten

- Suche nach „Guff“

- Installieren Sie ComfyUI und starten Sie es neu

Für Video-to-Video-Workflows benötigen Sie außerdem den Aux-Knoten, den Sie auf die gleiche Weise finden und installieren können.

Modell-Downloads und Platzierung

Wählen Sie die richtige Modellgröße für Ihre Hardware:

- Q3: Kleinste Version für begrenzten VRAM

- Q4: Ausgewogene Option für die meisten Benutzer

- Q8: Höhere Qualität mit mehr VRAM-Anforderungen

- FP16: Beste Qualität für High-End-Grafikkarten

Platzieren Sie das Hauptmodell im Ordner Diffusionsmodelle. Sie benötigen außerdem:

- Clip-Modell (FPScaled-Version) im Text-Encoder-Ordner

- VAE-Modell im VAE-Ordner

Nachdem Sie alle Modelle heruntergeladen haben, gehen Sie zu „Bearbeiten“ und wählen Sie „Knotendefinitionen aktualisieren“, damit ComfyUI sie erkennen kann.

.avif)

Einrichtung des Text-zu-Video-Workflows

Der grundlegende Arbeitsablauf umfasst:

- Positive und negative Eingabeaufforderungsknoten

- Zum Videomodus wechseln

- Fallprobenehmer

- Latenten Videoknoten kürzen

- Video erstellen und Videoknoten speichern

Konfiguriere deine Einstellungen sorgfältig:

- Halten Sie die Abmessungen unter 1280 Pixeln

- Verwenden Sie Vielfache von 32 für Breite und Höhe

- Begrenzen Sie Videos auf maximal 5 Sekunden

- Berechne Frames mit: (Sekunden × 16 fps) + 1

Für ein 3-Sekunden-Video: (3 × 16) + 1 = 49 Bilder

Konvertierung von Bild zu Video

Die Konvertierung des Text-zu-Video-Workflows ist einfach:

- Fügen Sie einen Lade-Image-Node hinzu

- Verbinden Sie die Bildausgabe mit dem Referenzbildeingang

- Passen Sie die Abmessungen an das Seitenverhältnis Ihres Bildes an

- Erstellen Sie Eingabeaufforderungen, die nur sichtbare Elemente animieren

Dadurch wird verhindert, dass die KI nicht vorhandene Elemente wie Hände hinzufügt, die nicht im Originalbild enthalten waren.

Video-zu-Video-Bewegungssteuerung

Dieser Arbeitsablauf verwendet Bewegung aus einem Referenzvideo:

- Lade dein Kontrollvideo

- Verwenden Sie Präprozessorknoten (Canny, Depth oder Pose)

- Stellen Sie eine Verbindung zum Steuervideoeingang her

- Die KI folgt den Bewegungsmustern des Referenzvideos

Geschwindigkeitsoptimierung mit LoRa

Um die Generierungszeit erheblich zu reduzieren:

- Installieren Sie den RG3 Power LoRa-Loader-Knoten

- Laden Sie die Geschwindigkeitsoptimierung LoRa herunter

- Lege es in den LoRAS-Ordner

- Verwenden Sie die Stärkeeinstellung 0,25

Passen Sie diese Sampling-Einstellungen an:

- Schritte: 4-6 (statt Standard 20)

- CFG: 6

- Scheduler: Euler Ancestral mit Beta

Farbkorrektur für LoRa-Ergebnisse

LoRa kann Farben und Kontraste verändern. Korrigiere das mit:

- Einfach zu bedienender Knoten (Installation über den Manager)

- Knoten zur Farbabstimmung nach der VAE-Decodierung

- Verwenden Sie das Originalbild als Referenz

- Auf alle generierten Frames anwenden

Qualitätsvergleich und Erwartungen

Während das Wanvase-Modell bei einer kostenlosen Option beeindruckende Ergebnisse liefert, bieten kostenpflichtige Dienste wie Kling AI immer noch eine hervorragende Qualität. Die Lücke verringert sich jedoch, und der Open-Source-Charakter ermöglicht eine Anpassung und lokale Verarbeitung.

Tipps zur Leistung

Die Generationszeiten variieren erheblich:

- RTX 4090:6-7 Minuten für Standardeinstellungen

- Kleinere Modelle generieren schneller, aber mit reduzierter Qualität

- Cloud-Plattformen wie RunningHub bieten alternative Verarbeitungsoptionen

- Die HD-Auflösung kann mehr als 20 Minuten pro Video dauern

Steigern Sie die KI-Nutzung Ihres Teams — arbeiten Sie mit Promptus zusammen. Sei ein Creator auf

%20(2).avif)

%20transparent.avif)