Erstellen Sie einen kompletten ComfyUI Wan 2.1-Image-to-Video-Workflow von Grund auf. Dieses Handbuch konzentriert sich auf die native ComfyUI-Implementierung, die nahtlos mit dem klassischen K-Sampler zusammenarbeitet

In diesem umfassenden Tutorial erstellen wir einen kompletten ComfyUI Wan 2.1-Image-zu-Video-Workflow von Grund auf. Dieses Handbuch konzentriert sich auf die native ComfyUI-Implementierung, die nahtlos mit dem klassischen K-Sampler zusammenarbeitet und die Videogenerierung für Entwickler auf jedem Niveau zugänglich und unkompliziert macht.

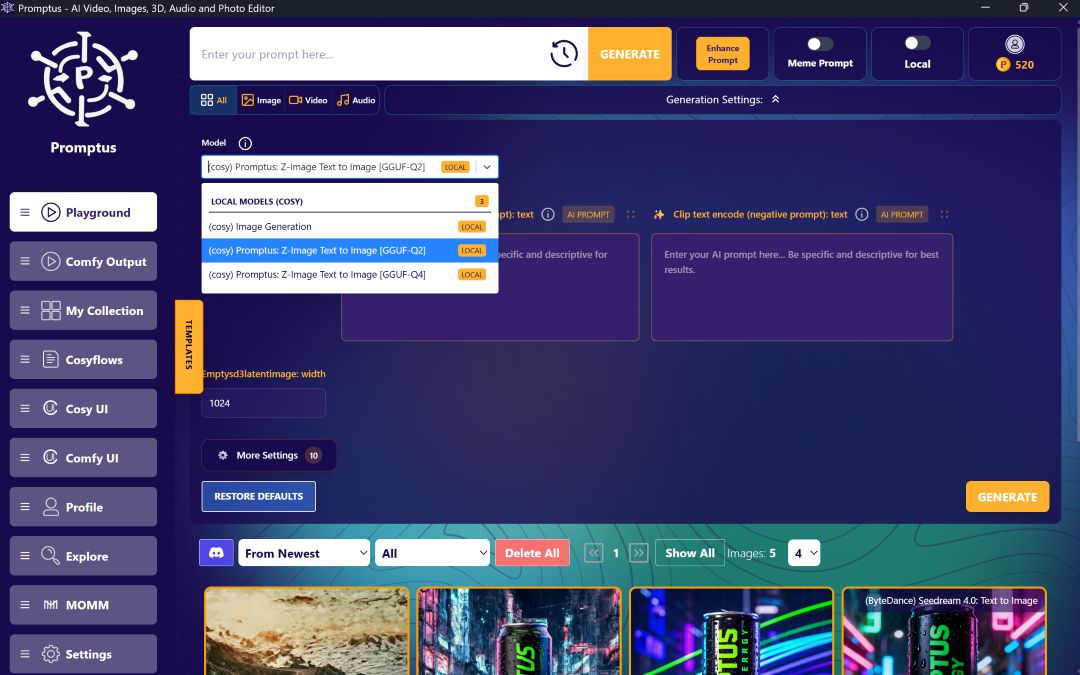

Voraussetzungen und Einrichtungsanforderungen

Bevor Sie mit Wan 2.1 beginnen, müssen Sie ComfyUI auf die neueste Version aktualisieren. Ohne dieses Update sind die Wan 2.1-Knoten nicht verfügbar, unabhängig davon, welchen Workflow Sie verwenden möchten.

Der Workflow erfordert mehrere spezifische Modelle, die in den richtigen Verzeichnissen innerhalb Ihrer ComfyUI-Installation platziert werden müssen:

Erforderliche Modelle:

- Wan 2.1 Image-to-Video-Modell (14B FP8E4-Version wird für eine bessere Leistung empfohlen)

- UMP T5XXL-Text-Encoder (ähnlich dem T5XXL von Flux, unterstützt aber mehrere Sprachen)

- Wan 2.1 VAE

- Modell Clip Vision H

Verzeichnisstruktur:

- Die wichtigsten Modelle gehen rein: ComfyUI/Models/Diffusion_Models/

- Text-Encoder gehen rein: com.fyUI/models/text_encoders/

- VAE-Dateien gehen rein: com.fyUI/Models/VAE/

- Clipvision-Modelle gehen rein: com.fyUI/models/clip_vision/

Aufbau des Kernworkflows

Beginnen Sie mit dem Grundfundament, indem Sie Ihr Hauptmodell laden. Der Arbeitsablauf beginnt ähnlich wie bei herkömmlichen Bildgenerierungs-Setups, umfasst jedoch spezielle Komponenten zur Videovorverarbeitung.

Grundlegende Node-Setup:

1. Laden Sie das Wan 2.1-Hauptmodell

2. Fügen Sie positive und negative Eingabeaufforderungseingaben hinzu (jeweils grün und rot gefärbt)

3. Verbinden Sie den VAE-Decoder und den VAE-Lader

4. Fügen Sie den Clip-Loader mit dem UMP T5XXL-Modell hinzu

Der Hauptunterschied zu Standard-Workflows besteht darin, das leere latente Bild durch den Präprozessorknoten „Bild zu Video“ zu ersetzen. Dieser Knoten nimmt Informationen von der linken Seite Ihres Workflows auf und bereitet sie für den K-Sampler vor.

Videospezifische Komponenten:

- Präprozessorknoten von Bild zu Video

- Clip Vision Encode-Knoten

- Clip Vision Loader (mit Clip Vision H)

- Bildeingabe für dein Startbild

- Video Combine-Knoten für die endgültige Ausgabe

Den neuen Text-Encoder verstehen

Der UMP T5XXL-Text-Encoder funktioniert wie ein großes Sprachmodell, sodass Sie Eingabeaufforderungen in natürlichen Sätzen statt in kommagetrennten Tags schreiben können. Dieser Encoder unterstützt mehrere Sprachen, einschließlich chinesischer Schriftzeichen, und bietet Funktionen für negative Eingabeaufforderungen, die in einigen anderen neueren Modellen nicht verfügbar waren.

Du kannst dein Video in einer Konversationssprache beschreiben und gleichzeitig die genaue Kontrolle über den Generierungsprozess behalten

KONFIGURATION DER VIDEOPARAMETER

Der Workflow umfasst mehrere wichtige videospezifische Einstellungen:

Frame-Einstellungen:

- Standard-Frame-Anzahl: 65 Frames

- Bildrate: typischerweise 16 FPS (einstellbar)

- Auflösung: Passen Sie nach Möglichkeit die Abmessungen Ihres Eingabebildes an

- Stapelgröße: Anzahl der zu generierenden Videovariationen

Sampler-Konfiguration:

- DDIM-Scheduler für Video empfohlen (weniger steif als Euler)

- Es gelten die üblichen Probenahmeschritte

- Die CFG-Skala funktioniert ähnlich wie die Bildgenerierung

AUFFORDERUNGSTECHNIKEN FÜR DIE VIDEOGENERIERUNG

Effektive Videoaufforderungen unterscheiden sich von statischen Bildaufforderungen. Konzentrieren Sie sich auf die Beschreibung der Kamerabewegungen, des Motivverhaltens und der Umgebungsfaktoren.

Beispiele für die Kamerasteuerung:

- „Statische Kameraaufnahme“ — minimale Kamerabewegungen

- „Kamera schwenkt zur Nahaufnahme“ — gerichtete Kamerabewegung

- „Tracking-Aufnahme“ — folgt der Bewegung des Motivs

- „Crashzoom“ — schnelles Zoomen auf ein bestimmtes Element

Betreff Richtung:

- Beschreiben Sie, was das Subjekt tun soll

- Erwähnen Sie Umweltinteraktionen

- Geben Sie an, ob Elemente still bleiben sollen

- Detaillieren Sie alle sich wiederholenden Bewegungen wie „Pulsieren“ oder „Atmen“

Angaben zur Umgebung:

- Beschreiben Sie atmosphärische Effekte wie Blasen, Rauch oder Partikel

- Erwähnen Sie Lichtveränderungen oder -effekte

- Fügen Sie Hintergrundaktivitäten oder Bewegungen hinzu

OPTIMIERUNG VON LEISTUNG UND QUALITÄT

Die FP8E4-Modellversion bietet ein gutes Gleichgewicht zwischen Qualität und Systemanforderungen. Das 14B-Parametermodell mit 6,74 GB bietet auf den meisten modernen Systemen eine angemessene Leistung bei gleichzeitig guter Ausgabequalität.

Tipps zur Leistung:

- Beginnen Sie zum Testen mit einer niedrigeren Frame-Anzahl

- Verwenden Sie die quantisierten FP8-Versionen für eine bessere Leistung

- Passen Sie die Auflösung des Eingabebilds an, um unnötige Verarbeitung zu vermeiden

- Erwägen Sie die Stapelverarbeitung für mehrere Varianten

Überlegungen zur Qualität:

- Bei Videos, die länger als 6-8 Sekunden sind, können Morphing-Probleme auftreten

- Halten Sie wichtige Themen innerhalb der Bildgrenzen

- Verwenden Sie eine konsistente Beleuchtung in Quellbildern

- Berücksichtigen Sie das Verhältnis zwischen Bildrate und Videolänge

BEHEBUNG HÄUFIG AUFTRETENDER PROBLEME

Wenn sich Elemente nicht wie erwartet verhalten, verfeinern Sie Ihre Eingabeaufforderungen mit einer spezifischeren Sprache. Wenn sich die Kamera trotz „statischer“ Anweisungen zu stark bewegt, fügen Sie „Stillstehen“ oder ähnliche stabilisierende Phrasen hinzu.

Wenn Umwelteinflüsse wie Blasen oder Partikel fehlen, überprüfen Sie Ihre Schreibweise und probieren Sie alternative beschreibende Begriffe aus. Das Modell reagiert gut auf detaillierte Beschreibungen dessen, was in der Szene passieren sollte.

ERWEITERTE WORKFLOW-ANPASSUNG

Der grundlegende Arbeitsablauf kann um zusätzliche Vorverarbeitungsknoten, Upscaling-Komponenten oder mehrere Videoausgänge erweitert werden. Die LoRa-Integration ist möglich, funktioniert aber besser, wenn sie auf Quellbilder angewendet wird als direkt bei der Videogenerierung.

Erwägen Sie, Keyframe-Sequenzen außerhalb des Videogenerators zu erstellen und diesen Arbeitsablauf zu verwenden, um zwischen ihnen Animationen für längere Inhalte zu erstellen.

FAZIT

ComfyUI Wan 2.1 stellt einen bedeutenden Fortschritt in der Open-Source-Videogenerierung dar und bietet Funktionen, die mit Closed-Source-Alternativen mithalten können. Die native Integration in das Node-System von ComfyUI macht es zugänglich und bietet gleichzeitig die Flexibilität, Arbeitsabläufe an spezifische Bedürfnisse anzupassen.

Die Kombination aus natürlicher Sprachaufforderung, Unterstützung negativer Eingabeaufforderungen und der vertrauten K-Sampler-Oberfläche schafft ein leistungsstarkes und dennoch leicht zugängliches Videogenerierungssystem. Da sich die Open-Source-Videogenerierung weiterhin rasant weiterentwickelt, sind die Entwickler durch die Beherrschung dieser grundlegenden Techniken in der Lage, zukünftige Entwicklungen optimal zu nutzen.

Call to Action: Steigern Sie die KI-Nutzung Ihres Teams — arbeiten Sie mit Promptus zusammen. Sei ein Schöpfer auf https://www.promptus.ai

%20(2).avif)

%20transparent.avif)