Vollständiges Tutorial zur ComfyUI WAN 2.1-Videogenerierung

Das WAN-Modell bietet professionelle Videogenerierungsfunktionen über die zugängliche Schnittstelle von Promptus Studio Comfy (PSC).

Dieses Promptus WAN 2.1-Tutorial führt Sie durch die Generierung von Videos aus Textanfragen, Bildern und die Steuerung von Videos mit Referenzmaterial.

Erfahren Sie, wie Sie das neueste WAN 2.1-Modell für professionelle Videogenerierungsergebnisse einrichten.

⚙️ Ersteinrichtung und Installation

Stellen Sie zunächst sicher, dass Ihre ComfyUI-Installation aktuell ist. Navigieren Sie zum Manager und wählen Sie Alle aktualisieren. Wenn diese Methode fehlschlägt, suchen Sie Ihr ComfyUI-Installationsverzeichnis, suchen Sie den Aktualisierungsordner und führen Sie die ComfyUI BAT-Datei für das Update aus.

Führen Sie nach dem Öffnen von ComfyUI erneut update all aus, um alle Knoten zu aktualisieren. Warten Sie, bis die Installation abgeschlossen ist, und starten Sie sie neu, wenn Sie dazu aufgefordert werden.

Drei Workflow-Optionen können kostenlos von Discord heruntergeladen werden. In der Beschreibung finden Sie detaillierte Informationen.

%20(3).avif)

📦 Erforderliche Knoten und Modelle

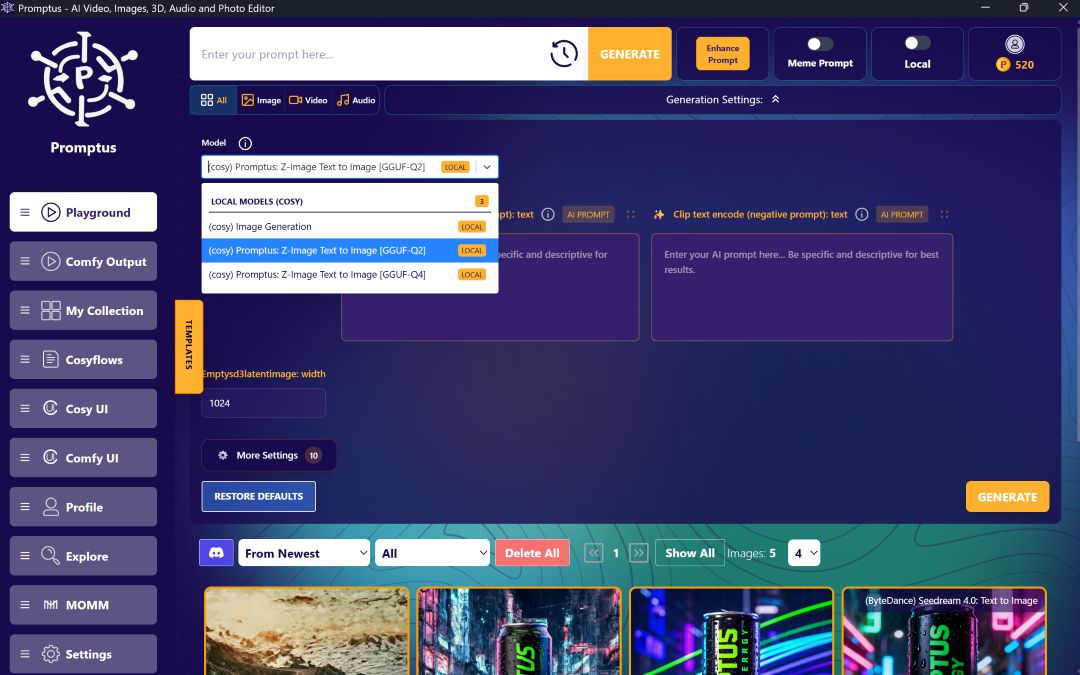

Für Knoten benötigen Sie nur den Guff-Knoten. Falls noch nicht installiert, greifen Sie auf den Manager zu, öffnen Sie den Manager für benutzerdefinierte Knoten, suchen Sie nach Guff und installieren Sie ihn. Starten Sie ComfyUI anschließend neu.

Die Modellauswahl ist entscheidend, da die Generationsgeschwindigkeit extrem langsam ist. Eine Q4-Version eignet sich gut für eine ausgewogene Leistung. Größere Modelle benötigen deutlich mehr Verarbeitungszeit — Minuten statt Sekunden, selbst auf High-End-Geräten wie RTX 4090. Zu den verfügbaren Modellgrößen gehören Q8 für bessere Qualität, Q3 für minimale VRAM-Anforderungen oder Version 16 für maximale Qualität mit Premium-Grafikkarten.

Platzieren Sie heruntergeladene Modelle im Ordner Diffusionsmodelle. Laden Sie zusätzlich die FPScaled-Clipmodellversion herunter, die sich von Flux-Modellen unterscheidet, und speichern Sie sie im Ordner Text Encoders. Für eine verbesserte Qualität ist eine größere FP16-Version verfügbar. Laden Sie abschließend die VAE-Datei herunter und platzieren Sie sie im VAE-Ordner.

Wählen Sie nach Abschluss des Downloads die Option Bearbeiten und aktualisieren Sie die Knotendefinitionen, damit ComfyUI neue Modelle erkennt.

🎞️ Workflow-Setup von Text zu Video

Der Arbeitsablauf erfordert mehrere Komponenten: positive und negative Eingabeaufforderungen, eine Vase zum Videoknoten, Fallsampler, Trimmen eines latenten Videoknotens für das Frame-Trimmen, Erstellen eines Videoknotens und Speichern des Videoknotens. Videos werden automatisch in einem erstellten Videoordner gespeichert. Dieser Speicherort ist jedoch anpassbar.

Zu den empfohlenen Einstellungen gehören Breiten-, Höhen- und Längenkonfigurationen, die gut mit Standardabmessungen funktionieren. Vermeiden Sie die Überschreitung von 1280 Pixeln, da bei größeren Größen mehr als 40 Minuten pro Video benötigt werden. Passen Sie die Abmessungen an, indem Sie ein Vielfaches von 32 verwenden.

Der Workflow verwendet 16 Bilder pro Sekunde. Für Berechnungen der Dauer multiplizieren Sie die gewünschten Sekunden mit 16 Bildern pro Sekunde und fügen Sie dann ein zusätzliches Bild hinzu. Zum Beispiel: 3 Sekunden × 16 Bilder pro Sekunde + 1 = insgesamt 49 Bilder.

Verwenden Sie ChatGPT, um effektive Eingabeaufforderungen zu generieren, indem Sie Ihre Vision beschreiben und Aufforderungen zum KI-Videomodell anfordern. Die meisten Eingabeaufforderungen funktionieren ohne spezielle Formatierung.

🖼️ Konvertierung von Bild zu Video

Die Konvertierung von Text-zu-Video-Workflows in Bild-zu-Video ist unkompliziert. Doppelklicken Sie auf die Leinwand und fügen Sie einen Lade-Image-Node hinzu. Laden Sie Ihr Referenzbild hoch und verwenden Sie dann ChatGPT, um auf der Grundlage des Bildinhalts entsprechende Videoaufforderungen zu generieren.

Verbinden Sie die Bildausgabe mit dem Referenzbildeingang. Stellen Sie sicher, dass die Abmessungen dem Seitenverhältnis Ihres hochgeladenen Bildes entsprechen, bevor Sie den Workflow ausführen.

Die Generierung dauert in der Regel 6-7 Minuten pro Video. Verschiedene Modelle können auf verschiedenen Systemen trotz Größenunterschieden aufgrund von Optimierungsunterschieden schneller arbeiten. Im Allgemeinen werden kleinere Q-Versionen schneller verarbeitet, aber die Qualität leidet darunter.

▶️ Workflow von Video zu Video

Für diesen Workflow ist ein zusätzlicher Aux-Knoten erforderlich. Installieren Sie es über den Manager, falls nicht vorhanden, und starten Sie ComfyUI neu. Das Setup ähnelt Bild-zu-Video-Workflows, verwendet jedoch Referenzvideos für die Bewegungssteuerung.

Fügen Sie einen Präprozessorknoten hinzu, der ControlNet-Optionen wie Canny, Depth oder Pose ähnelt und eine Verbindung zum Kontrollvideo herstellt. Das System folgt der Bewegung des Referenzvideos, ohne dass echte ControlNet-Modelle erforderlich sind.

⚡ Geschwindigkeitsoptimierung mit Laura

Installieren Sie den RG3-Knoten für die Power Laura-Lader-Funktionalität. Laden Sie die empfohlene Laura-Datei herunter und platzieren Sie sie im Loras-Ordner. Aktualisieren Sie die Knotendefinitionen und laden Sie Laura mit den Stärkeeinstellungen von 0,25.

Positionieren Sie den Laura-Knoten nach dem Laden des Modells, aber vor dem Sampling. Verbinden Sie den Clip mit diesem Knoten, bevor positive und negative Eingabeaufforderungen angezeigt werden.

Zu den kritischen Einstellungen gehören 4-6 Schritte statt der üblichen 20, CFG von 6, Euler Ancestral und Beta Scheduler. Laura erhöht die Generierungsgeschwindigkeit erheblich, kann jedoch Farben verändern und den Kontrast erhöhen.

🎨 Lösung zur Farbkorrektur

Installieren Sie das einfach zu verwendende Node-Paket, falls es nicht verfügbar ist. Fügen Sie nach der VAE-Decodierung den Knoten für die Farbabstimmung hinzu, wobei das Originalbild als Referenz und die dekodierten Frames als Ziel verwendet werden. Diese Korrektur behebt Lauras Kontrastprobleme und behält gleichzeitig die Geschwindigkeitsvorteile bei.

📊 Qualitätsvergleich

Das WAN-Modell liefert im Vergleich zu kostenpflichtigen Alternativen wie Kling AI wettbewerbsfähige Ergebnisse und bietet professionelle Videogenerierungsfunktionen über die zugängliche Oberfläche von Promptus Studio Comfy.

📣 Aufruf zum Handeln

Steigern Sie die KI-Nutzung Ihres Teams — arbeiten Sie mit Promptus zusammen. Sei ein Schöpfer bei https://www.promptus.ai 🎉 Genießen Sie Ihre Reise mit der WAN 2.1-Videogenerierung in PSC!

%20(2).avif)

%20transparent.avif)