ComfyUI ControlNet-Leitfaden für präzise KI-Workflows

Präprozessor-Vergleichstabelle und erweiterter Abschnitt zur VRAM-Optimierung für SDXL-Workflows hinzugefügt.

Wenn Sie die KI-Bildgenerierung genau kontrollieren möchten, anstatt auf gute Ergebnisse zu hoffen, ändert ControlNet alles. Diese Anleitung zeigt Ihnen, wie Sie ControlNet in ComfyUI verwenden, um Workflows zu erstellen, die genau auf Ihre kreative Ausrichtung abgestimmt sind. Sie lernen die Installation mit dem ComfyUI Manager, die Einrichtung der Vorverarbeitung und die Parameteroptimierung, die in der Produktion tatsächlich funktioniert.

Was du bauen oder lernen wirst

- Ein vollständiger ControlNet-Workflow von der Skizze oder dem Referenzbild bis zur endgültigen Ausgabe

- Wie wählt und konfiguriert man Präprozessoren für verschiedene Steuerungstypen

- Kraft- und Konditionierung für subtile oder dramatische Kontrolleffekte

- Fehlerbehebung bei häufigen ControlNet-Ausfällen, einschließlich leerer Ausgänge und schwacher Konditionierung

- Kompromisse zwischen lokaler und Cloud-Ausführung bei der Batch-Verarbeitung

- Erweitertes Multi-ControlNet-Stacking für komplexe Kompositionen

Voraussetzungen

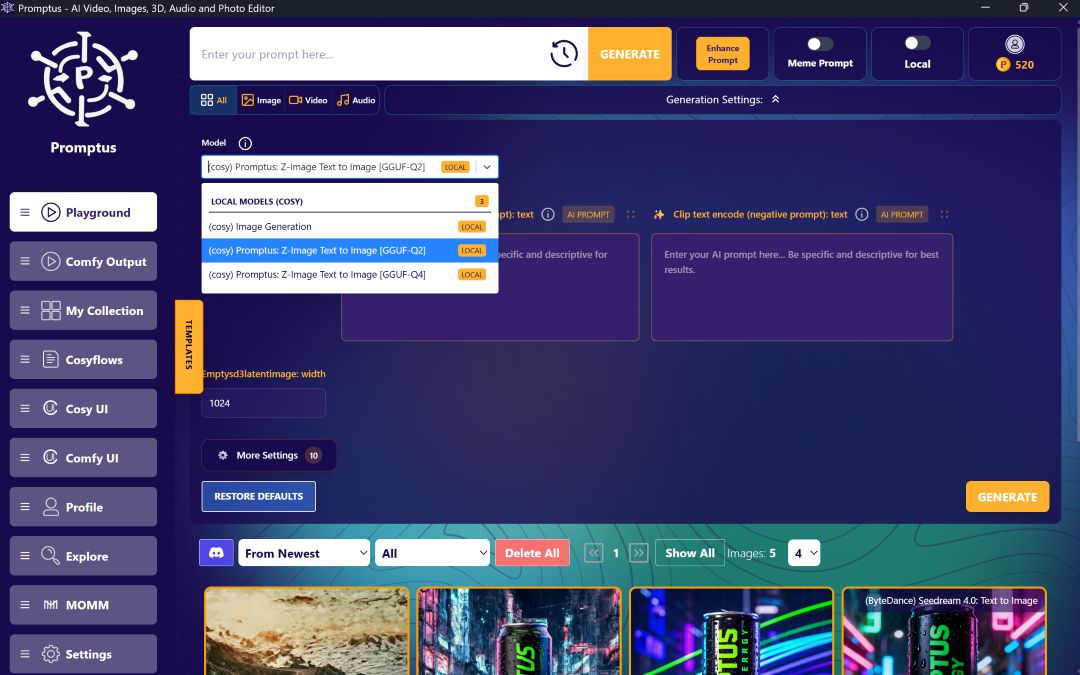

- Promptus mit installiertem und laufendem ComfyUI, Version 0.2.0 oder höher empfohlen

- Mindestens 8 GB VRAM für SD1.5-Workflows, mindestens 12 GB für SDXL

- Ein Basis-Checkpoint-Modell wurde heruntergeladen, z. B. Stable Diffusion 1.5 oder SDXL

- Grundlegende Vertrautheit mit Knoten und Verbindungen in ComfyUI

- ComfyUI Manager für einfache Modell-Downloads installiert

Anleitung Schritt für Schritt

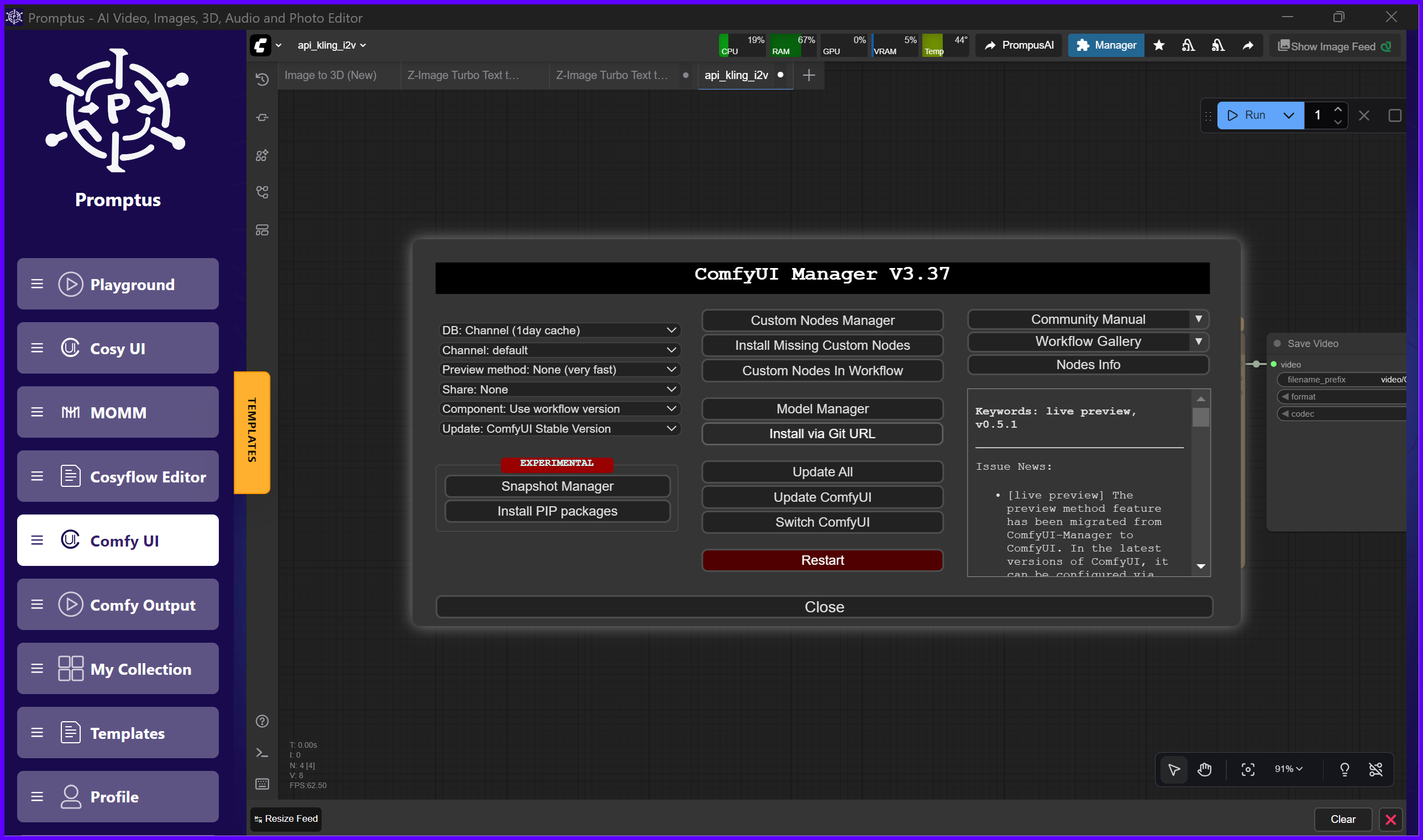

Schritt 1: ControlNet-Modelle über ComfyUI Manager installieren

Öffnen Sie ComfyUI und klicken Sie in der Benutzeroberfläche auf die Schaltfläche Manager. Navigieren Sie zu Modelle installieren. Suchen Sie nach ControlNet und Sie erhalten eine nach Modellversion und Steuerungstyp geordnete Liste. Laden Sie für SD1.5 control_v11p_sd15_canny für die Kantenerkennung herunter. Laden Sie für SDXL control-lora-canny-rank256 herunter, das weniger VRAM verwendet.

Der Manager kümmert sich automatisch um die Dateiplatzierung. Modelle werden auf comfyUI/Models/ControlNet installiert. Wenn Sie eine manuelle Installation bevorzugen, laden Sie es aus dem offiziellen ControlNet-Repository herunter und platzieren Sie die Dateien in demselben Verzeichnis.

Schritt 2: ControlNet-Präprozessorknoten installieren

Gehen Sie im ComfyUI Manager zu Benutzerdefinierte Knoten installieren. Suchen Sie nach den ControlNet Auxiliary Preprocessors von ComfyUI. Installieren Sie dieses Paket. Es fügt automatische Vorverarbeitungsknoten hinzu, die Ihre Bilder in die von ControlNet erwarteten Kantenkarten, Tiefenkarten oder Posenskelette umwandeln. Ohne diese Knoten bräuchten Sie separate Software wie Photoshop oder Python-Skripte, um Kontrollbilder vorzubereiten. Die Präprozessorknoten lassen sich direkt in Ihren Arbeitsablauf integrieren und werden in Echtzeit aktualisiert.

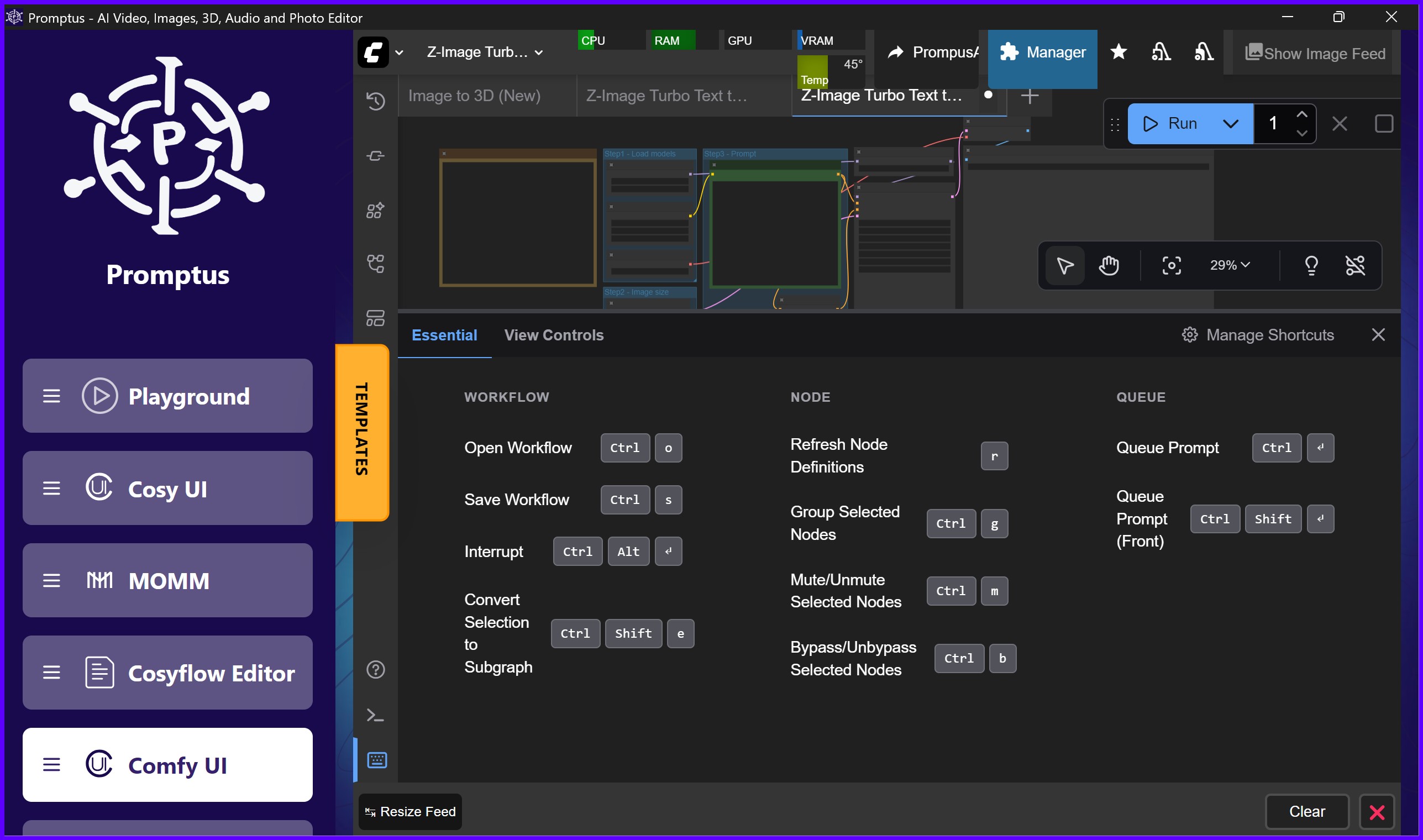

Erstellen Sie einen neuen Workflow. Fügen Sie einen Load Image-Knoten für Ihre Kontrollreferenz hinzu. Fügen Sie einen Canny Edge-Präprozessor-Knoten hinzu, wenn Sie mit Strichzeichnungen oder Skizzen arbeiten. Verbinden Sie Ihre Load Image-Ausgabe mit dem Präprozessor-Eingang.

Fügen Sie einen Load Checkpoint-Knoten hinzu und wählen Sie Ihr Basismodell aus. Fügen Sie einen Apply ControlNet-Knoten hinzu.

Verbinden Sie die Präprozessor-Bildausgabe mit dem Steuerbildeingang auf Apply ControlNet. Verbinden Sie Ihr Checkpoint-Modell mit der Modelleingabe.

Fügen Sie einen CLIP-Text-Encode-Knoten für Ihre positive Aufforderung und einen weiteren für eine negative Aufforderung hinzu. Fügen Sie einen KSampler-Knoten hinzu. Verbinden Sie die konditionierte Modellausgabe von Apply ControlNet mit der Modelleingabe auf KSampler. Verbinde deine positive und negative Konditionierung. Fügen Sie abschließend einen VAE-Decoder-Knoten und einen Save Image-Knoten hinzu, um die Kette zu vervollständigen.

Diese Struktur bildet das Fundament.

Jeder ControlNet-Workflow folgt diesem Muster: Steuerbild laden, vorverarbeiten, ControlNet-Konditionierung anwenden, Sampler ausführen, dekodieren und speichern.

Schritt 4: ControlNet-Stärke konfigurieren

Im Knoten Apply ControlNet wird ein Stärkeparameter angezeigt. Dies steuert, wie strikt die KI Ihrem Kontrollbild folgt. Eine Stärke von 1,0 erzwingt die exakte Einhaltung aller Kanten und Linien in deiner Kontrollkarte. Eine Stärke von 0,3 sorgt für sanfte Führung und bietet gleichzeitig mehr kreativen Freiraum.

- Beginnen Sie bei der Arbeit von der Skizze bis zum Bild bei 0,7.

- Für eine subtile Anleitung zur Komposition versuchen Sie es mit 0,5.

- Verwenden Sie für Architekturzeichnungen oder technische Diagramme, bei denen es auf Präzision ankommt, 0,9 bis 1,0.

Ich habe das auf die harte Tour gelernt, als ein Kunde anfängliche Ergebnisse ablehnte, weil Gesichter nachgezeichnet statt natürlich aussahen. Die Reduzierung der Festigkeit von 1,0 auf 0,8 führte zu organischeren Ergebnissen, während gleichzeitig die Richtwerte eingehalten wurden.

%20(2).avif)

%20transparent.avif)