Wan 2.1 Lip Sync in Promptus ComfyUI hat gerade ein massives Upgrade erhalten!

In diesem Video untersuchen wir die neueste Entwicklung von KI-gesteuerten sprechenden Avataren: den MultiTalk Lipsync-Modell jetzt vollständig integriert in die WAN 2.1-Videorahmenund liefert KI-Konversationen mit mehreren Charakteren, die sich beeindruckend natürlich anfühlen.

Wan 2.1 neue Multitalk-Funktionen

- Unterstützung für mehrere Audiodateien für bis zu vier einzigartige KI-Stimmen in einem Video.

- Ein eleganter Arbeitsablauf, der Folgendes kombiniert:

- Ollama (oder andere LLMs) um Konversationsskripte zu strukturieren.

- Chatterbox Dialog TTS, einschließlich Klonen von Stimmen Demos mit kurzen und längeren Samples.

- Aktualisiertes WAN-Video für die richtige Video-Lippensynchronisation und Gesichtsanimation.

- Alles segmentieren + Masken-/Bildgruppen vorbereiten um Charaktere für eine genaue visuelle Kontrolle zu isolieren.

- Tagebucheinteilung der Sprecher um herauszufinden, welcher KI-Charakter wann spricht.

Diese Pipeline läuft reibungslos lokal oder auf Cloud-GPUs, ermöglicht es YouTubern, ihre eigenen KI-gehosteten Podcasts, Interviews und Storytelling mit mehreren Charakteren zu erstellen — direkt von ComfyUI aus.

🔍 Tests und Leistung in der realen Welt

Wir demonstrieren nicht nur — wir testen. Du wirst eine 3-minütige Demo mit zwei Stimmen sehen, die sauber in separate Audiotracks aufgeteilt sind. Unter Verwendung des WAN 2.1-Frameworks wird das Video gerendert 1.500 Bilder in Blöcken (jeweils ~81 Frames), ungefähr 19 Minuten. Sie werden den reibungslosen Ablauf der Animationen, realistische Hintergrunddetails und Bereiche beobachten, die noch optimiert werden müssen — wie gelegentliches Mundflackern oder Körperbewegungen, wenn ein Avatar spricht.

🎯 Wo es glänzt (und wo es immer noch hart ist)

✅ Vorteile:

- Ansprechender Gesprächsfluss im Podcast-Stil

- Saubere Trennung der Stimmen → sauberere Lippensynchronisierung

- Präsenz der Hintergrundszene

- Läuft offline mit GGUF-Quantisierung Unterstützung

⚠️ Nachteile:

- Gelegentlich bewegen sich beide Avatare während einer einzigen Stimme

- Die Gesichtssynchronisierung ist nicht immer perfekt

- Das System weist die Maske dem Audio nicht immer korrekt zu

Ein klarer Imbiss? Es besteht dringender Bedarf an zukünftigen Verbesserungen, wie z. B. der expliziten Zuordnung von Maske zu Audio in Konfigurationen mit mehreren Charakteren — ähnlich dem Ansatz von Cling AI oder Runway.

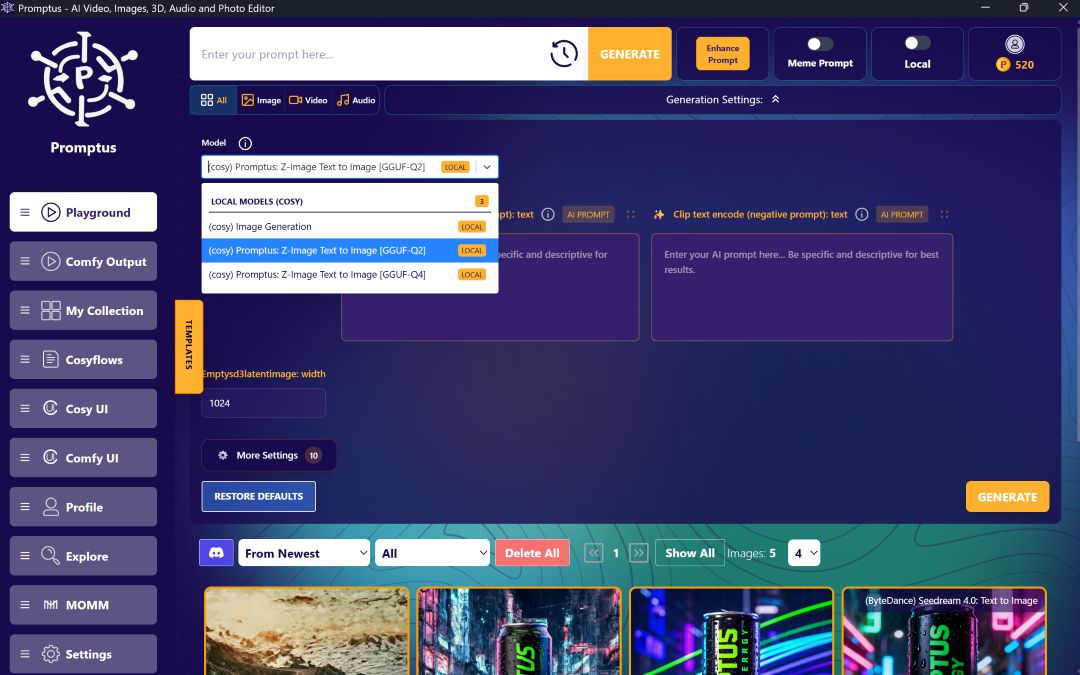

Promptus App — Einmal kaufen, lokal erstellen

Diese vollständige Pipeline ist eingebaut in Promptus-Plattform, das leistungsstarke ComfyUI-basierte Tools für die Bild-, Video- und Audiogenerierung mit KI bietet. Das Beste von allem, es gibt eine einmalige Kaufoption (lebenslange Lizenz im Wert von 49 USD) ohne monatliche Gebühren. Diese einmalige Zahlung gewährt:

- Voller Offline-Zugriff auf WAN 2.1 und alle Cosyflows

- 10.000 Bonusguthaben

- ComfyUI Oberfläche

- Lebenslange Updates und Support

Oder es gibt optionale monatliches Abo Stufen für Entwickler, die fortlaufenden Cloud-GPU-Zugriff benötigen,

🔧 Wer sollte sich das ansehen?

- KI-Entwickler Avatare mit mehreren Charakteren erstellen

- Ersteller von Inhalten Erkunden von KI-gehosteten Podcasts oder Interviews

- Technologen Beherrschen von Ollama-, TTS-, Segmentierungs- und Lippensynchronisationsmodellen

Dieses Tutorial ist nicht nur eine Komplettlösung — es bietet einen realistischen Überblick über die Stärken und Schwächen der Pipeline und gibt Ihnen die Tools an die Hand, mit denen Sie entscheiden können, ob dies für Ihr nächstes Projekt geeignet ist.

🔗 Ressourcen und Links

- WAN 2.1-Videoworkflows

- Hol dir das Promptus app einmal kaufen — einmalig 49$ inklusive 10.000 Credits!

Tauche ein, experimentiere und lass uns wissen, wie es läuft!

%20(2).avif)

%20transparent.avif)