¡La sincronización de labios Wan 2.1 en Promptus ComfyUI acaba de recibir una actualización masiva!

En este vídeo, exploramos la última evolución de los avatares parlantes impulsados por la IA: los Modelo MultiTalk Lipsync ahora totalmente integrado en el Marco de vídeo WAN 2.1, ofreciendo conversaciones de IA con varios personajes con una naturalidad impresionante.

🚀 ¿Qué hay de nuevo?

- Soporte de audio múltiple para hasta cuatro voces únicas de IA en un vídeo.

- Un flujo de trabajo elegante que combina:

- Ollama (u otros LLM) para estructurar guiones conversacionales.

- Cuadro de diálogo TTS de Chatterbox, incluyendo clonación de voz demos con muestras cortas y largas.

- Envoltorio de vídeo WAN actualizado para una correcta sincronización de labios de vídeo y animación facial.

- Segmenta cualquier cosa y prepara grupos de máscaras/imágenes para aislar a los personajes para un control visual preciso.

- Diarización de altavoces para identificar qué personaje de IA está hablando y cuándo.

Esta canalización funciona a la perfección GPUs locales o en la nube, lo que permite a los creadores crear sus propios podcasts, entrevistas y narraciones de varios personajes alojados en la IA, directamente desde ComfyUI.

🔍 Pruebas y rendimiento en el mundo real

No solo hacemos demostraciones, sino que también hacemos pruebas. Verás una demo de 3 minutos con dos voces, divididas de forma ordenada en pistas de audio independientes. Con la estructura WAN 2.1, el vídeo se renderiza 1.500 fotogramas en trozos (~81 fotogramas cada uno), tomando alrededor de 19 minutos. Observarás el flujo fluido de la animación, los detalles realistas del fondo y las áreas que aún necesitan ajustes, como el parpadeo ocasional de la boca o los movimientos del cuerpo cuando un avatar habla.

🎯 Dónde brilla (y dónde todavía es difícil)

✅ Ventajas:

- Flujo conversacional atractivo al estilo de un podcast

- Separación limpia de voces → sincronización de labios más limpia

- Presencia en la escena de fondo

- Funciona sin conexión con Cuantificación de GUF apoyo

⚠️ Contras:

- Ocasionalmente, ambos avatares se mueven con una sola voz.

- La sincronización facial no siempre es perfecta

- El sistema no siempre asigna correctamente la máscara al audio

¿Una conclusión clara? Hay una gran necesidad de mejoras en el futuro, como la asignación explícita de la máscara al audio en configuraciones con varios personajes, algo similar al enfoque de Cling AI o Runway.

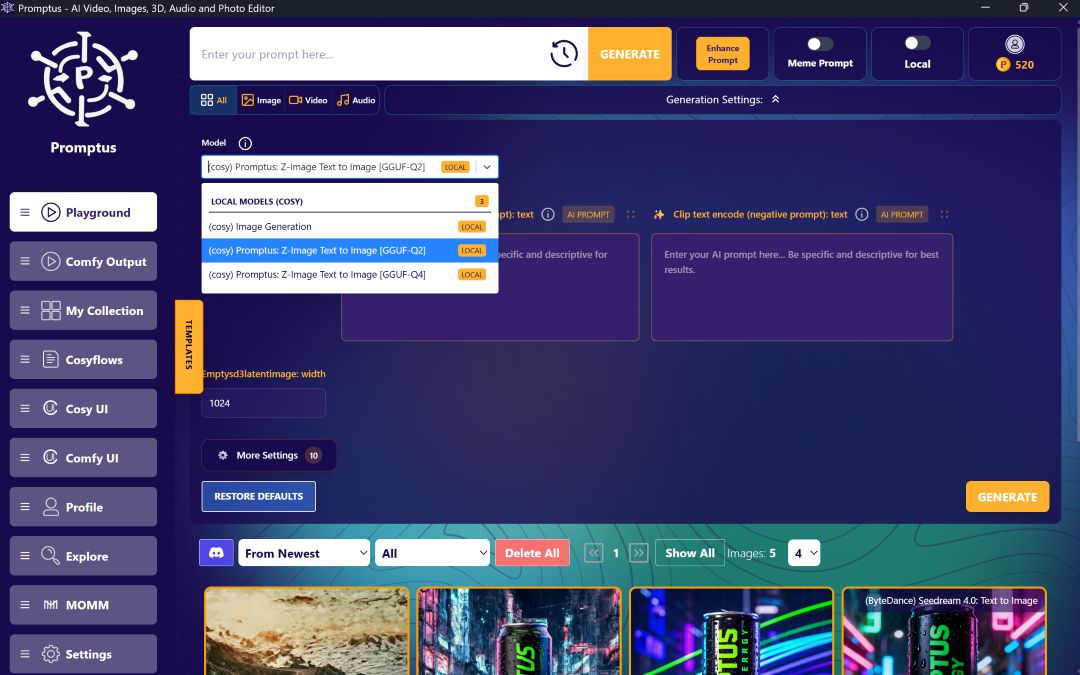

🛒 ¿Interesado? Pruebe Promptus con una licencia única de por vida

Esta canalización completa está integrada en el Plataforma Promptus, que ofrece potentes herramientas basadas en ComfyUI para la generación de imágenes, vídeo y audio mediante IA. Lo mejor de todo es que hay un opción de compra única (licencia de por vida de 49 dólares) sin cuotas mensuales. Ese pago único otorga:

- Acceso completo sin conexión a WAN 2.1 y a todos los Cosyflows

- 10 000 créditos de bonificación

- Interfaz ComfyUI

- Actualizaciones y soporte de por vida

O bien, hay niveles de suscripción opcionales para los creadores que necesitan acceso continuo a la nube o a la GPU: http://promptus.ai/pricing

🔧 ¿Quién debería ver esto?

- Desarrolladores de IA creación de avatares de varios personajes

- Creadores de contenido explorar podcasts o entrevistas alojados en IA

- Tecnólogos dominar los modelos Ollama, TTS, segmentación y sincronización de labios

Este tutorial no es solo un tutorial, es una visión realista de los puntos fuertes y débiles de la cartera, que te brinda las herramientas para decidir si es lo correcto para tu próximo proyecto.

🔗 Recursos y enlaces

- Envoltorio de vídeo WAN 2.1

- Obtenga la licencia de por vida de Promptus — ¡49$ por única vez con 10 000 créditos incluidos!

¡Sumérgete, experimenta y cuéntanos cómo te va!

%20(2).avif)

%20transparent.avif)